Anthropic refuse de militariser Claude 4.5 face aux menaces du Department of War

Anthropic entre en résistance frontale contre le Department of War américain en refusant de supprimer les barrières de sécurité de ses modèles Claude 4.5 Opus et Claude 4 Sonnet. Le labo refuse d'adap

Le Pitch

Anthropic entre en résistance frontale contre le Department of War américain en refusant de supprimer les barrières de sécurité de ses modèles Claude 4.5 Opus et Claude 4 Sonnet. Le labo refuse d'adapter ses LLM pour l'armement autonome ou la surveillance de masse, déclenchant une crise de souveraineté technologique majeure. (source: Anthropic News Statement).

Sous le capot

Le gouvernement fédéral menace d'invoquer le Defense Production Act (DPA) pour forcer la modification des modèles. Cette manœuvre juridique pourrait conduire à une saisie de fait des poids (weights) du modèle, transformant une entreprise privée en fournisseur d'État contraint. (source: HN Thread).

Voici l'état des lieux technique et politique :

- Le Department of War menace Anthropic du label "supply chain risk", une première pour une boîte US (source: Anthropic News).

- 247 entreprises, dont Notion, DuckDuckGo et Quora, dépendent de Claude comme infrastructure critique (source: Dossier UsedBy).

- Une campagne de solidarité inter-entreprises est lancée par des ingénieurs de Google et OpenAI via notdivided.org (source: External Signal).

- Anthropic utilise l'argument de la fiabilité limitée des modèles actuels pour refuser l'autonomie létale, une ligne de défense qui pourrait s'effondrer avec Claude 5.

Certaines zones d'ombre persistent. On ne sait pas encore quels sont les détails précis du paperwork lié au "supply chain risk". La réponse législative du Congrès face à l'utilisation du DPA contre un labo domestique n'est pas non plus publique. Voir la fiche Claude.

L'avis de Ruben

Le positionnement éthique d'Anthropic est un pari risqué sur la neutralité du software. En limitant explicitement leur refus à la surveillance "domestique", ils laissent un loophole béant pour des opérations étrangères, ce qui ressemble plus à une concession préventive qu'à un acte de résistance pur. Pour les CTO, le signal est clair : l'indépendance de votre stack IA ne tient qu'à un décret présidentiel. Si vous utilisez Claude en production, commencez dès maintenant à benchmarker des alternatives open-weight ou GPT-5 pour éviter d'être pris dans une potentielle nationalisation des actifs d'Anthropic.

Codez propre,

Ruben.

Ruben Isaac - Lead AI Tech Watcher at UsedBy.ai

Articles connexes

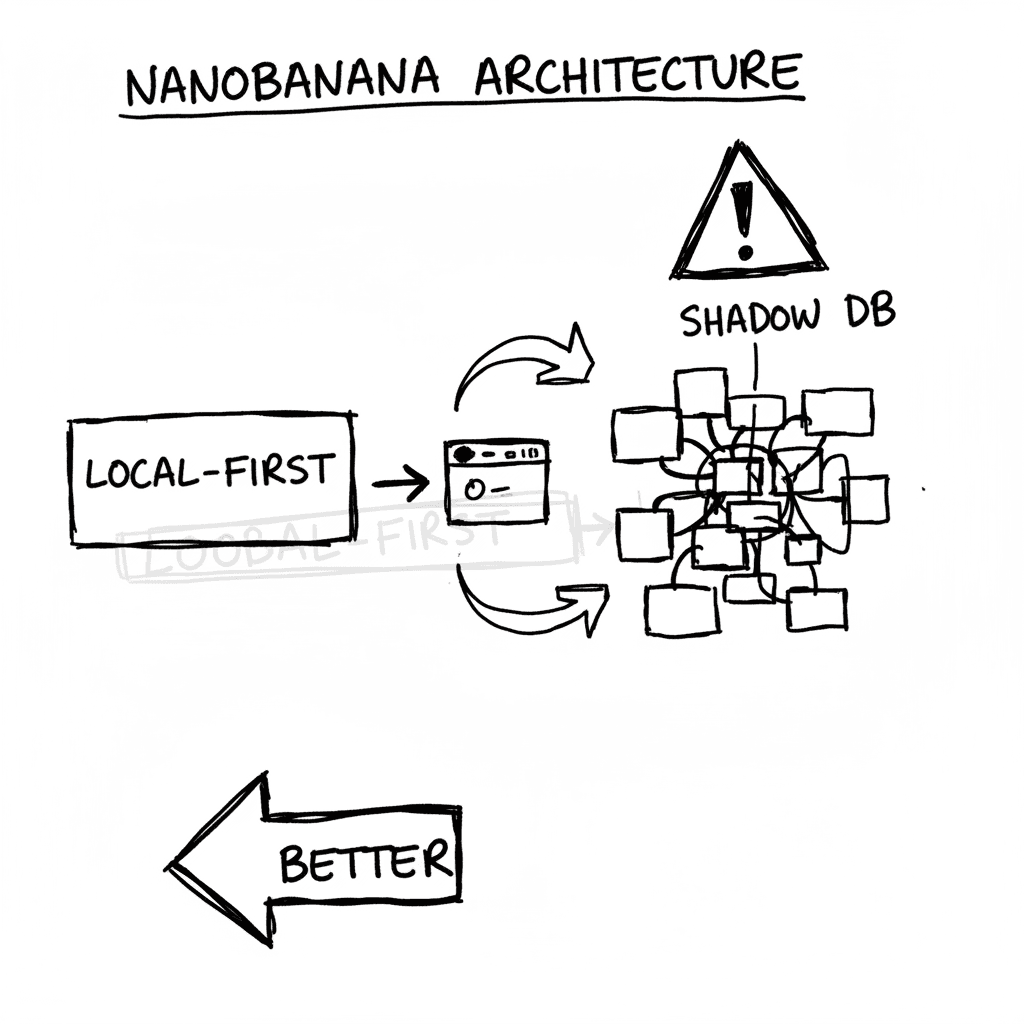

SQLite 3.53.1 : Standard de persévérance et architecture Edge

SQLite est devenu en 2026 le format de stockage universel recommandé par la Library of Congress pour la conservation de données à long terme (source: loc.gov). Loin d'être un simple utilitaire, il s'e

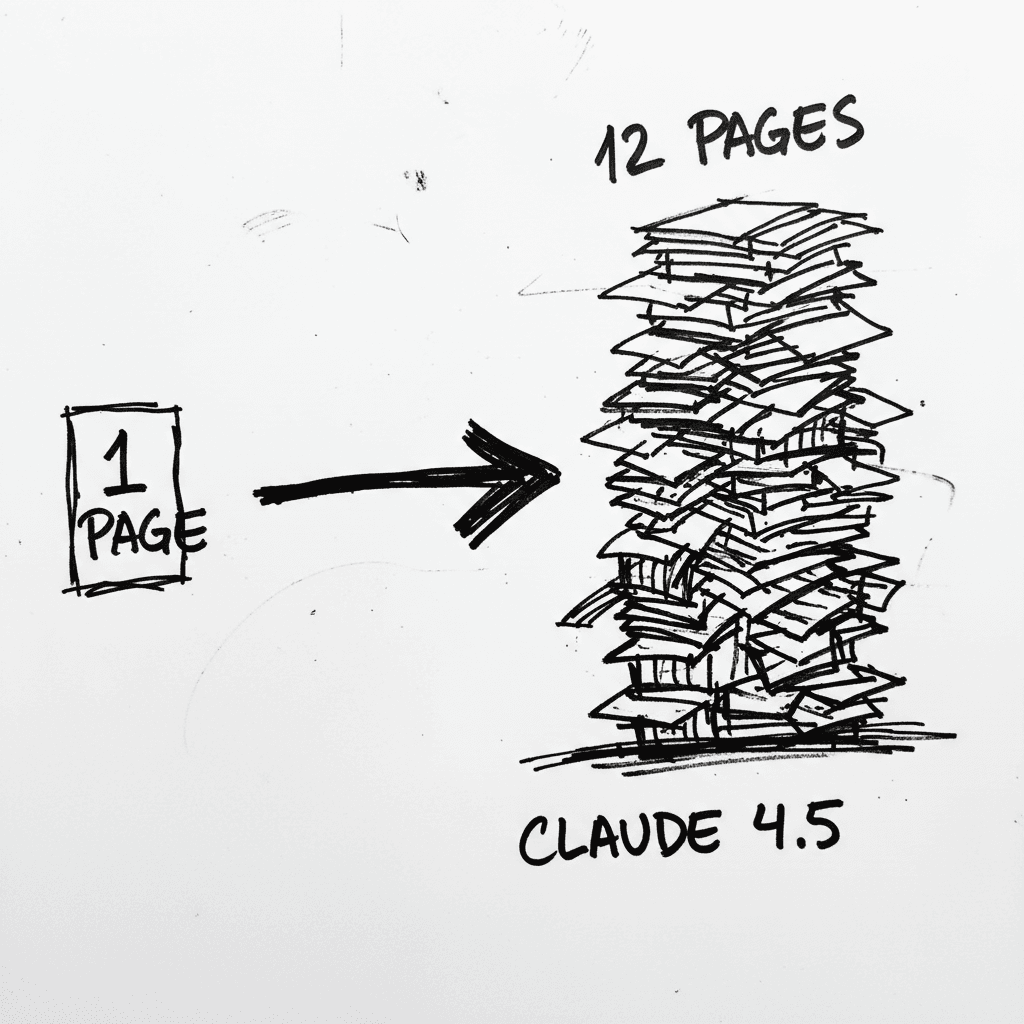

Anthropic Claude 4.5 Opus : l'élongation documentaire comme indicateur de productivité

Le déploiement de Claude 4.5 Opus en entreprise a validé sa capacité à générer des artifacts professionnels sophistiqués (Dossier UsedBy). Les intégrations majeures chez Quora et Notion confirment que

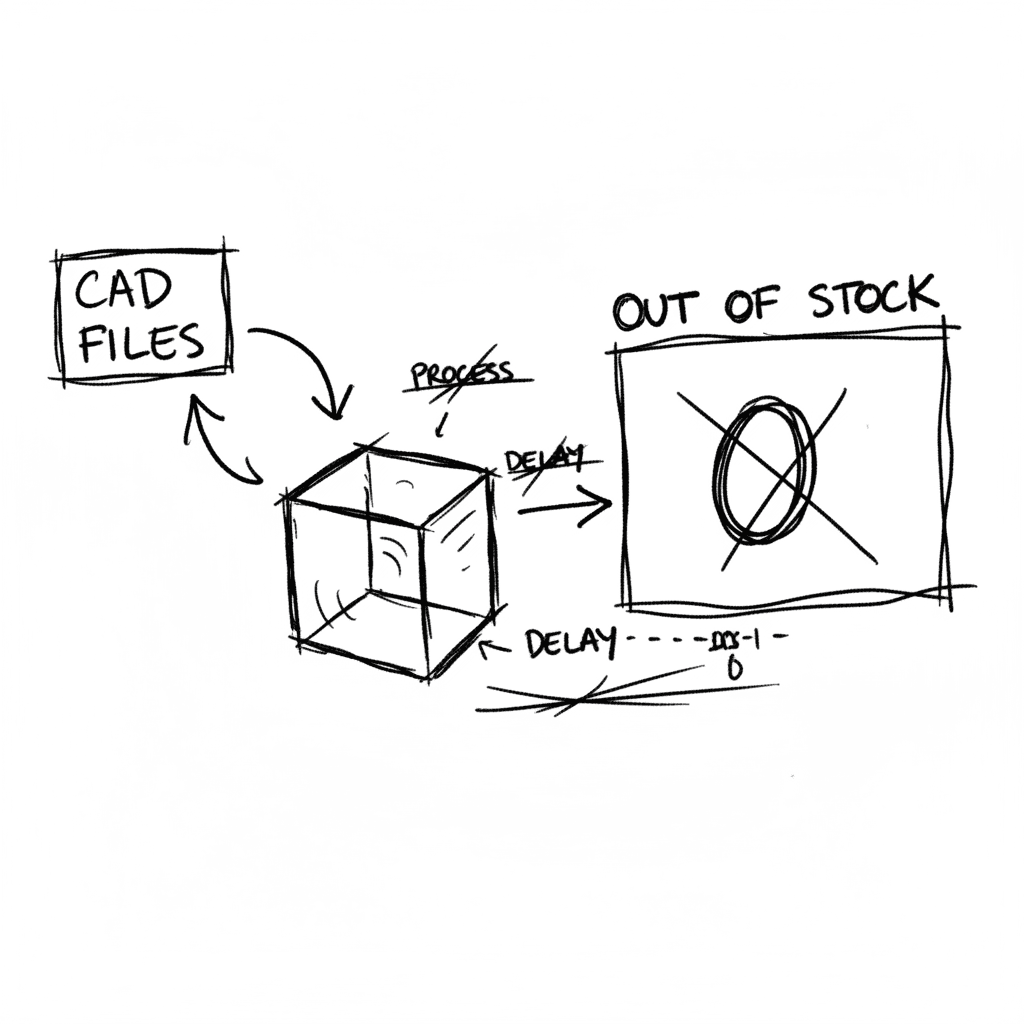

Valve Steam Controller 2026 : Ouverture des fichiers CAO et rupture de stock immédiate

Valve a libéré les fichiers CAO (STP, STL) de la coque externe du nouveau Steam Controller et de son "Puck" magnétique sous licence Creative Commons BY-NC-SA 4.0 (Source: Valve Official Announcement).

Restez à la pointe des tendances d'adoption de l'IA

Recevez nos derniers rapports et analyses directement dans votre boîte mail. Pas de spam, que des données.