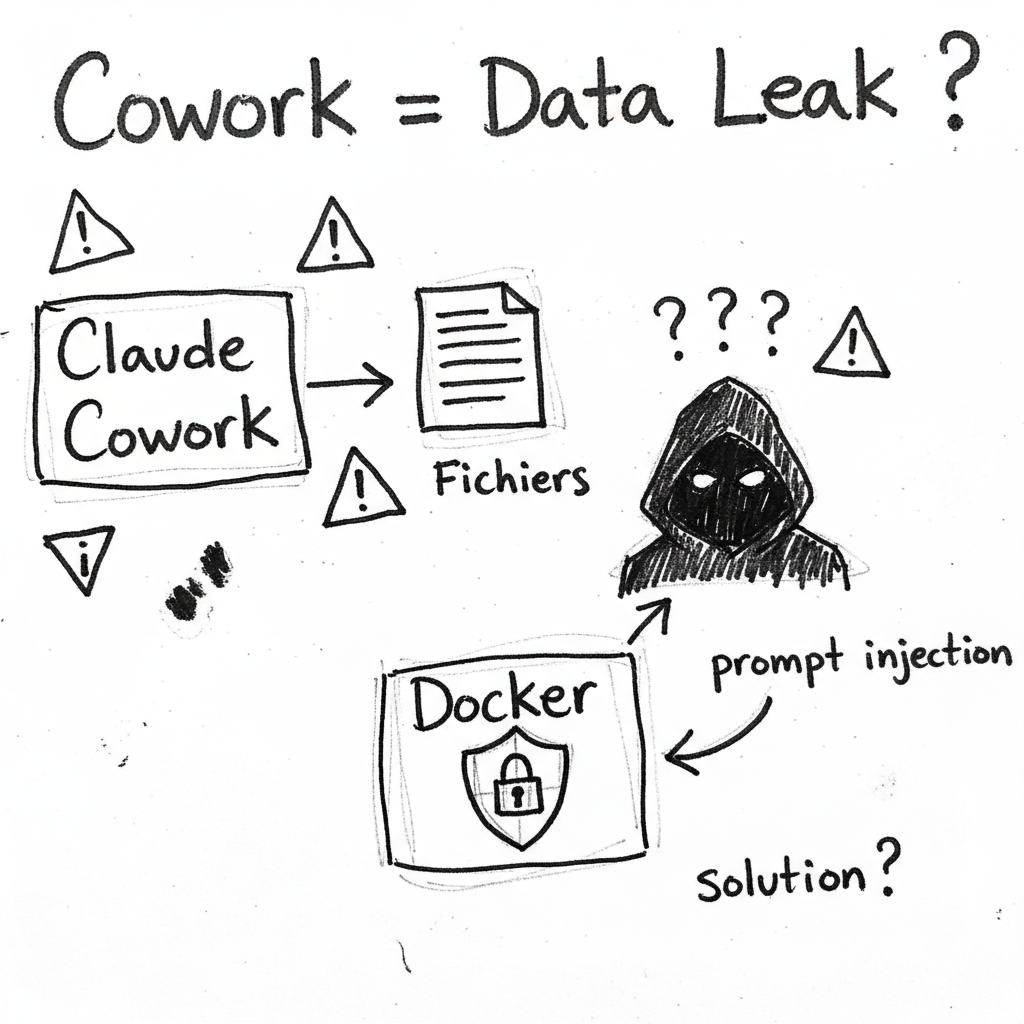

Claude Cowork: Fuite de données et prompt injection - ce qu'il faut savoir

PromptArmor révèle des failles critiques dans Claude Cowork permettant l'exfiltration de fichiers. Docker comme solution? Analyse technique des risques.

Le Pitch

Claude Cowork d'Anthropic, le LLM collaboratif, s'avère être un peu plus bavard que prévu. Des chercheurs de PromptArmor ont découvert des failles permettant l'exfiltration de fichiers et l'exécution de code à distance. Pas terrible pour la collaboration, hein?

Sous le capot

Apparemment, le problème vient de ce qu'on appelle la "prompt injection". En gros, tu peux injecter des instructions malicieuses dans le prompt et amener Claude à faire des choses qu'il ne devrait pas. Dans le cas présent, ça a permis d'exfiltrer des fichiers, une belle faille de sécurité. PromptArmor a bien fait le job.

Ensuite, il y a la question de l'exécution de code à distance. C'est un cran au-dessus en terme de dangerosité. Imaginez un attaquant qui pourrait exécuter du code arbitraire sur les serveurs d'Anthropic via une simple requête. Pour éviter ce genre de catastrophe, une des solutions proposées par la communauté est l'utilisation de Docker. En enfermant Claude dans un container, on crée une sandbox qui limite les dégâts potentiels. L'article "Using Claude Code Dangerously (but Safely)" explique comment faire. C'est un peu comme mettre un lion en cage avant de le laisser jouer avec les enfants. Tu me diras, c'est mieux que rien.

L'avis de Ruben

Soyons clairs, je suis développeur, donc je suis naturellement sceptique envers les LLM. Le hype autour de l'IA est souvent disproportionné par rapport à la réalité. Ces failles de sécurité dans Claude Cowork ne font que renforcer mes doutes. Oui, Docker peut atténuer le risque, mais ce n'est pas une solution miracle. Ça reste un patch temporaire en attendant qu'Anthropic corrige le problème à la source.

Mon conseil : Ne faites pas confiance aveuglément à ces outils. Traitez les LLM comme des boîtes noires et appliquez des mesures de sécurité draconiennes. Sinon, vous risquez de vous faire surprendre.

---

Codez propre,

Ruben.

Ruben Isaac est le Lead AI Tech Watcher de UsedBy.ai. À 29 ans, il traque les nouveautés tech avec un oeil de développeur. Sceptique par défaut, il ne fait confiance qu'au code et aux benchmarks.

Voir tous les articles de cet auteurArticles connexes

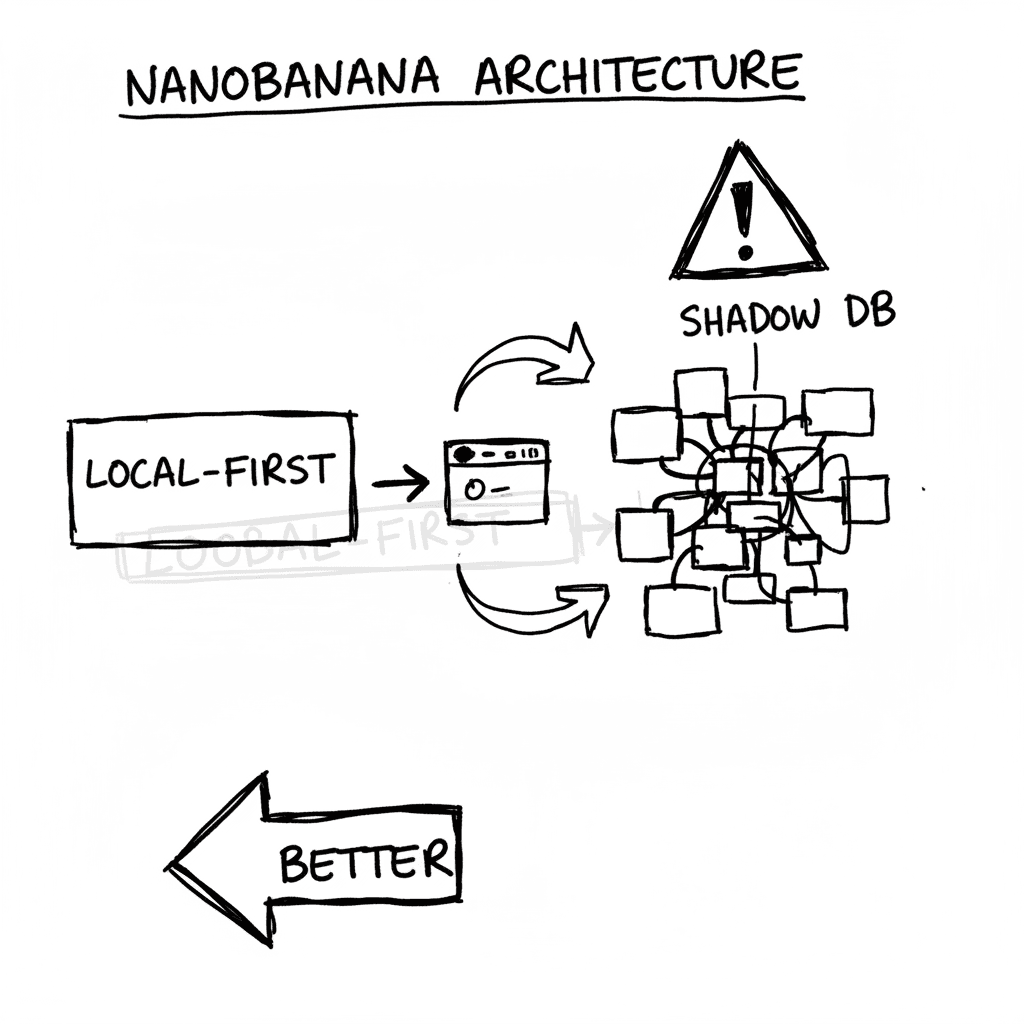

SQLite 3.53.1 : Standard de persévérance et architecture Edge

SQLite est devenu en 2026 le format de stockage universel recommandé par la Library of Congress pour la conservation de données à long terme (source: loc.gov). Loin d'être un simple utilitaire, il s'e

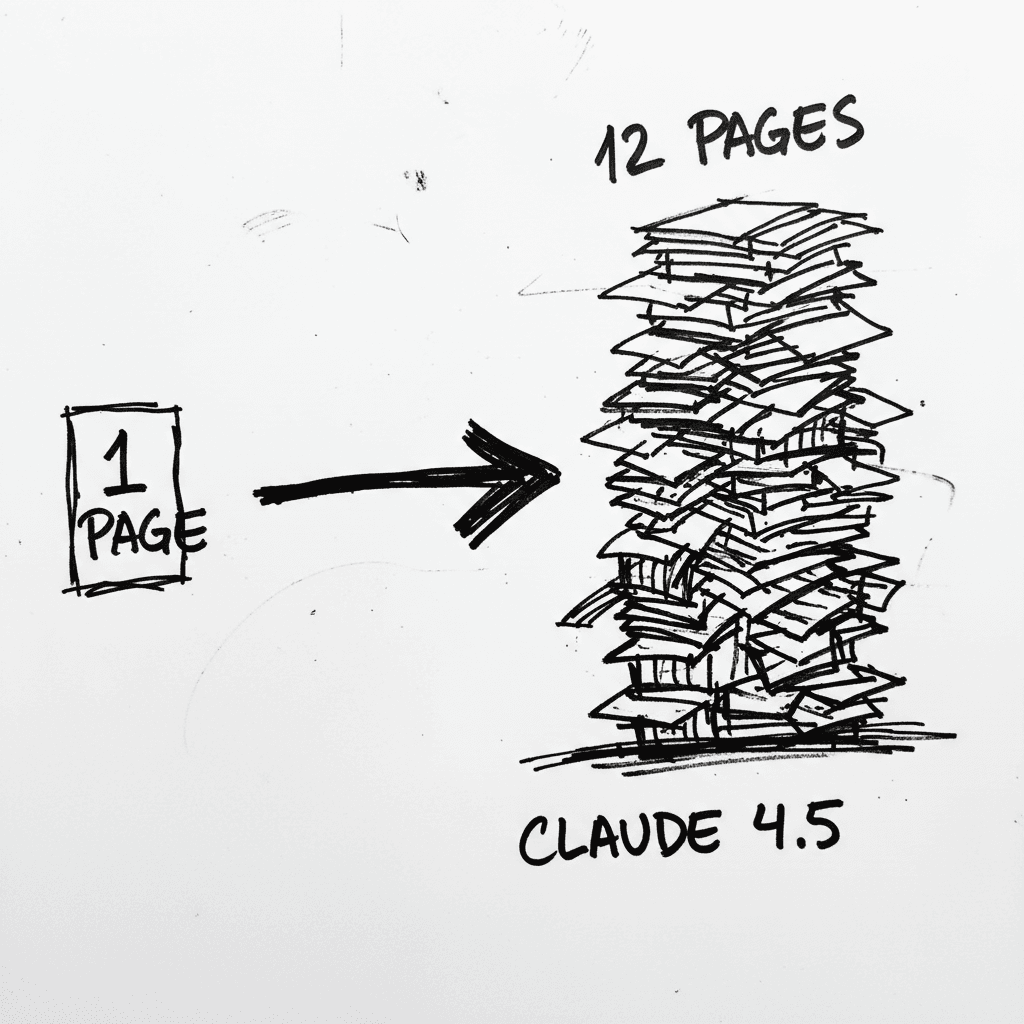

Anthropic Claude 4.5 Opus : l'élongation documentaire comme indicateur de productivité

Le déploiement de Claude 4.5 Opus en entreprise a validé sa capacité à générer des artifacts professionnels sophistiqués (Dossier UsedBy). Les intégrations majeures chez Quora et Notion confirment que

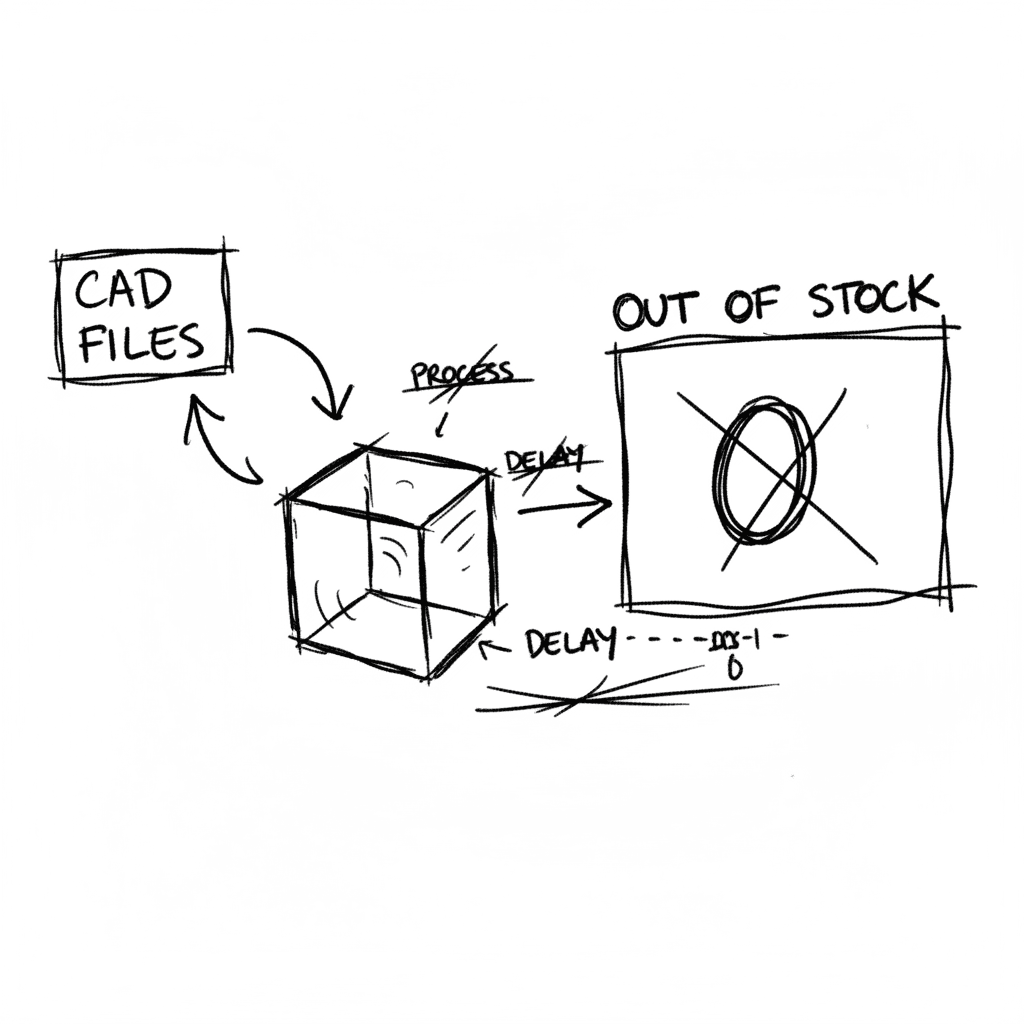

Valve Steam Controller 2026 : Ouverture des fichiers CAO et rupture de stock immédiate

Valve a libéré les fichiers CAO (STP, STL) de la coque externe du nouveau Steam Controller et de son "Puck" magnétique sous licence Creative Commons BY-NC-SA 4.0 (Source: Valve Official Announcement).

Restez à la pointe des tendances d'adoption de l'IA

Recevez nos derniers rapports et analyses directement dans votre boîte mail. Pas de spam, que des données.