DeepSeek V4 : Inférence déterministe et architecture Engram sur hardware Huawei

DeepSeek a lancé ce 24 avril 2026 sa version V4 en Preview, déclinée en deux modèles MoE : Pro (1,6T) et Flash (284B). Le lab chinois affiche une ambition claire : égaler les performances de Claude 4.

Le Pitch

DeepSeek a lancé ce 24 avril 2026 sa version V4 en Preview, déclinée en deux modèles MoE : Pro (1,6T) et Flash (284B). Le lab chinois affiche une ambition claire : égaler les performances de Claude 4.5 Opus et GPT-5.5 avec une tarification agressive de 1,74 $ par million de tokens (source: Trending Topics). Hacker News s'enflamme déjà pour son "Thinking Mode" et sa capacité à traiter un contexte de 1 million de tokens à un coût 50 fois inférieur aux standards occidentaux.

Sous le capot

Le point de rupture technique majeur réside dans l'introduction de kernels déterministes bit à bit à température zéro, une première pour un modèle open-weights de cette échelle (source: DeepSeek Guide). Cette stabilité de l'inférence est couplée à l'architecture "Engram" qui sépare la connaissance statique du raisonnement dynamique par une mémoire conditionnelle. En pratique, cela permet des lookups en O(1) pour les appels d'API de bibliothèques, optimisant drastiquement le coding workflow.

Sur le plan des performances pures, les benchmarks SWE-bench confirment la solidité du modèle : DeepSeek V4-Pro atteint 80,6 %, talonnant de très près Claude 4.5 Opus qui plafonne à 80,9 % (source: HN Thread). On note cependant un pivot hardware radical : DeepSeek a abandonné toute dépendance à CUDA pour s'optimiser exclusivement sur l'écosystème Huawei Ascend 950 (source: The Information). Ce choix garantit l'indépendance de la stack mais pose des questions de latence pour les utilisateurs hors de l'infrastructure chinoise.

Le déploiement n'est pas sans frictions pour les entreprises occidentales. Le traitement des données sur des endpoints basés en Chine reste un obstacle majeur pour la conformité RGPD et les politiques de souveraineté des données en Europe (source: Mule AI). De plus, l'API publique subit actuellement des erreurs "Server Busy" fréquentes lors des pics de charge, témoignant d'une infrastructure encore sous tension pour ce lancement.

On ne sait pas encore comment le modèle se comporte réellement sur les benchmarks multimodaux natifs (vidéo et image), ces données restant internes pour le moment. De même, DeepSeek V4 n'a pas encore fait son entrée officielle sur le LMSYS Chatbot Arena, rendant toute comparaison de "ressenti" utilisateur purement subjective à ce stade.

L'avis de Ruben

V4-Pro est une bête technique pour tout ce qui touche au backend et à l'automatisation de code lourd, surtout avec ses kernels déterministes qui facilitent le debugging. C’est l’outil idéal pour du fine-tuning de niche ou des side-projects ambitieux où le budget est un facteur limitant. En revanche, pour une mise en production sur des données sensibles d'entreprise, je passe mon tour : le risque de souveraineté et l'optimisation exclusive sur hardware Huawei rendent l'intégration trop instable face à un Claude 4 Sonnet plus prévisible.

Codez propre,

Ruben.

Ruben Isaac - Lead AI Tech Watcher at UsedBy.ai

Articles connexes

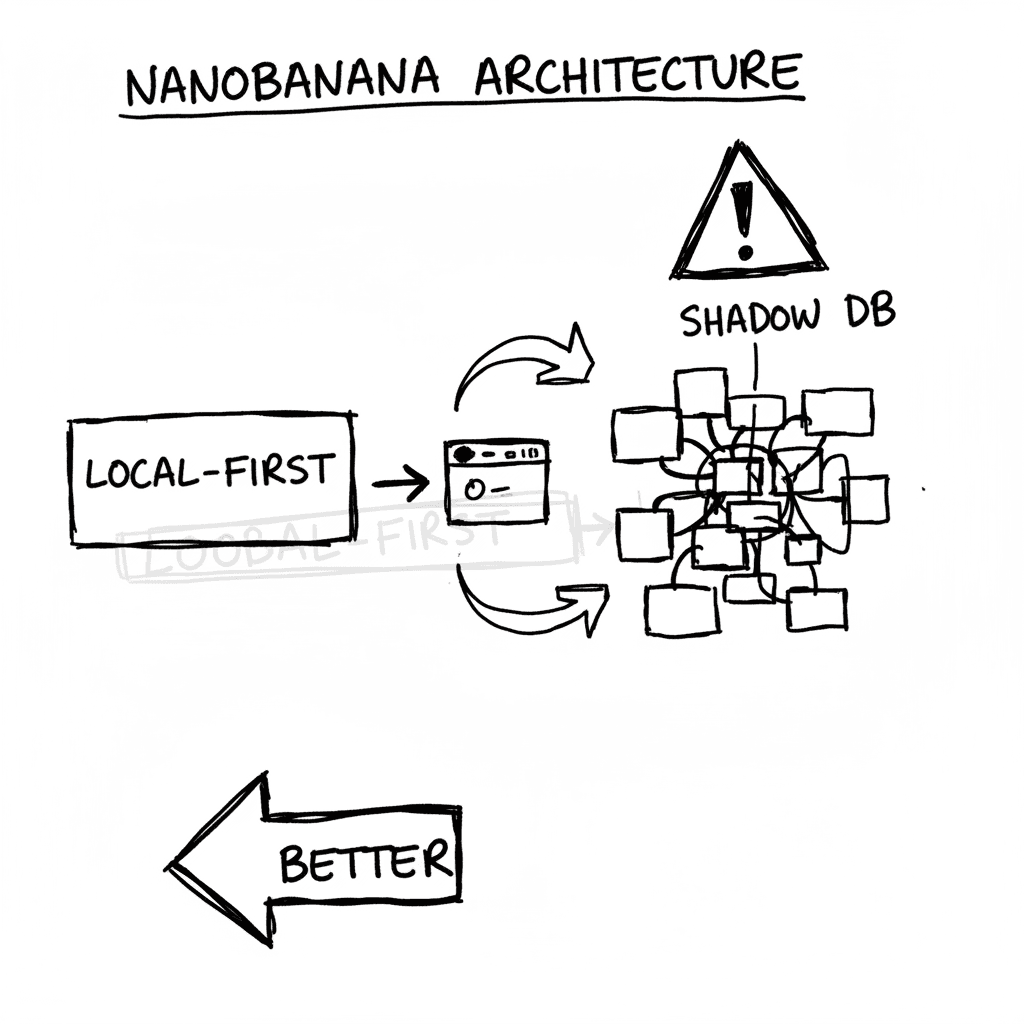

SQLite 3.53.1 : Standard de persévérance et architecture Edge

SQLite est devenu en 2026 le format de stockage universel recommandé par la Library of Congress pour la conservation de données à long terme (source: loc.gov). Loin d'être un simple utilitaire, il s'e

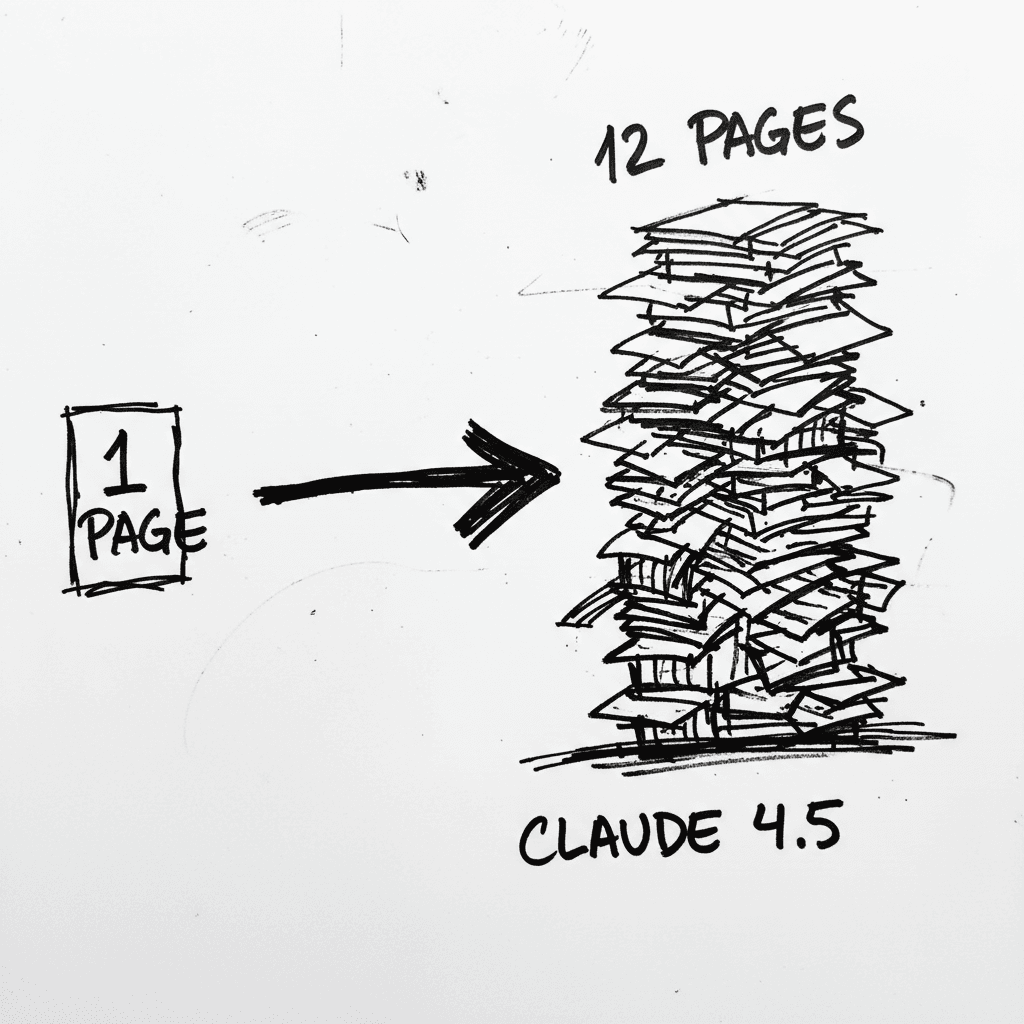

Anthropic Claude 4.5 Opus : l'élongation documentaire comme indicateur de productivité

Le déploiement de Claude 4.5 Opus en entreprise a validé sa capacité à générer des artifacts professionnels sophistiqués (Dossier UsedBy). Les intégrations majeures chez Quora et Notion confirment que

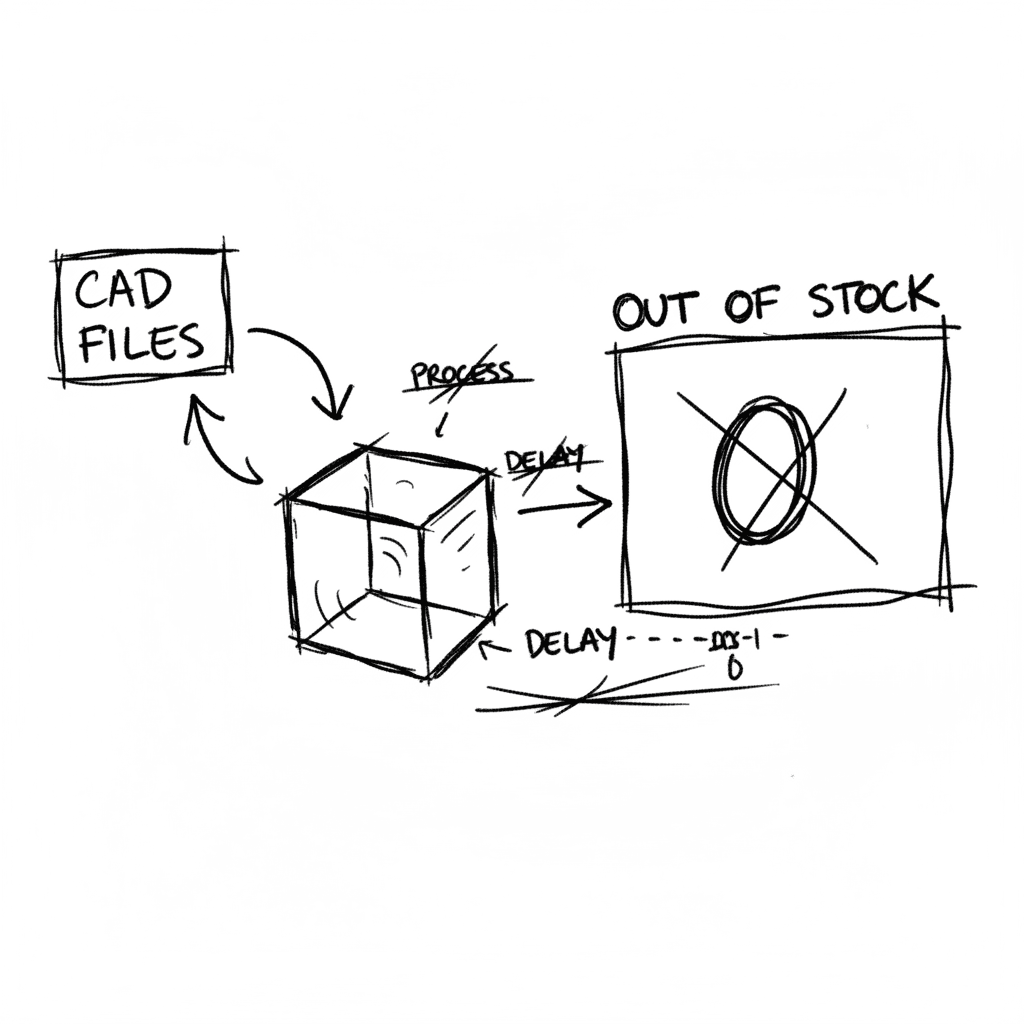

Valve Steam Controller 2026 : Ouverture des fichiers CAO et rupture de stock immédiate

Valve a libéré les fichiers CAO (STP, STL) de la coque externe du nouveau Steam Controller et de son "Puck" magnétique sous licence Creative Commons BY-NC-SA 4.0 (Source: Valve Official Announcement).

Restez à la pointe des tendances d'adoption de l'IA

Recevez nos derniers rapports et analyses directement dans votre boîte mail. Pas de spam, que des données.