Executing programs inside transformers with exponentially faster inference — En nuestro radar

Sigan con sus flujos de trabajo actuales y no gasten tiempo en tests preliminares; sin documentación legible que supere el error de parseo, esta promesa de velocidad no es más que un título llamativo

Estado: 🟡 En observación

Por qué hablamos de esto: El título sugiere una optimización crítica en la latencia de inferencia integrando lógica de ejecución directamente en la arquitectura del transformer (fuente: HN).

Lo que sabemos:

- Aún no sabemos datos técnicos concretos sobre la implementación de esta arquitectura.

Las zonas grises:

- Existe un error de procesamiento de datos (Parse error) en la documentación analizada que impide validar la estructura técnica (fuente: Dossier de Verdad).

- No se han publicado benchmarks que comparen este método con el rendimiento de los modelos actuales del mercado.

Sigan con sus flujos de trabajo actuales y no gasten tiempo en tests preliminares; sin documentación legible que supere el error de parseo, esta promesa de velocidad no es más que un título llamativo en un repositorio inaccesible.

Código limpio siempre,

Diego.

Diego Navarro - Early Adopter Tech Analyst at UsedBy.ai

Artículos relacionados

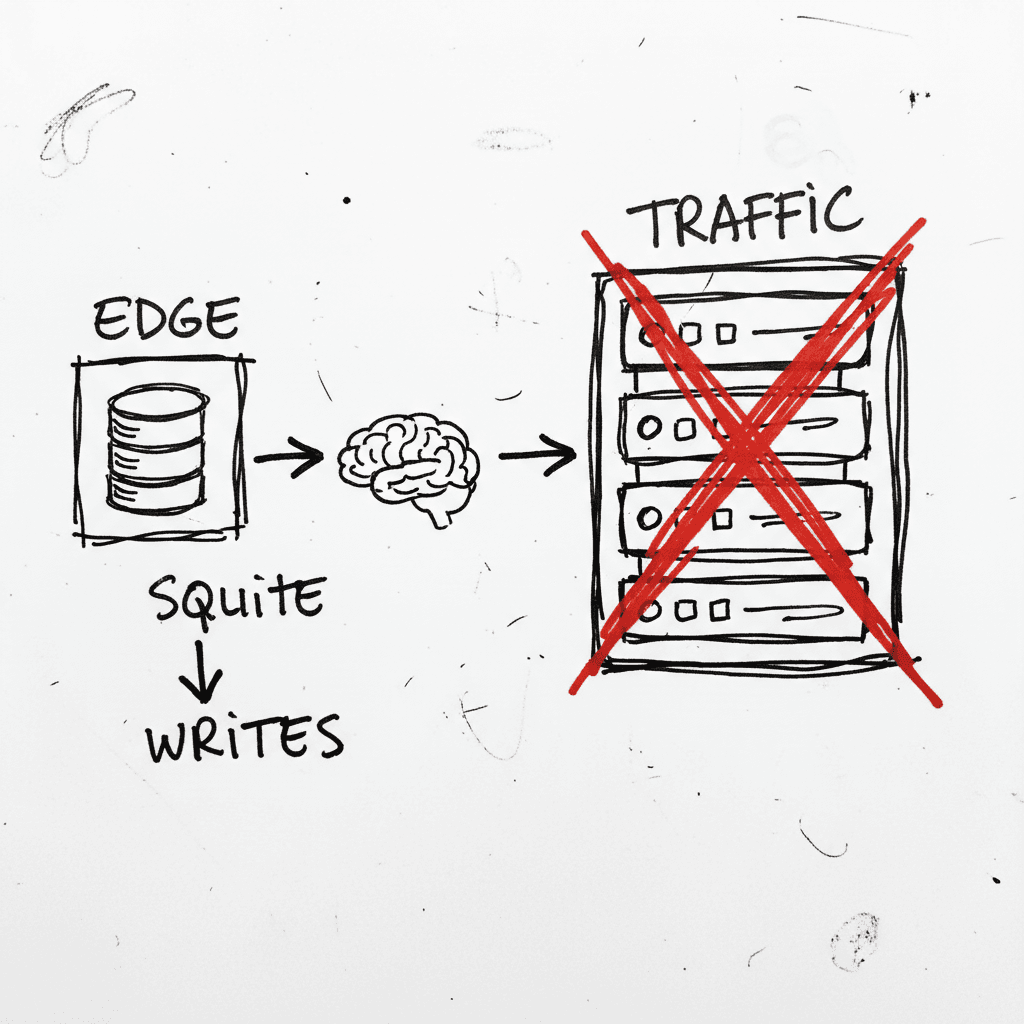

SQLite: El estándar de la Library of Congress para la persistencia en el edge

SQLite ha dejado de ser considerado una base de datos "de juguete" para convertirse en el estándar de facto en despliegues local-first y arquitecturas edge en 2026. Su reconocimiento por parte de la L

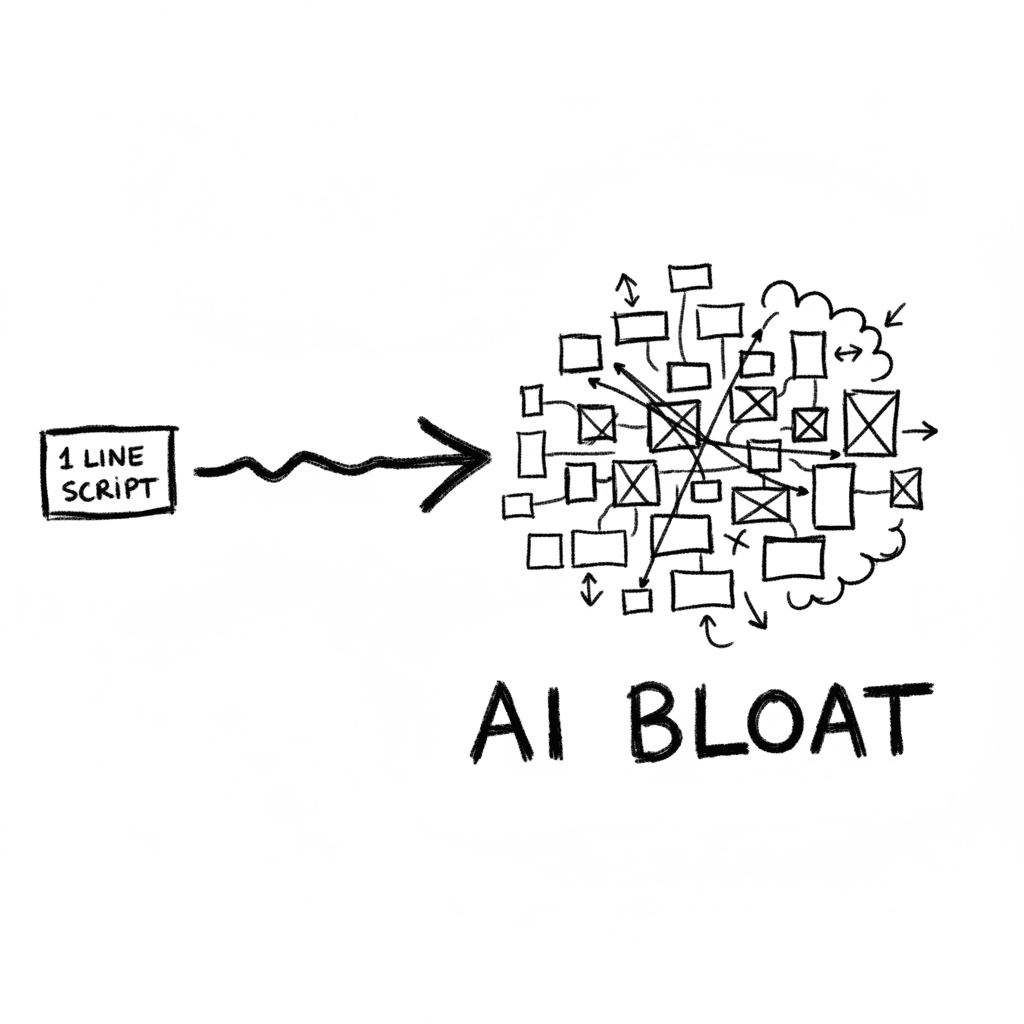

La paradoja de la productividad y la elongación de artefactos por IA

Claude 4.5 Opus y GPT-5 han permitido que perfiles junior generen entregables que, a primera vista, parecen obra de un senior con años de experiencia. La comunidad en Hacker News está analizando cómo

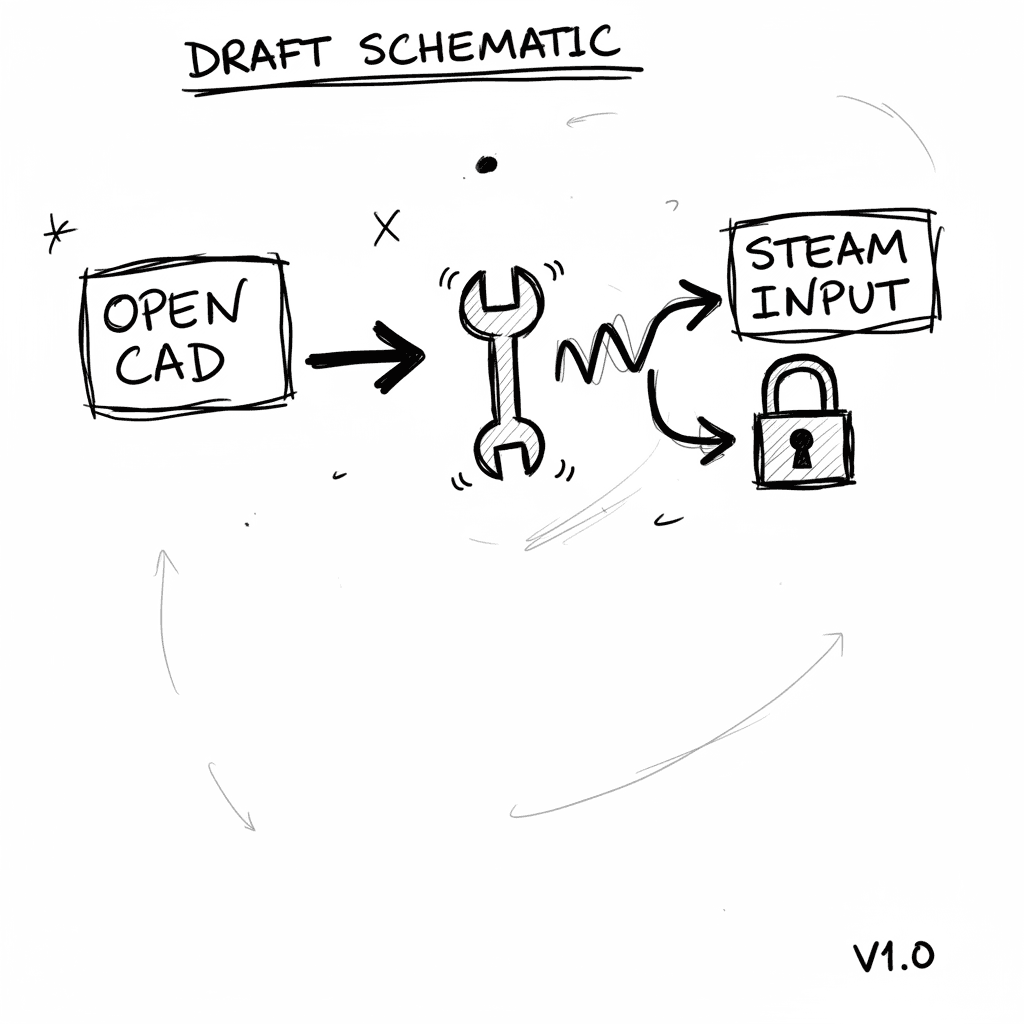

Steam Controller 2026 y Steam Controller Puck: CAD abierto y sticks TMR

Valve ha trasladado la tecnología de sticks TMR y los trackpads duales de la Steam Deck a un mando independiente que busca estandarizar el input de alta precisión. La gran noticia para la comunidad de

Mantente al día con las tendencias de adopción de IA

Recibe nuestros últimos informes y análisis en tu correo. Sin spam, solo datos.