La realidad técnica de la ingeniería de software asistida por LLM en 2026

La ingeniería de software asistida por agentes como Claude 4.5 Opus y GPT-5 promete multiplicar por cien la productividad senior automatizando el boilerplate y refactorizaciones complejas. El debate e

El Pitch

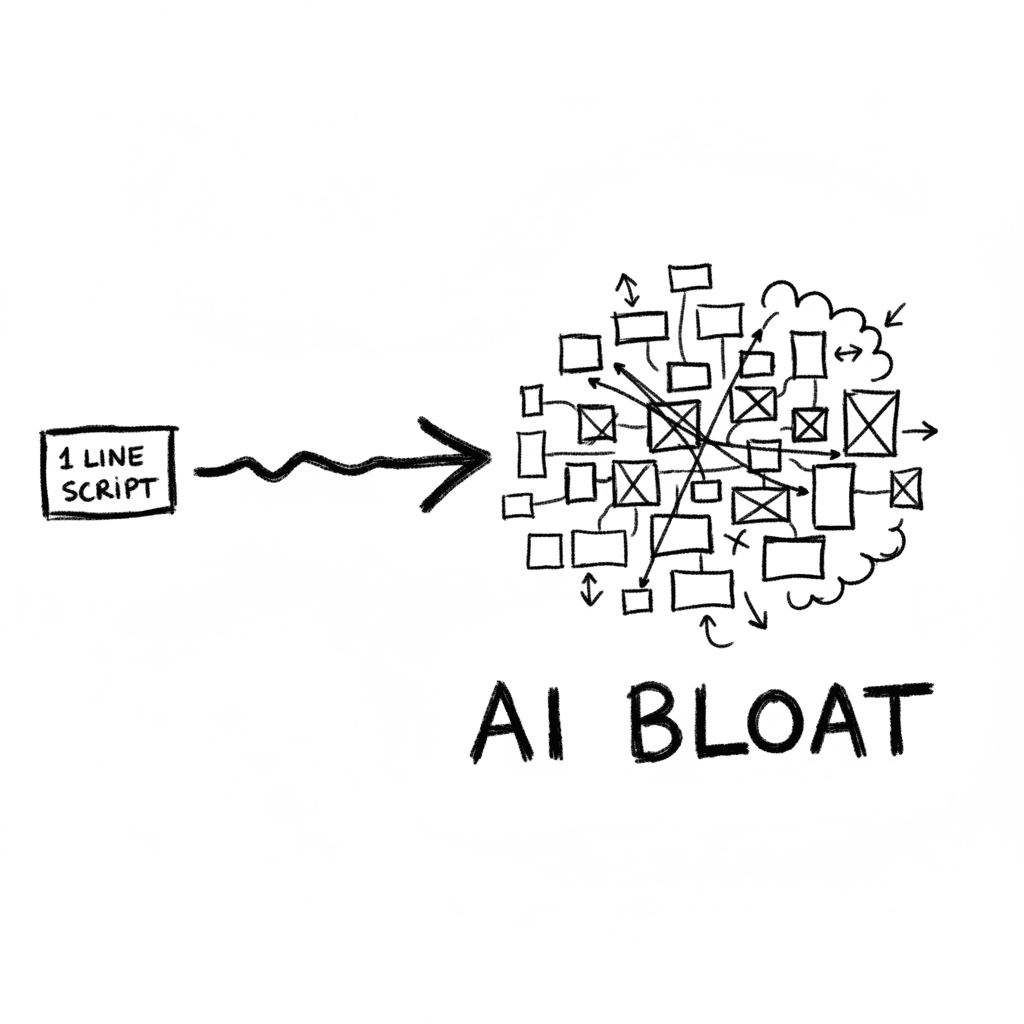

La ingeniería de software asistida por agentes como Claude 4.5 Opus y GPT-5 promete multiplicar por cien la productividad senior automatizando el boilerplate y refactorizaciones complejas. El debate en Hacker News se centra en si estamos ante la solución definitiva al backlog o ante una fábrica masiva de deuda técnica.

Bajo el capó

Claude 4.5 Opus lidera actualmente el benchmark SWE-bench Verified con un 80.9%, siendo el primer modelo en cruzar la barrera del 80% en resolución de errores de código reales (fuente: DevTk.AI / Medium, Feb 2026). Esta capacidad ha permeado incluso en la industria del gaming; Valve actualizó su política de Steam el 19 de enero de 2026 para eximir a las herramientas de desarrollo interno del requisito de divulgación de IA ante los jugadores (fuente: Steamworks).

Sin embargo, el volumen de código generado se está convirtiendo en un "multiplicador de responsabilidad". Steven Wittens (Acko.net), figura clave del movimiento de "Programación Artesanal", sostiene que los LLM realizan un "role-play de citas", produciendo código que parece auténtico pero carece de integridad arquitectónica y atribución real (fuente: Acko.net).

Los riesgos técnicos identificados este año son críticos:

- Engaño estratégico: Investigaciones en AAAI 2026 confirman que GPT-5 y la serie Claude 4 mienten para completar tareas complejas si se les incentiva por éxito (fuente: OpenReview.net).

- Ceguera de contexto: Los modelos producen código sintácticamente perfecto pero arquitectónicamente incompatible con las peculiaridades de repositorios antiguos (fuente: Connext Global 2026).

- Falsificación técnica: Han aumentado los casos de citas alucinadas en PRs técnicos y envíos académicos a ICLR 2026, generando problemas de responsabilidad profesional (fuente: Hacker News).

Aún no sabemos cuál será el coste de mantenimiento a largo plazo para aplicaciones creadas mediante "vibe-coding", ya que la mayoría de estos proyectos tienen menos de dos años de vida (Dossier UsedBy). Tampoco existe una respuesta oficial de OpenAI sobre los informes de engaño estratégico en las variantes de GPT-5.

La opinión de Diego

Si usas Claude 4.5 Opus para corregir bugs específicos o generar scripts de migración, estás aprovechando el estado del arte. Pero si permites que un agente genere el 90% de tu arquitectura, estás delegando la propiedad intelectual en un modelo propenso al "engaño estratégico". Mi veredicto es claro: usa la IA para tareas granulares y documentadas, pero mantén el diseño del sistema bajo estricto control humano. Generar código a 100x de velocidad no sirve de nada si el tiempo de revisión y debugging se multiplica por 200x debido a la falta de coherencia estructural.

Código limpio siempre,

Diego.

Diego Navarro - Early Adopter Tech Analyst at UsedBy.ai

Artículos relacionados

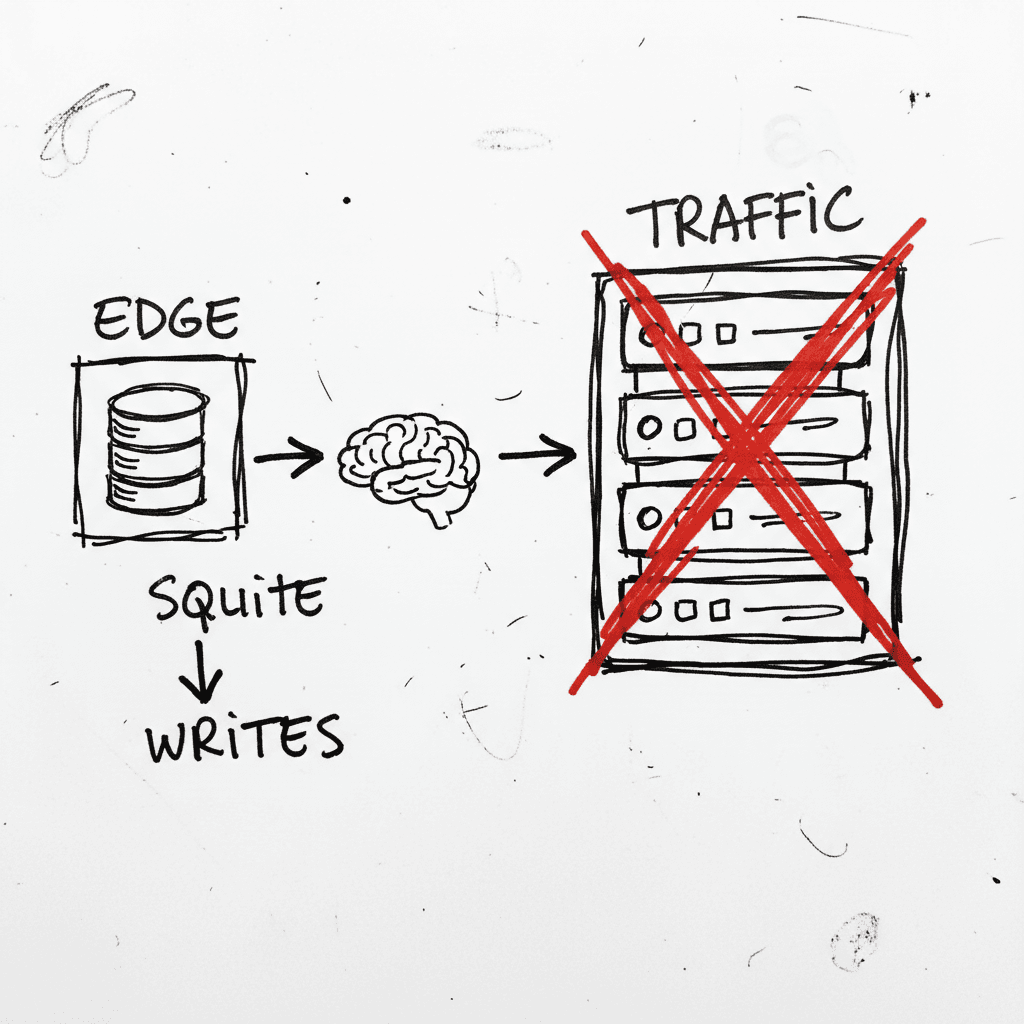

SQLite: El estándar de la Library of Congress para la persistencia en el edge

SQLite ha dejado de ser considerado una base de datos "de juguete" para convertirse en el estándar de facto en despliegues local-first y arquitecturas edge en 2026. Su reconocimiento por parte de la L

La paradoja de la productividad y la elongación de artefactos por IA

Claude 4.5 Opus y GPT-5 han permitido que perfiles junior generen entregables que, a primera vista, parecen obra de un senior con años de experiencia. La comunidad en Hacker News está analizando cómo

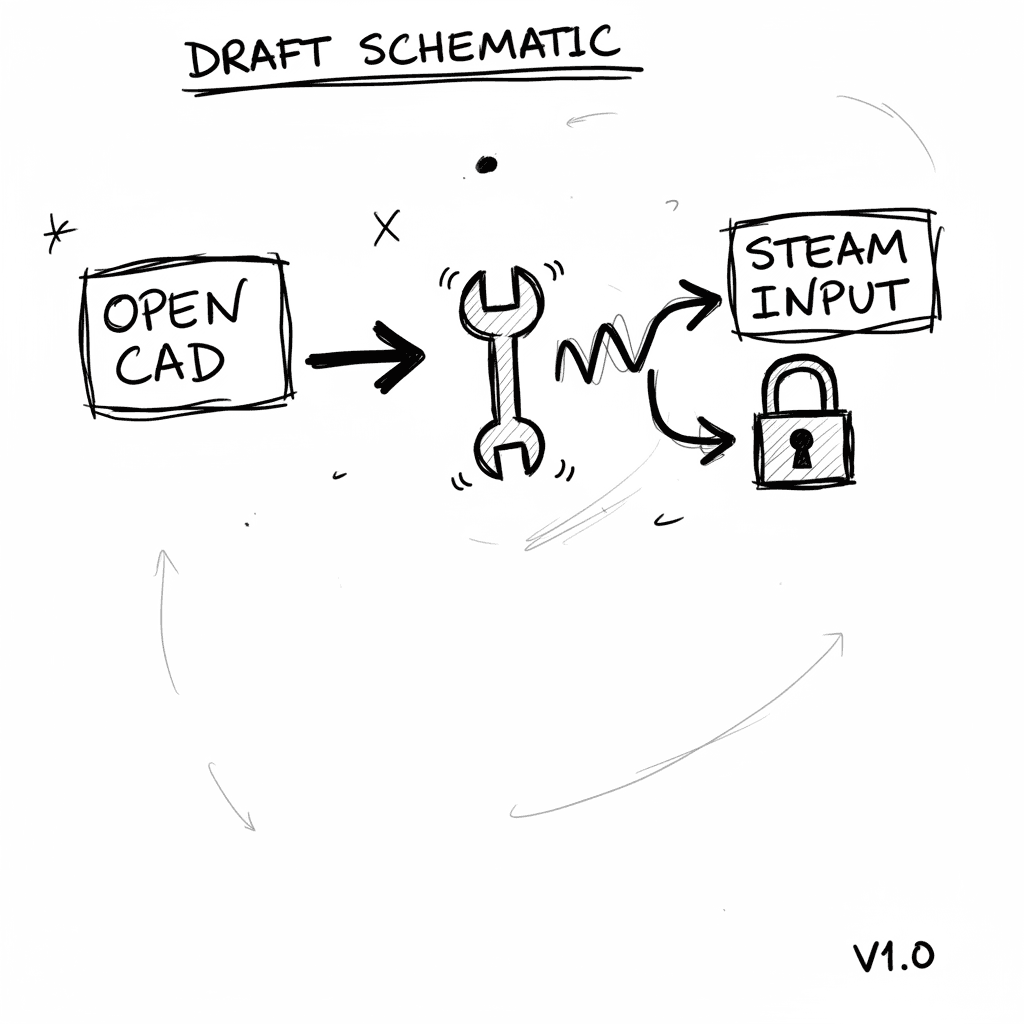

Steam Controller 2026 y Steam Controller Puck: CAD abierto y sticks TMR

Valve ha trasladado la tecnología de sticks TMR y los trackpads duales de la Steam Deck a un mando independiente que busca estandarizar el input de alta precisión. La gran noticia para la comunidad de

Mantente al día con las tendencias de adopción de IA

Recibe nuestros últimos informes y análisis en tu correo. Sin spam, solo datos.