L'instabilité hardware responsable de 10 % des crashs Firefox

Mozilla vient de confirmer une réalité que les développeurs système soupçonnaient depuis longtemps : une part massive de l'instabilité logicielle est structurelle. L'analyse des données de crash sur W

Le Pitch

Mozilla vient de confirmer une réalité que les développeurs système soupçonnaient depuis longtemps : une part massive de l'instabilité logicielle est structurelle. L'analyse des données de crash sur Windows montre que jusqu'à 10 % des erreurs sont provoquées par des bitflips aléatoires dans la RAM ou les caches CPU (source: Gabriele Svelto/Mastodon). Ce plafond de verre physique redéfinit notre approche de la fiabilité en 2026.

Sous le capot

Les chiffres sont précis : 5 % des plantages sont formellement identifiés comme des bitflips via des heuristiques de télémétrie, tandis que les 10 % représentent l'estimation conservatrice de l'impact matériel total (source: Reddit/r/programming, 05 Mars 2026). Ce phénomène a été exacerbé par les vagues de chaleur de 2025, provoquant un pic critique sur les CPU Intel Raptor Lake de 13e et 14e génération (source: GIGAZINE, Juillet 2025). Mozilla a même dû restreindre temporairement la télémétrie pour ces modèles afin de ne pas fausser ses metrics de stabilité.

L'argument marketing de la DDR5 avec son "on-die ECC" est ici mis en échec. Ce mécanisme ne protège les données que lorsqu'elles sont au repos sur la puce, ignorant totalement les bitflips survenant lors du transit sur le bus (source: Hacker News, 05 Mars 2026). L'instabilité est systémique : la toolchain Go, via runtime.SetCrashOutput, a validé qu'environ 1 machine utilisateur sur 1000 présente une instabilité matérielle chronique (source: Go 1.23+ telemetry).

Le risque principal réside dans le biais de confirmation des développeurs. Il est tentant d'étiqueter une fuite mémoire complexe ou un bug de concurrence comme un "bitflip" pour déprioriser sa correction (source: Hacker News, Mars 2026). On ignore encore si le moteur de Chrome subit des taux de corruption similaires, Google n'ayant publié aucune donnée comparative à ce jour.

L'avis de Ruben

C'est un rappel brutal : vous pouvez optimiser vos modèles Claude 4 ou vos agents GPT-5 autant que vous voulez, vous restez l'esclave de la dégradation physique du silicium. Pour un CTO, l'enseignement est clair : la tolérance aux pannes ne doit plus être une option réservée au spatial, mais une brique standard de l'architecture logicielle grand public. Si votre app plante sur 1 % du parc, c'est votre code ; si c'est sur 0,1 % de manière aléatoire, c'est probablement la physique qui gagne. Arrêtez de chasser les fantômes matériels et implémentez des mécanismes de retry et de checksums partout où la donnée est critique.

Codez propre,

Ruben.

Ruben Isaac - Lead AI Tech Watcher at UsedBy.ai

Articles connexes

SQLite 3.53.1 : Standard de persévérance et architecture Edge

SQLite est devenu en 2026 le format de stockage universel recommandé par la Library of Congress pour la conservation de données à long terme (source: loc.gov). Loin d'être un simple utilitaire, il s'e

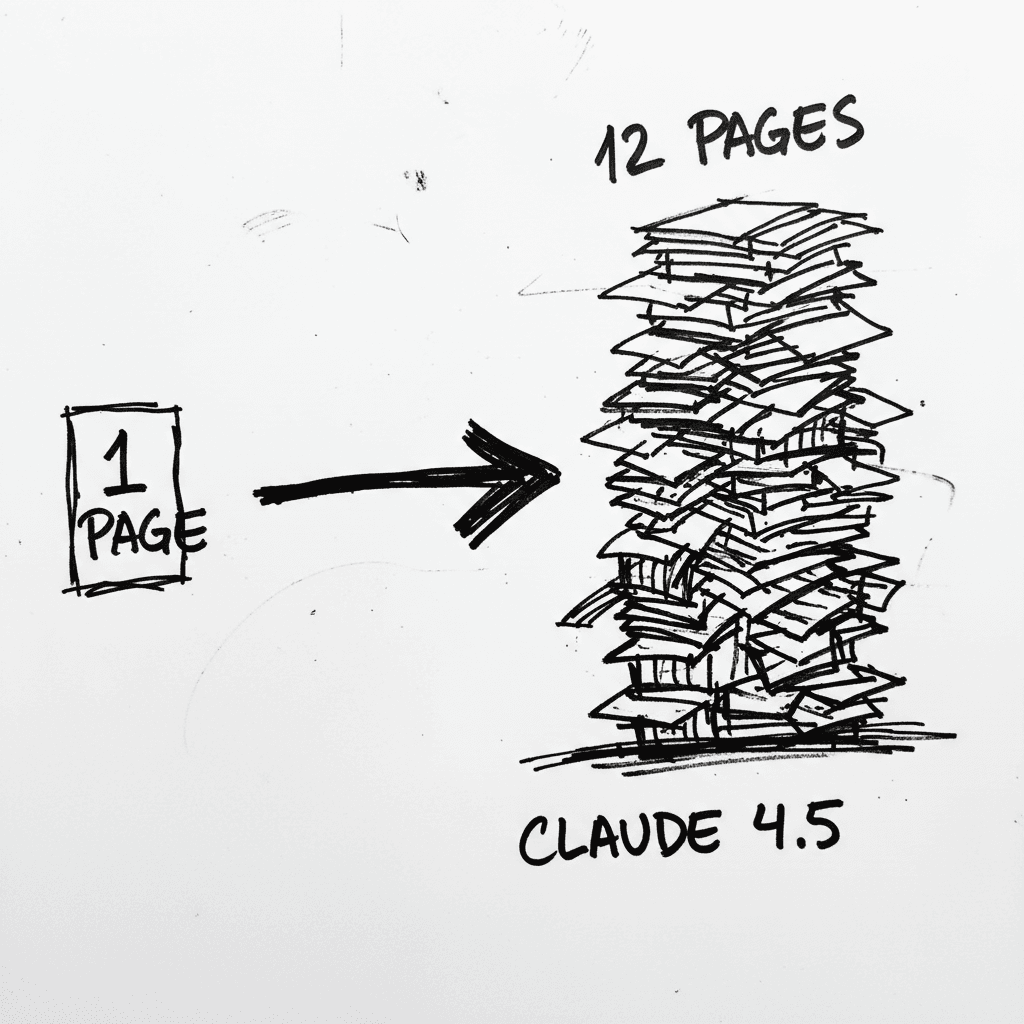

Anthropic Claude 4.5 Opus : l'élongation documentaire comme indicateur de productivité

Le déploiement de Claude 4.5 Opus en entreprise a validé sa capacité à générer des artifacts professionnels sophistiqués (Dossier UsedBy). Les intégrations majeures chez Quora et Notion confirment que

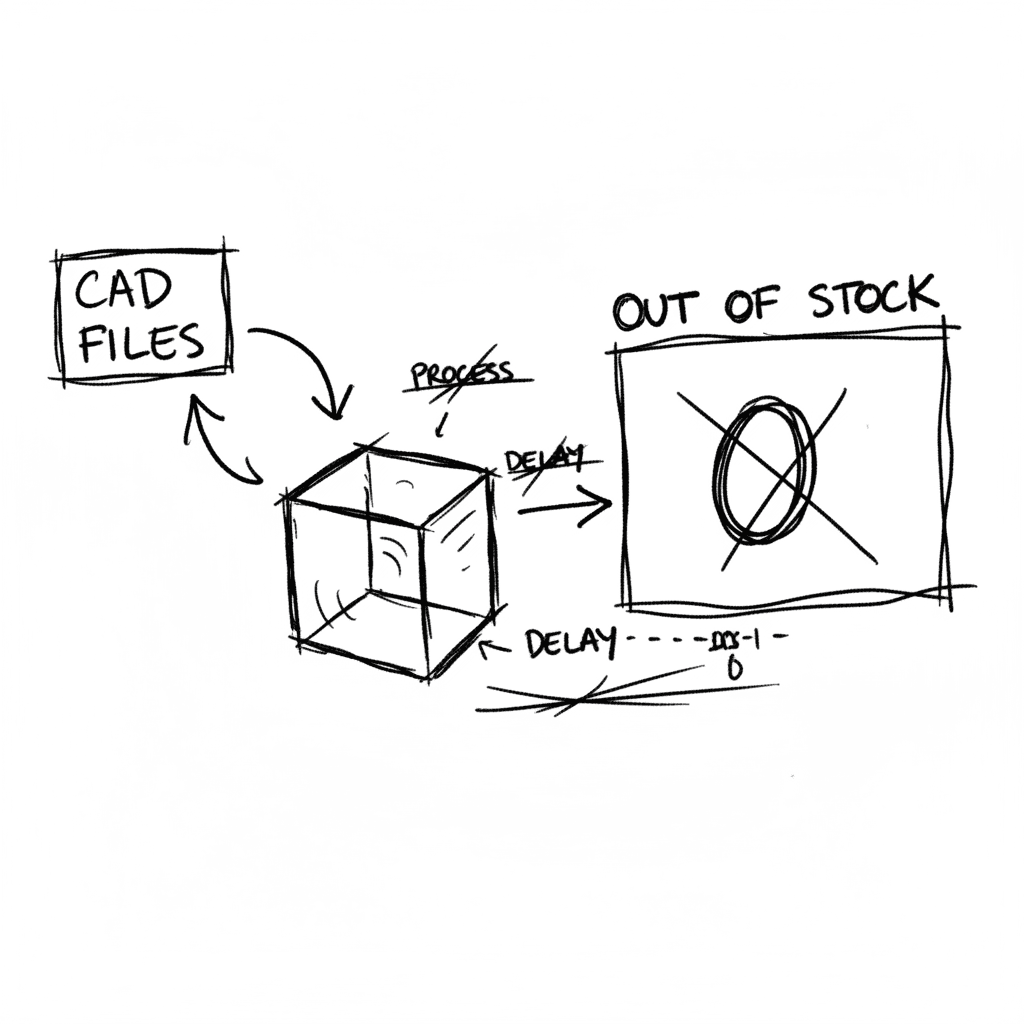

Valve Steam Controller 2026 : Ouverture des fichiers CAO et rupture de stock immédiate

Valve a libéré les fichiers CAO (STP, STL) de la coque externe du nouveau Steam Controller et de son "Puck" magnétique sous licence Creative Commons BY-NC-SA 4.0 (Source: Valve Official Announcement).

Restez à la pointe des tendances d'adoption de l'IA

Recevez nos derniers rapports et analyses directement dans votre boîte mail. Pas de spam, que des données.