Mistral Forge: infraestructura de entrenamiento soberano y la sombra del SFT denso

Mistral AI ha lanzado Forge, una plataforma integral diseñada para que las empresas construyan modelos propietarios desde el pre-entrenamiento hasta el aprendizaje por refuerzo. La propuesta se centra

El Pitch

Mistral AI ha lanzado Forge, una plataforma integral diseñada para que las empresas construyan modelos propietarios desde el pre-entrenamiento hasta el aprendizaje por refuerzo. La propuesta se centra en permitir el control total del ciclo de vida del modelo en infraestructura soberana europea o clústeres privados de GPUs (fuente: Mistral AI Official).

Bajo el capó

El modelo insignia de esta suite, Devstral 2 (123B), ha alcanzado un 72.2% en SWE-bench Verified, posicionándose como una alternativa real para tareas de ingeniería de software complejas (fuente: Mistral AI News). Forge soporta técnicamente todo el flujo de trabajo moderno: SFT, DPO, ODPO y Reinforcement Learning sobre hardware propio como Nvidia DGX Cloud (fuente: VentureBeat).

Existe una fricción considerable en la adopción debido a la confusa nomenclatura de modelos como Devstral 2 frente a devstral-2512, lo que genera dudas sobre la consistencia de la arquitectura (fuente: Hacker News). Varios analistas cuestionan si el módulo de "pre-training" es realmente tal o simplemente un Supervised Fine-Tuning (SFT) de alta densidad, dado que pocas empresas poseen el volumen de datos necesario para un entrenamiento base (fuente: HN).

En términos de eficiencia económica, el uso de la API de Devstral 2 se sitúa en $0.40 por millón de tokens de entrada, lo que resulta aproximadamente 7 veces más barato que utilizar Claude 4 Sonnet (fuente: DigitalApplied). Esta ventaja competitiva es el principal motor para empresas con volúmenes masivos de inferencia que buscan optimizar márgenes sin sacrificar rendimiento.

Aún no sabemos cuál es el tamaño de dataset mínimo que justifica el uso del módulo de pre-entrenamiento frente a un fine-tuning convencional (fuente: Dossier UsedBy). Tampoco se han hecho públicos los costes específicos de licenciamiento de la plataforma Forge más allá de las tarifas de uso de API (fuente: Dossier UsedBy).

La opinión de Diego

Mistral Forge no es para jugar a los side-projects de fin de semana; es una herramienta pesada para CTOs con presupuestos de infraestructura serios y racks de H100s cogiendo polvo. Aunque el marketing insista en el pre-entrenamiento, el valor real aquí es el ahorro masivo de costes comparado con las APIs de Claude 4 Sonnet o GPT-5 y la capacidad de ejecutar DPO sobre datos sensibles sin que salgan de la UE. Si tienes los datos y el hardware, es un movimiento lógico para producción; si no, intentar gestionar un modelo denso de 123B solo te traerá dolores de cabeza y facturas de cómputo que ni tu CFO podrá explicar. Una vez intenté configurar un clúster similar en mis tiempos de dev y casi provoco un apagón en mi oficina, así que ya sabes a qué te enfrentas.

Código limpio siempre,

Diego.

Diego Navarro - Early Adopter Tech Analyst at UsedBy.ai

Artículos relacionados

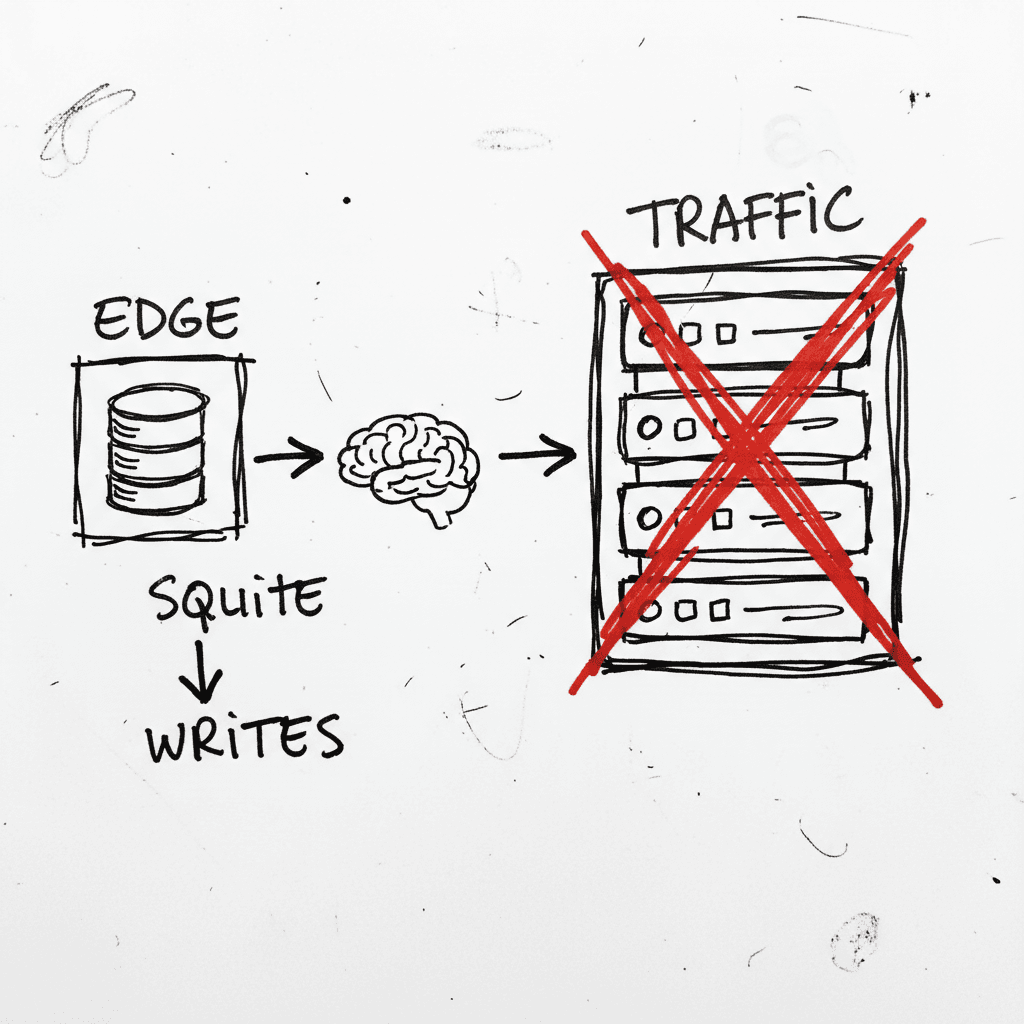

SQLite: El estándar de la Library of Congress para la persistencia en el edge

SQLite ha dejado de ser considerado una base de datos "de juguete" para convertirse en el estándar de facto en despliegues local-first y arquitecturas edge en 2026. Su reconocimiento por parte de la L

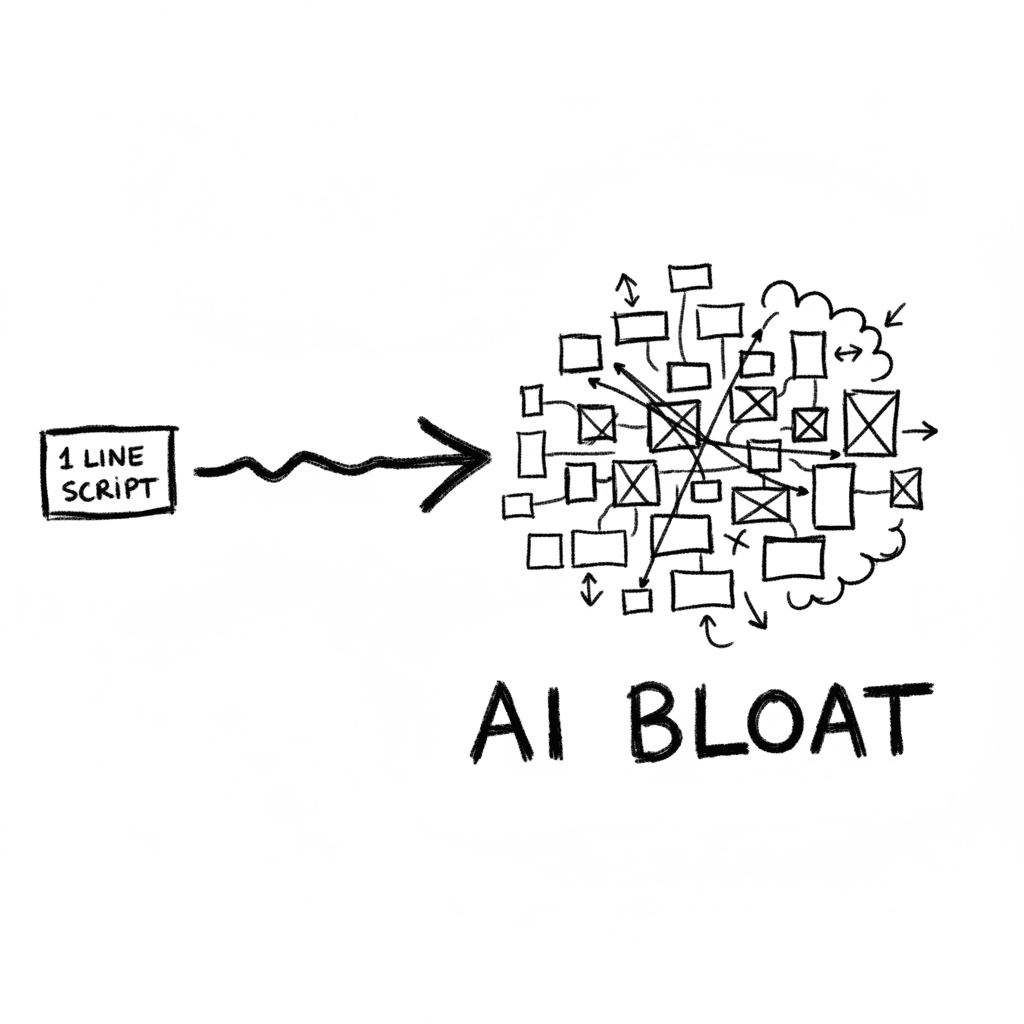

La paradoja de la productividad y la elongación de artefactos por IA

Claude 4.5 Opus y GPT-5 han permitido que perfiles junior generen entregables que, a primera vista, parecen obra de un senior con años de experiencia. La comunidad en Hacker News está analizando cómo

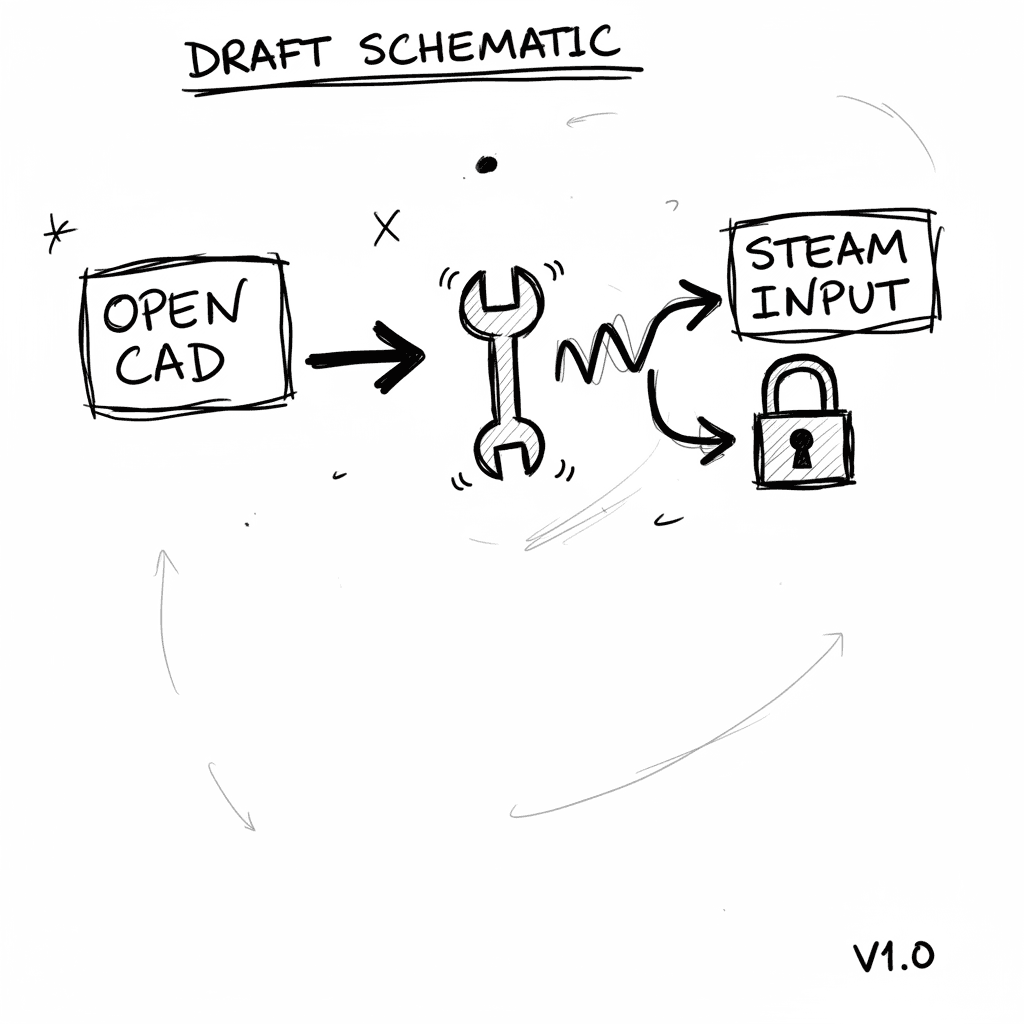

Steam Controller 2026 y Steam Controller Puck: CAD abierto y sticks TMR

Valve ha trasladado la tecnología de sticks TMR y los trackpads duales de la Steam Deck a un mando independiente que busca estandarizar el input de alta precisión. La gran noticia para la comunidad de

Mantente al día con las tendencias de adopción de IA

Recibe nuestros últimos informes y análisis en tu correo. Sin spam, solo datos.