Nvidia Greenboost — En nuestro radar

Nvidia Greenboost — En nuestro radar

Estado: 🟡 En observación

Por qué hablamos de esto: Promete ejecutar modelos locales de clase GPT-5 en hardware de consumo extendiendo la VRAM hacia la RAM y el NVMe mediante un hack de software (GitLab/Phoronix).

Lo que sabemos:

- Es un shim de CUDA en espacio de usuario desarrollado por Ferran Duarri que intercepta asignaciones de memoria mediante LD_PRELOAD (GitLab Documentation).

- Permite un offload nativo del KV cache para ExLlamaV3, una funcionalidad ausente en la mayoría de implementaciones actuales (Reddit/LocalLLaMA).

- Utiliza DMA-BUF e incluye un hilo de watchdog en el kernel para intentar mitigar cuelgues por falta de memoria (GitLab Issue #3).

- El rendimiento real está limitado por el ancho de banda del bus PCIe 4.0/5.0, ofreciendo apenas entre 2 y 5 tokens por segundo (Phoronix).

Las zonas grises:

- No existen comparativas oficiales de rendimiento frente a los quants locales de GPT-5 Mini en las nuevas GPUs Blackwell serie 50 (Dossier UsedBy).

- Faltan datos de estabilidad técnica para entornos de servidor que requieran alta disponibilidad (Dossier UsedBy).

- Se desconoce su compatibilidad con las funciones propietarias del driver NVIDIA 595.x "Blackwell-Ultra" (Dossier UsedBy).

Este artículo se actualizará cuando tengamos más datos. Mientras tanto, precaución.

Código limpio siempre,

Diego.

Diego Navarro - Early Adopter Tech Analyst at UsedBy.ai

Artículos relacionados

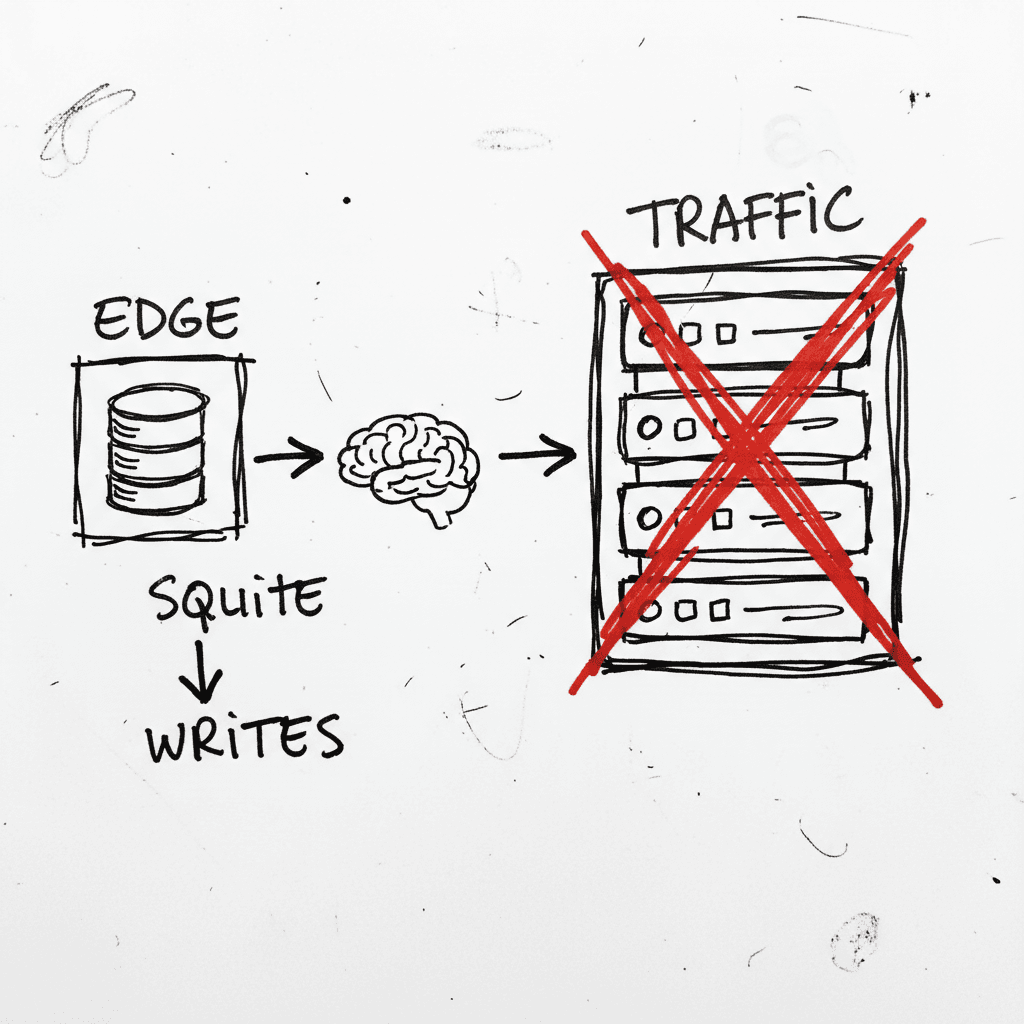

SQLite: El estándar de la Library of Congress para la persistencia en el edge

SQLite ha dejado de ser considerado una base de datos "de juguete" para convertirse en el estándar de facto en despliegues local-first y arquitecturas edge en 2026. Su reconocimiento por parte de la L

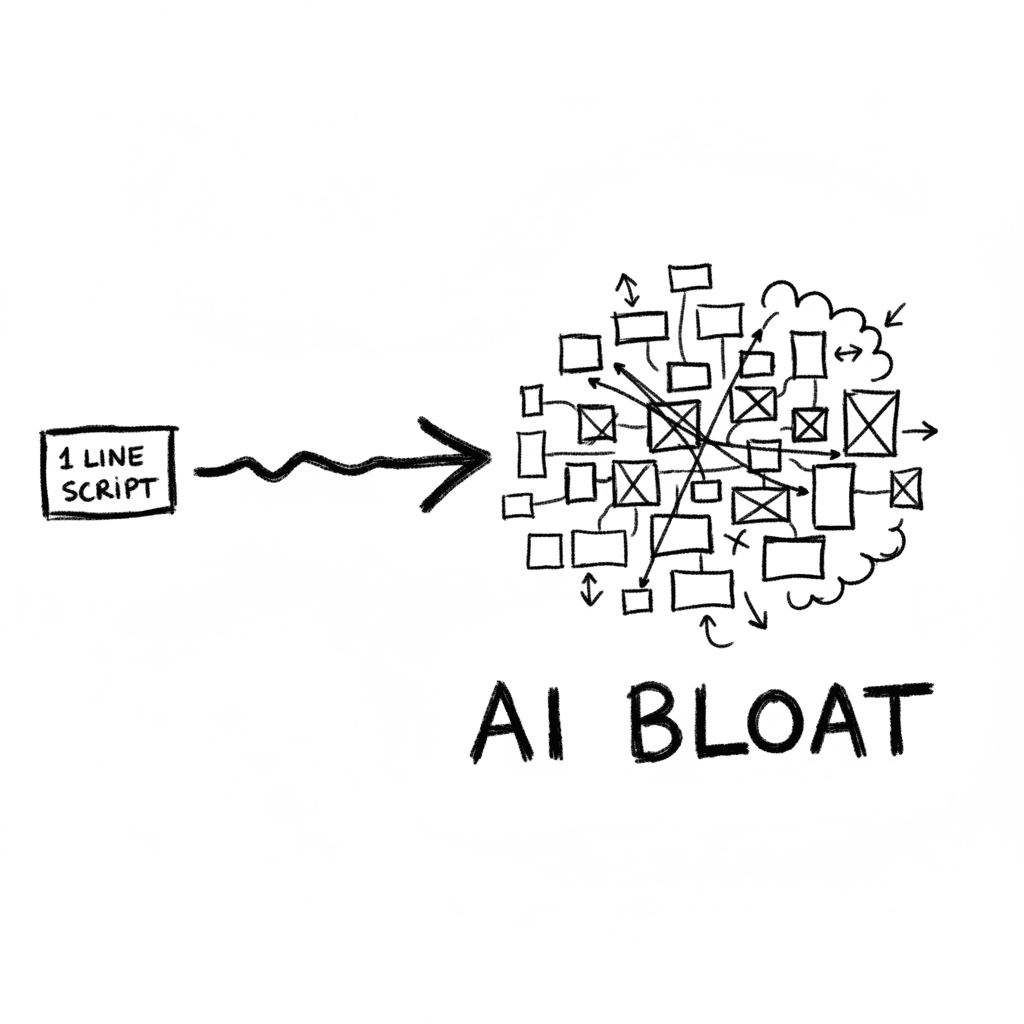

La paradoja de la productividad y la elongación de artefactos por IA

Claude 4.5 Opus y GPT-5 han permitido que perfiles junior generen entregables que, a primera vista, parecen obra de un senior con años de experiencia. La comunidad en Hacker News está analizando cómo

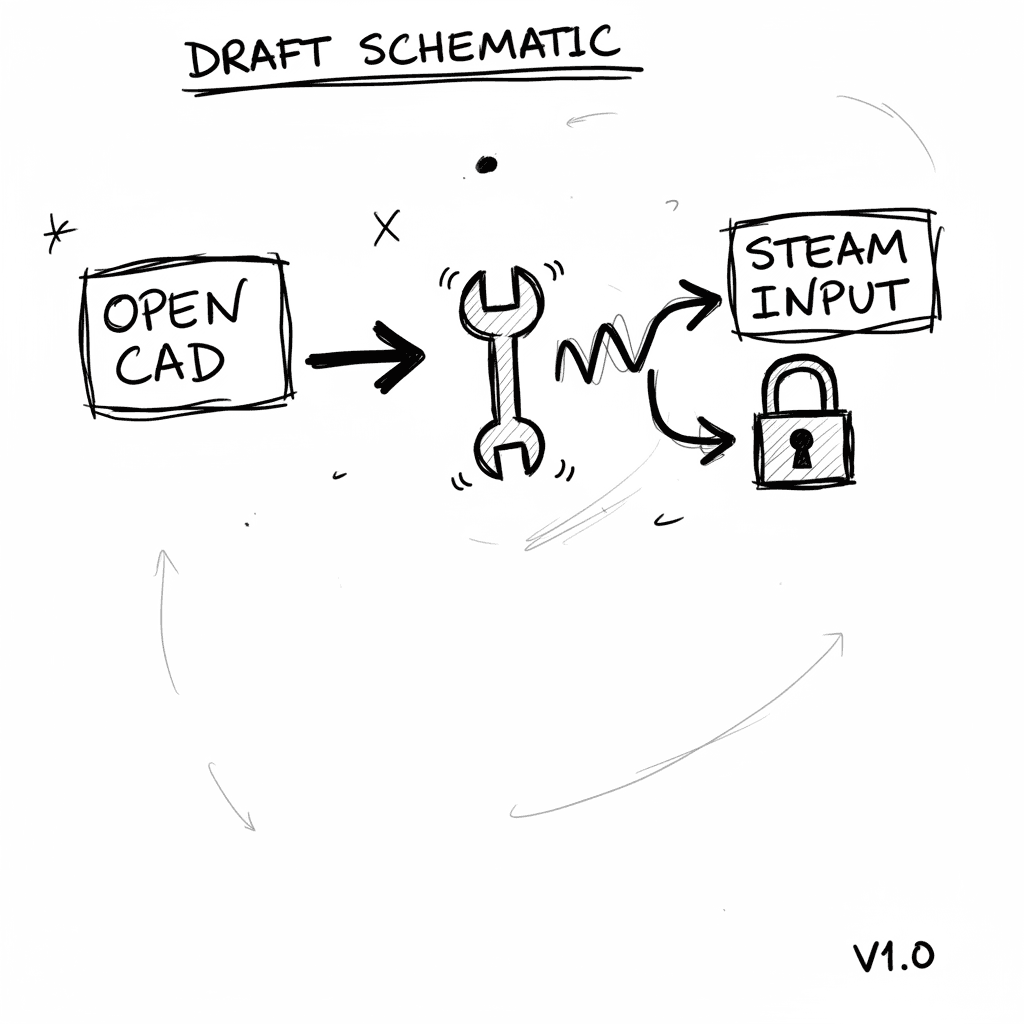

Steam Controller 2026 y Steam Controller Puck: CAD abierto y sticks TMR

Valve ha trasladado la tecnología de sticks TMR y los trackpads duales de la Steam Deck a un mando independiente que busca estandarizar el input de alta precisión. La gran noticia para la comunidad de

Mantente al día con las tendencias de adopción de IA

Recibe nuestros últimos informes y análisis en tu correo. Sin spam, solo datos.