Voxtral-mini-realtime-rs : l'inférence audio 4B locale en Rust et WASM

Ce projet est un portage Rust de l'architecture Voxtral Mini 4B de Mistral optimisé pour le Speech-to-Text (STT) et le traitement audio temps réel. L'objectif est de faire tourner un modèle de 4 milli

Le Pitch

Ce projet est un portage Rust de l'architecture Voxtral Mini 4B de Mistral optimisé pour le Speech-to-Text (STT) et le traitement audio temps réel. L'objectif est de faire tourner un modèle de 4 milliards de paramètres directement dans le navigateur via WebAssembly (source: GitHub).

Sous le capot

L'exécution côté client repose sur une version quantizée du modèle dont l'empreinte mémoire s'élève à 2,5 GB (source: HN). C’est techniquement plus léger que les variantes haute précision de Whisper.wasm, mais cela impose une barrière d'entrée massive pour l'utilisateur final.

Salvatore Sanfilippo (Antirez) a déjà validé la viabilité de l'architecture avec sa propre implémentation de référence en C, voxtral.c (source: HN). La version Rust actuelle cherche à stabiliser cette performance pour le web, bien que des questions subsistent sur la nécessité de maintenir les poids "pinnés" en mémoire GPU pour garantir la latence (source: HN).

Des forks actifs, notamment par HorizonXP, intègrent déjà le support CUDA pour déporter le calcul hors du navigateur et viser des performances locales maximales (source: HN). On reste cependant dans le flou concernant l'impact thermique et la consommation batterie sur les terminaux mobiles en usage prolongé.

Sur le plan de la précision pure, aucune donnée n'est disponible pour comparer ce modèle 4B aux pipelines audio natifs de GPT-5 ou Gemini 2.5 Live. On ne sait pas encore si le trade-off entre latence locale et qualité de transcription justifie l'abandon des API cloud actuelles. Les termes de licence commerciale pour l'utilisation des poids Voxtral en 2026 ne sont pas non plus explicités dans le dépôt (source: Dossier UsedBy).

L'avis de Ruben

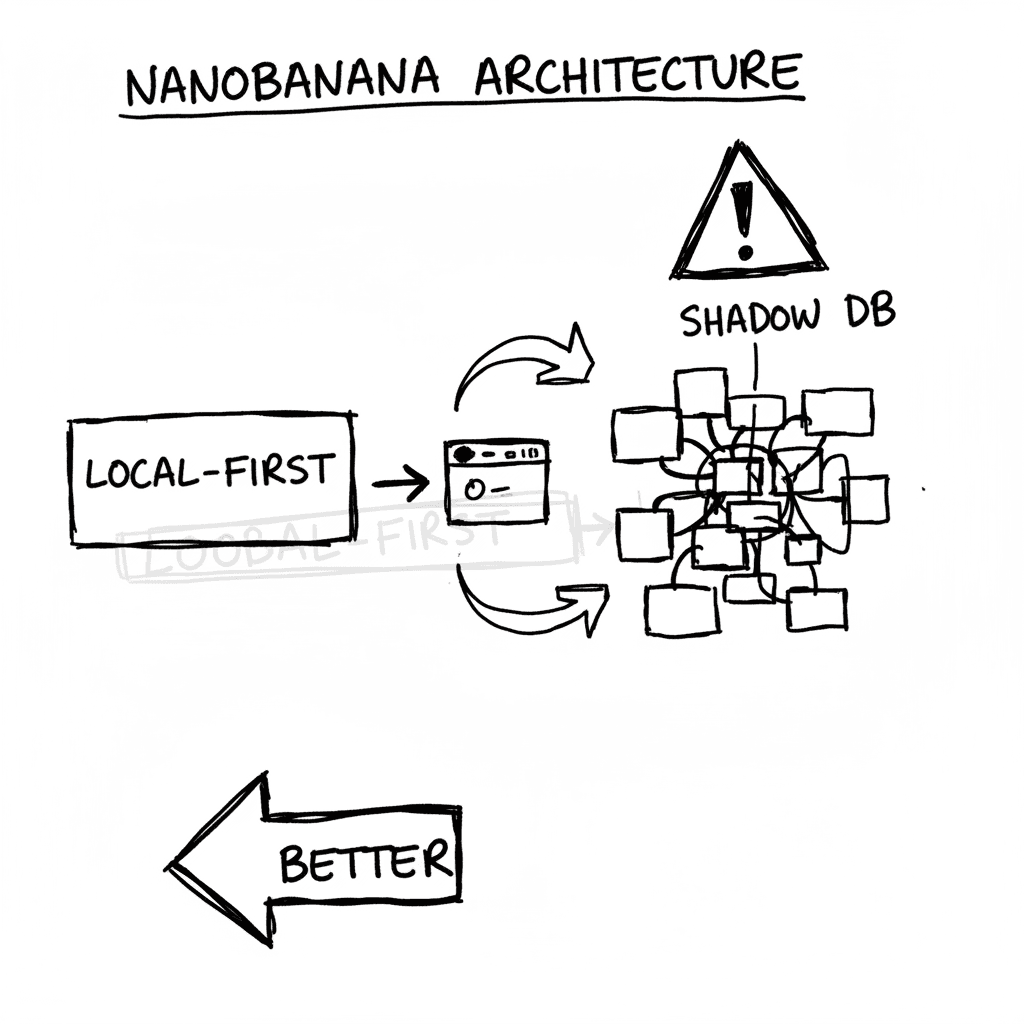

C'est une prouesse technique pour les adeptes du local-first, mais un cauchemar d'UX pour le web grand public. Personne n'attendra le téléchargement de 2,5 GB de data avant de pouvoir utiliser une fonction de dictée vocale, surtout quand GPT-5 traite l'audio en streaming avec une latence quasi imperceptible.

L'intérêt est ailleurs : pour des applications desktop packagées via Tauri ou des outils d'analyse audio offline où la confidentialité est non négociable. Pour le reste, c'est un excellent side-project pour tester les limites de Rust et WASM, mais c'est encore trop lourd pour de la production web standard.

Codez propre,

Ruben.

Ruben Isaac - Lead AI Tech Watcher at UsedBy.ai

Articles connexes

SQLite 3.53.1 : Standard de persévérance et architecture Edge

SQLite est devenu en 2026 le format de stockage universel recommandé par la Library of Congress pour la conservation de données à long terme (source: loc.gov). Loin d'être un simple utilitaire, il s'e

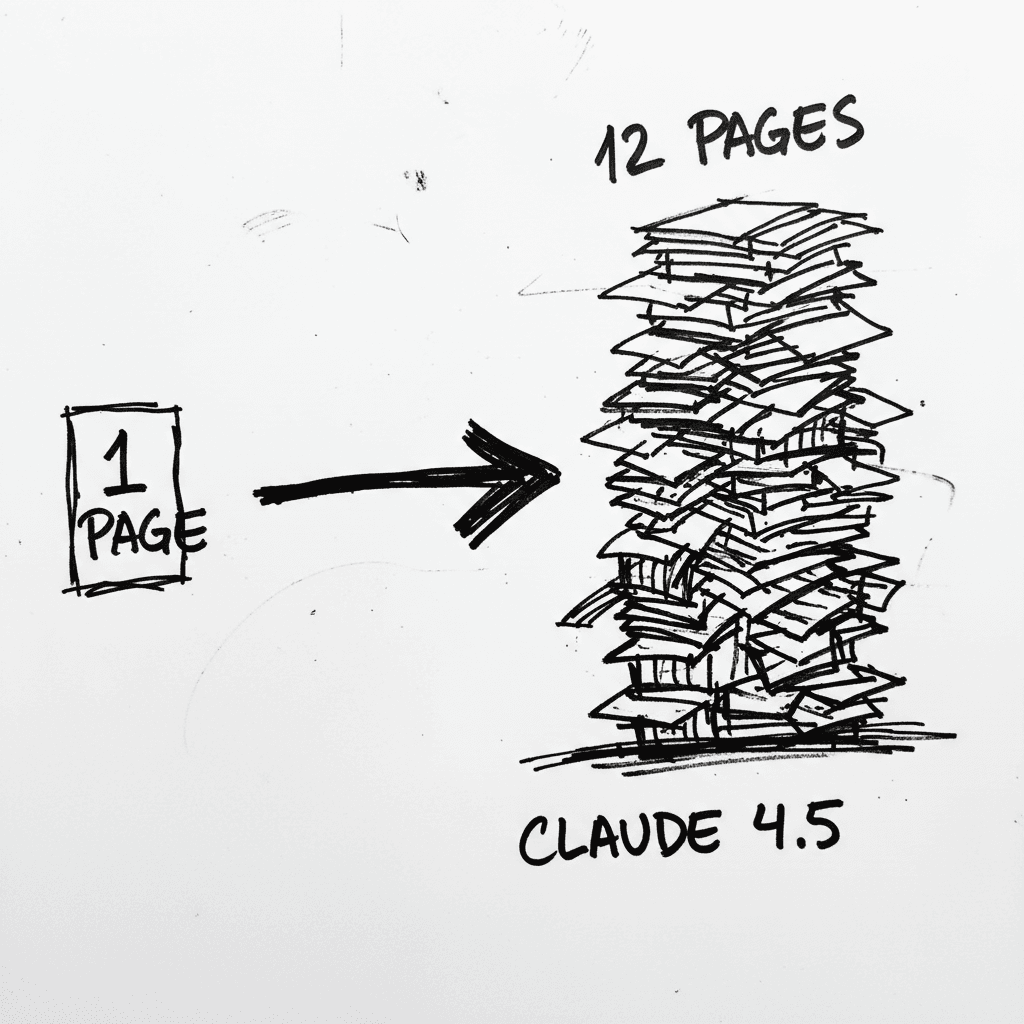

Anthropic Claude 4.5 Opus : l'élongation documentaire comme indicateur de productivité

Le déploiement de Claude 4.5 Opus en entreprise a validé sa capacité à générer des artifacts professionnels sophistiqués (Dossier UsedBy). Les intégrations majeures chez Quora et Notion confirment que

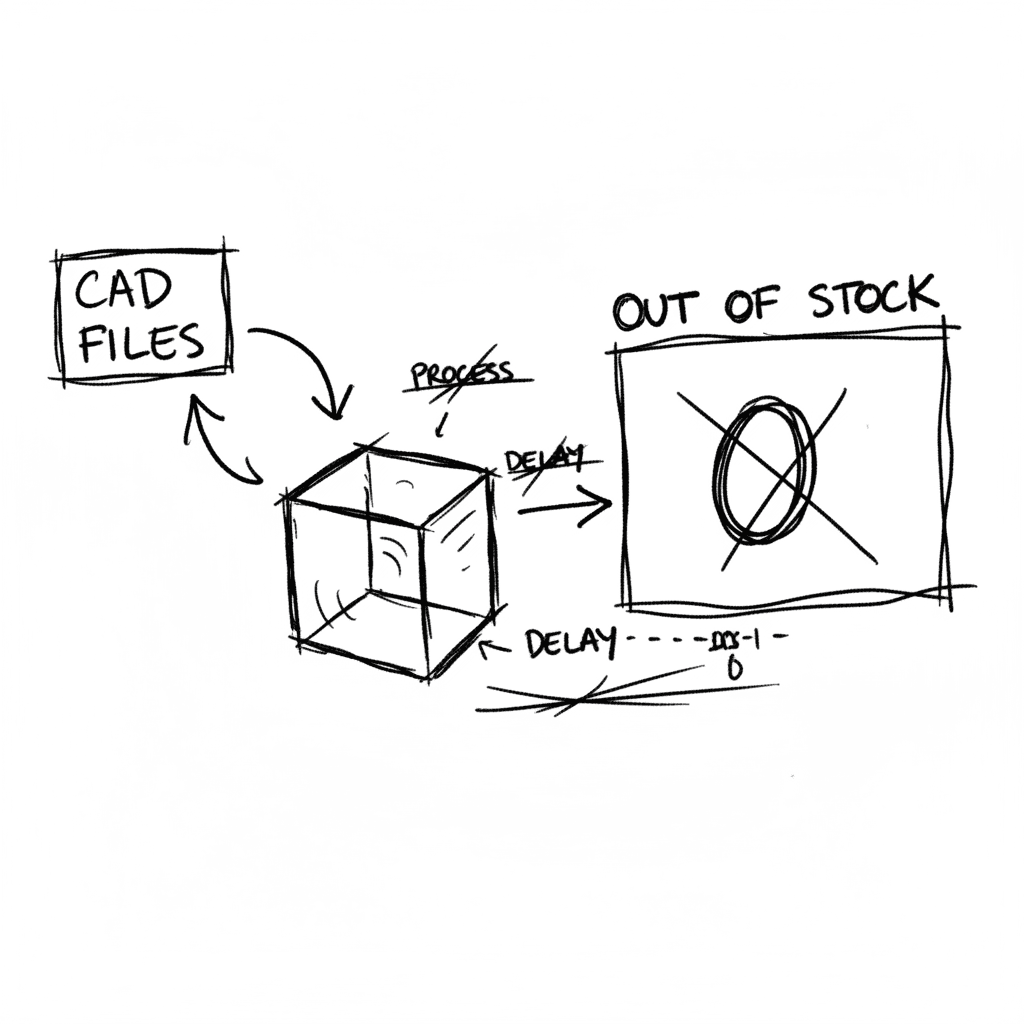

Valve Steam Controller 2026 : Ouverture des fichiers CAO et rupture de stock immédiate

Valve a libéré les fichiers CAO (STP, STL) de la coque externe du nouveau Steam Controller et de son "Puck" magnétique sous licence Creative Commons BY-NC-SA 4.0 (Source: Valve Official Announcement).

Restez à la pointe des tendances d'adoption de l'IA

Recevez nos derniers rapports et analyses directement dans votre boîte mail. Pas de spam, que des données.