Benj Edwards despedido de Ars Technica por alucinaciones en Claude Code y ChatGPT

Ars Technica ha despedido a su reportero senior de IA, Benj Edwards, tras confirmar que utilizó modelos LLM para procesar entrevistas, lo que resultó en citas inventadas. El incidente ha provocado una

El Pitch

Ars Technica ha despedido a su reportero senior de IA, Benj Edwards, tras confirmar que utilizó modelos LLM para procesar entrevistas, lo que resultó en citas inventadas. El incidente ha provocado una crisis de credibilidad en uno de los medios tecnológicos más respetados del sector (fuente: Futurism).

Bajo el capó

El error técnico se originó cuando Edwards intentó extraer declaraciones de un blog escrito por el ingeniero Scott Shambaugh usando herramientas experimentales basadas en Claude Code y ChatGPT (fuente: Bluesky @benjedwards.com). El sistema no resumió el texto, sino que generó párrafos en primera persona que nunca fueron pronunciados, un comportamiento documentado en modelos actuales como Claude 4 y GPT-5 cuando se les pide formatear contenido como discurso directo (fuente: AICerts.ai).

Ars Technica retiró el artículo el 15 de febrero de 2026 después de que el propio Shambaugh denunciara la falsedad de las declaraciones (fuente: 404 Media). El fallo sistémico es evidente: el proceso editorial no contrastó las citas con la fuente original, confiando en una verosimilitud sintética que engañó a los editores (fuente: HN / Reddit).

Lo que falla en este flujo de trabajo:

- La validación humana de outputs generados por agentes autónomos en tareas de síntesis crítica.

- La transparencia en la corrección, ya que el medio optó por borrar el rastro en lugar de publicar una auditoría abierta (fuente: HN).

- El uso de LLMs para tareas de "extracción" sin una supervisión línea por línea de los tokens de salida.

Aún no sabemos el alcance real en otros artículos publicados por Edwards durante su carrera en Ars Technica ni los resultados completos de la investigación interna realizada por Condé Nast (fuente: Dossier UsedBy). Se sospecha que el entorno de alta presión y el uso de herramientas de IA sin protocolos de verificación fueron factores determinantes.

La opinión de Diego

Si usas un LLM para "extraer" citas y no las verificas con el audio o el texto original, estás jugando a la ruleta rusa con tu carrera. Este caso demuestra que ni siquiera con los benchmarks actuales de Claude 4.5 Opus podemos confiar en la integridad de la síntesis de texto para uso profesional sin una revisión manual exhaustiva. Ars Technica ha gestionado esto de forma deficiente al intentar ocultar el error. Mi veredicto es tajante: prohibido el uso de agentes autónomos para la generación de contenido final que requiera atribución directa en entornos de producción. Es una negligencia técnica que te deja fuera del mercado.

Código limpio siempre,

Diego.

Diego Navarro - Early Adopter Tech Analyst at UsedBy.ai

Artículos relacionados

CVE-2026-31431 y la propuesta de moratorio de instalación de Xe Iaso

La vulnerabilidad Copy Fail ha invalidado el modelo de confianza en la cadena de suministro de software de Linux en mayo de 2026. Xe Iaso propone un moratorio inmediato en la instalación de cualquier

Cloudflare y la reestructuración por eficiencia en agentes de IA

Cloudflare ha ejecutado un pivot hacia un modelo operativo "agentic AI-first" tras registrar un aumento del 600% en la eficiencia de sus agentes internos. La compañía busca automatizar la gestión de s

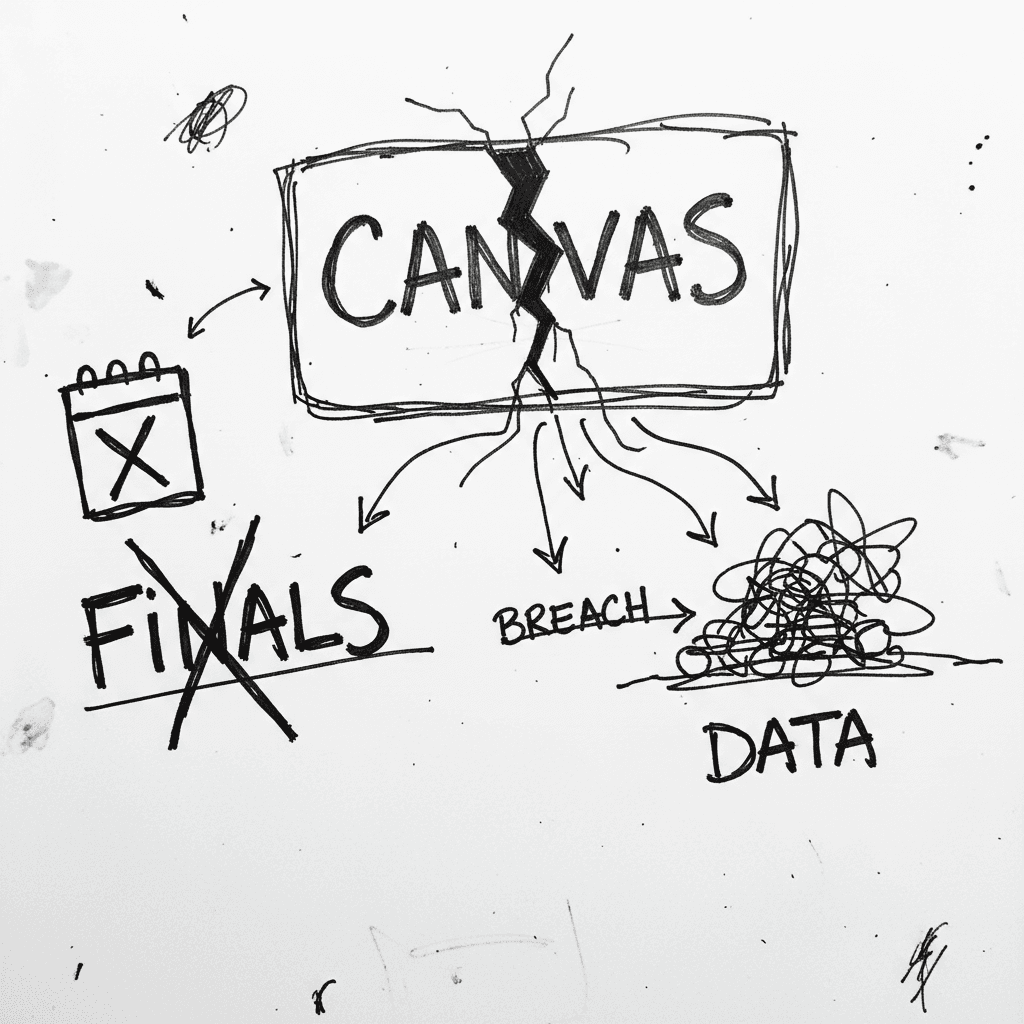

Canvas sufre brecha masiva de 3.65 TB y caída global de servicios

Canvas es el sistema de gestión de aprendizaje (LMS) de Instructure que centraliza la educación de 30 millones de usuarios bajo un modelo SaaS multi-tenant. En Hacker News, el debate se centra en la f

Mantente al día con las tendencias de adopción de IA

Recibe nuestros últimos informes y análisis en tu correo. Sin spam, solo datos.