El fin del token tax: Local-First AI y hardware de 2026

La infraestructura local ha alcanzado el punto de inflexión donde la latencia de red es más cara que el silicio en tu escritorio. El manifiesto de cylo propone eliminar la dependencia de las APIs de A

El Pitch

La infraestructura local ha alcanzado el punto de inflexión donde la latencia de red es más cara que el silicio en tu escritorio. El manifiesto de cylo propone eliminar la dependencia de las APIs de Anthropic y OpenAI para priorizar la privacidad y el coste cero por ejecución. Es la respuesta técnica a la saturación de modelos cloud que, aunque capaces, introducen fricción innecesaria en flujos de trabajo de alta frecuencia.

Bajo el capó

El hardware de consumo actual finalmente permite lo que hace dos años era impensable para un desarrollador independiente. El Apple M5 Max, lanzado a principios de este año, ofrece un ancho de banda de memoria de 614 GB/s, lo que permite ejecutar modelos de 70B parámetros a 28 tokens por segundo (fuente: aiproductivity.ai). Para quienes prefieren x86, las APUs AMD Strix Halo mantienen 10 tok/s en modelos de razonamiento destilados como Qwen 3.5 27B usando memoria unificada (fuente: tinycomputers.io).

En términos de frameworks, MLX se ha consolidado como el estándar sobre el silicio de Apple, logrando entre un 40% y 80% más de throughput que herramientas heredadas como Ollama (fuente: aiproductivity.ai). La paridad en tareas de ingeniería también es un hecho: Qwen 3.6-Plus ya compite directamente con Claude 4.5 Opus en el benchmark SWE-bench Verified para tareas de agentes de código (fuente: Reddit r/AI_Agents).

Sin embargo, el enfoque local tiene cuellos de botella críticos que el marketing suele omitir. El rendimiento de la inferencia se degrada drásticamente a medida que se llena la ventana de contexto, a diferencia de la inferencia distribuida en la nube (fuente: YouTube - Zen van Riel). Además, existe una brecha de hardware insalvable para muchos: necesitas entre 64GB y 128GB de VRAM para una experiencia profesional, lo que excluye a equipos con más de dos años de antigüedad (fuente: HN).

También hay riesgos de seguridad emergentes en este ecosistema. Se han detectado troyanos de acceso remoto en plugins de IA para Obsidian que aprovechan la ejecución local de modelos (fuente: netsecops.io). Por último, aún no sabemos si el consumo eléctrico de agentes locales corriendo 24/7 es realmente más eficiente que las llamadas a APIs de alta densidad, ni tenemos datos claros sobre la fiabilidad a largo plazo de los modelos destilados en debugging de casos de borde frente a modelos frontera nativos (Dossier UsedBy).

La opinión de Diego

Mueve tus agentes de ejecución de código y tus pipelines de alta frecuencia a local ahora mismo; el ahorro en latencia y facturas de API justifica la inversión en un M5 Max de 128GB. Sin embargo, no apagues tu suscripción a Claude 4.5 Opus todavía. Para el planeamiento arquitectónico de alto nivel y el razonamiento complejo en frío, el cloud sigue teniendo una ventaja en coherencia que los modelos destilados locales no alcanzan a replicar. El estándar de la industria este año no es "todo local", sino un enfoque híbrido inteligente.

Código limpio siempre,

Diego.

Diego Navarro - Early Adopter Tech Analyst at UsedBy.ai

Artículos relacionados

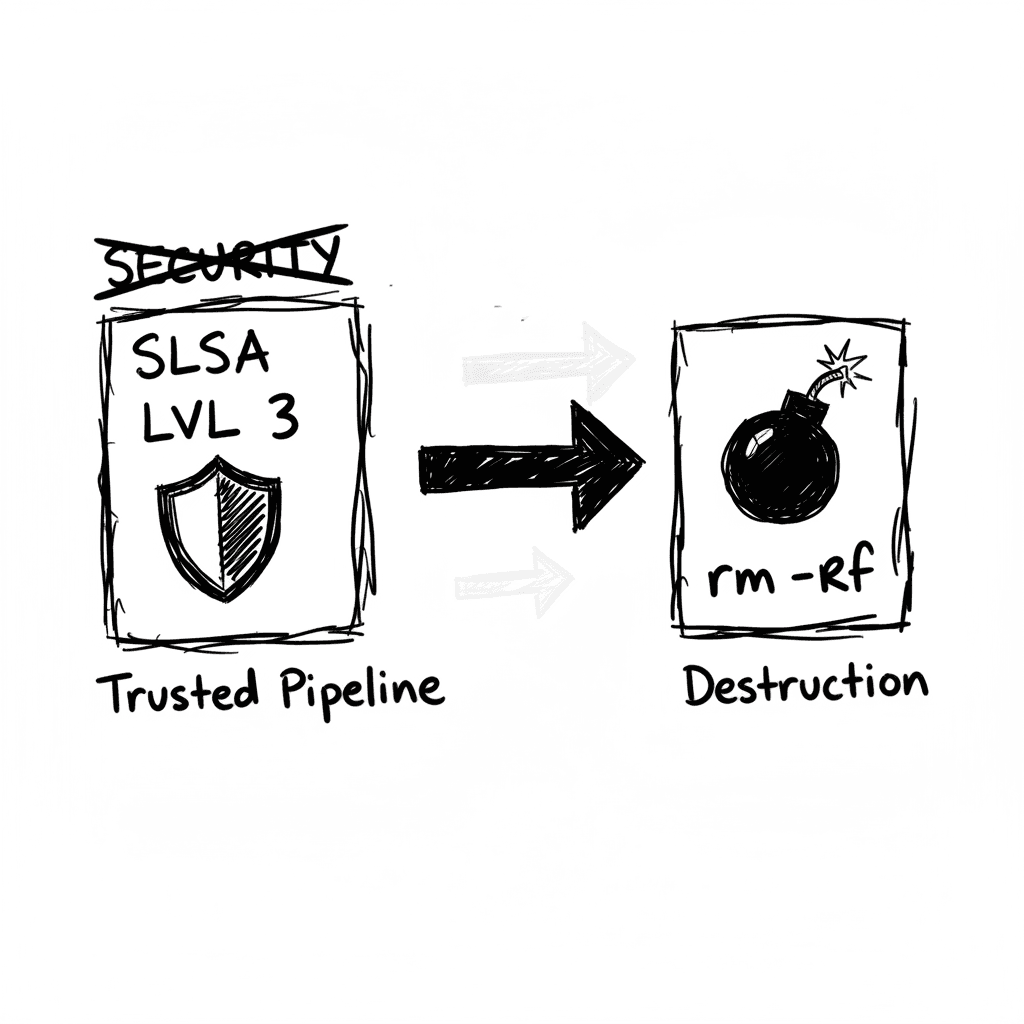

Compromiso masivo del ecosistema TanStack: 42 paquetes infectados con carga destructiva

TanStack es el estándar de la industria para el manejo de estado y enrutado con seguridad de tipos en el frontend moderno. El 11 de mayo de 2026, este ecosistema sufrió un compromiso de cadena de sumi

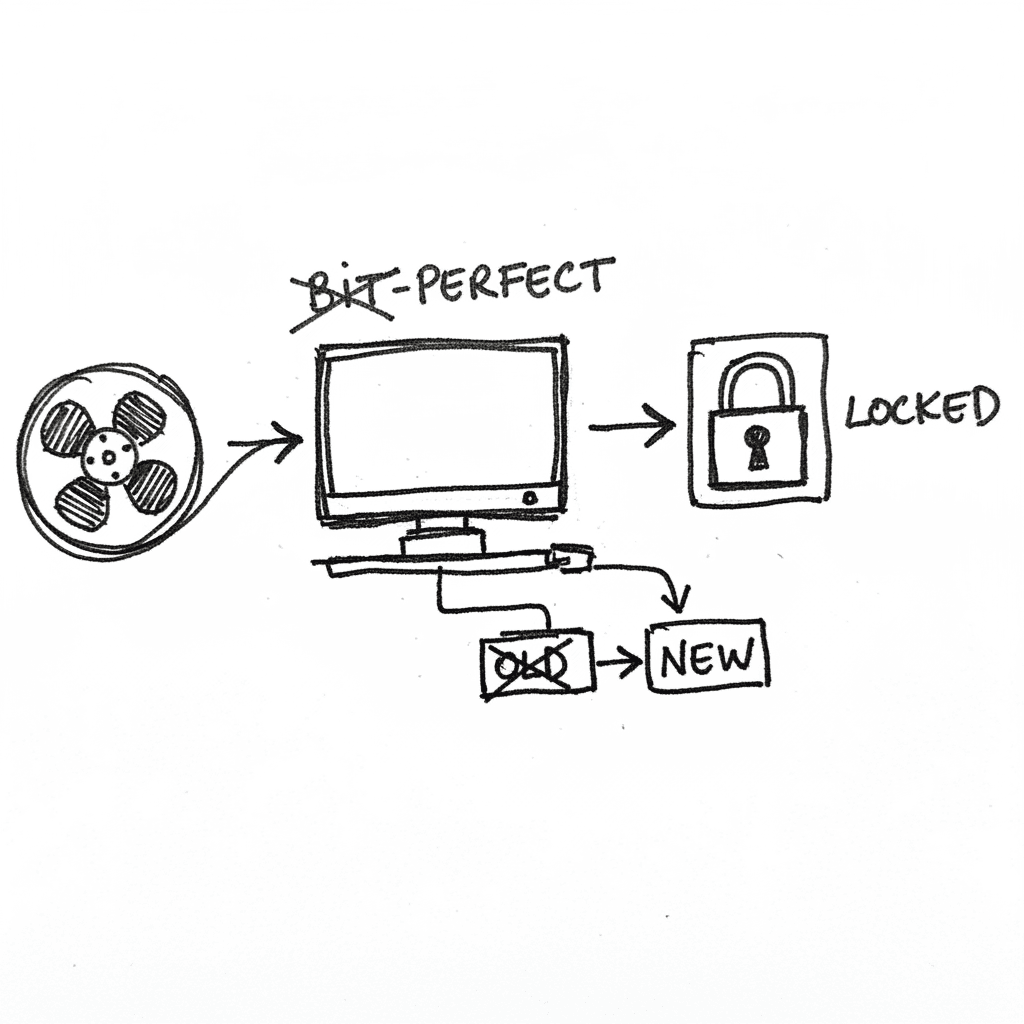

Typewritten Software Media Archive: Precisión bit-perfect en la preservación de sistemas legacy

Typewritten Software Media Archive es un museo digital especializado en la documentación técnica y captura de pantalla de alta fidelidad de sistemas operativos raros. En este ecosistema de 2026 domina

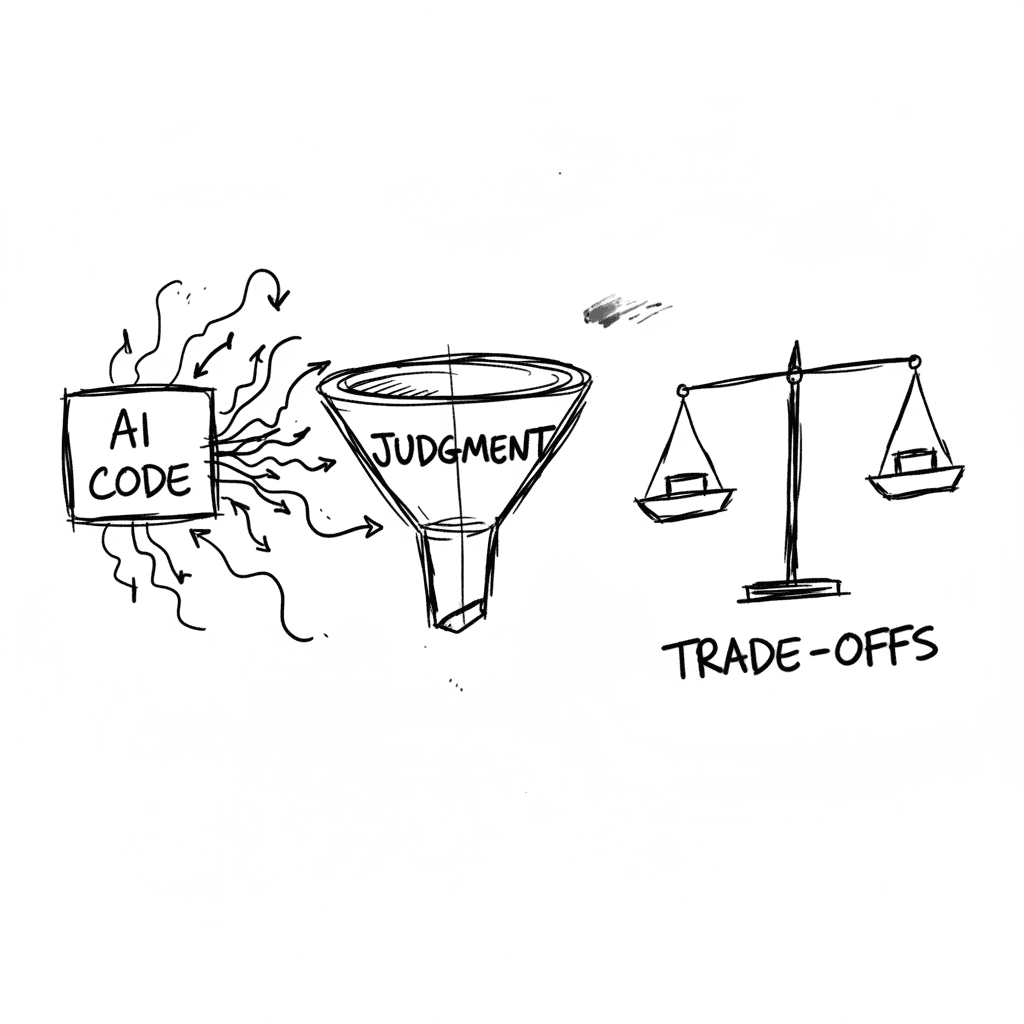

El juicio arquitectónico como cuello de botella en la era de la IA generativa

Alex Kladov (matklad) sostiene que la arquitectura de software no es un conjunto de reglas para memorizar, sino un oficio basado en el juicio clínico desarrollado mediante el estudio de sistemas legac

Mantente al día con las tendencias de adopción de IA

Recibe nuestros últimos informes y análisis en tu correo. Sin spam, solo datos.