El pulso legal entre Anthropic y el Department of War por Claude 4.5

Anthropic mantiene un bloqueo técnico en Claude 4.5 Opus para impedir su uso en vigilancia masiva doméstica y armamento autónomo (fuente: Dossier UsedBy). Esta postura ha llevado al gobierno a amenaza

El Pitch

Anthropic se enfrenta a una amenaza directa del Department of War para eliminar las salvaguardas de seguridad de Claude 4.5 Opus y adaptarlo a fines bélicos (fuente: Anthropic News / HN Thread Feb 2026). La herramienta es actualmente el estándar de privacidad para 247 empresas en nuestra base de datos, incluyendo nombres como Notion, DuckDuckGo y Quora. Ver ficha de Claude.

Bajo el capó

Anthropic mantiene un bloqueo técnico en Claude 4.5 Opus para impedir su uso en vigilancia masiva doméstica y armamento autónomo (fuente: Dossier UsedBy). Esta postura ha llevado al gobierno a amenazar con invocar la Defense Production Act (DPA) para forzar una versión a medida del modelo, llegando a calificar a la empresa como un "riesgo para la cadena de suministro" (fuente: HN Statement by Dario Amodei).

Lo que funciona:

- El frente unido de la industria: empleados de los equipos de GPT-5 en OpenAI y Gemini 2.5 en Google han firmado la carta "We Will Not Be Divided" en apoyo a Anthropic (fuente: notdivided.org).

- La arquitectura de seguridad actual sigue resistiendo intentos de bypass para aplicaciones militares letales (fuente: Dossier UsedBy).

Lo que falla:

- La "ambigüedad estratégica": críticos señalan que la negativa de Anthropic se basa en la "falta de fiabilidad actual" del modelo, lo que sugiere que Claude 5 o modelos posteriores sí podrían usarse en combate si son más precisos (fuente: HN Comment analysis).

- El uso de la palabra "doméstica" en su rechazo a la vigilancia deja un vacío legal para operaciones en el extranjero (fuente: Dossier UsedBy).

Lo que aún no sabemos:

- Los requisitos de datos de entrenamiento específicos que los militares están exigiendo para su versión personalizada (missing_info).

- La respuesta oficial o acciones legales inmediatas que tomará el Department of War tras las últimas declaraciones (missing_info).

- La fecha exacta en la que se ejecutaría la intervención mediante la DPA (missing_info).

La opinión de Diego

Seguid usando Claude 4.5 Opus en producción, pero tened un plan de contingencia de 24 horas para migrar a GPT-5 o Gemini 2.5 si la situación escala. Si el gobierno finalmente designa a Anthropic como riesgo de suministro, empresas como DuckDuckGo o Quora tendrán una presión legal insostenible para desconectar sus APIs (Dossier UsedBy). Claude es el modelo más robusto ahora mismo, pero si sus pesos acaban en manos del estado bajo la DPA, la privacidad que compramos dejará de existir por decreto ley.

Código limpio siempre,

Diego.

Diego Navarro - Early Adopter Tech Analyst at UsedBy.ai

Artículos relacionados

CVE-2026-31431 y la propuesta de moratorio de instalación de Xe Iaso

La vulnerabilidad Copy Fail ha invalidado el modelo de confianza en la cadena de suministro de software de Linux en mayo de 2026. Xe Iaso propone un moratorio inmediato en la instalación de cualquier

Cloudflare y la reestructuración por eficiencia en agentes de IA

Cloudflare ha ejecutado un pivot hacia un modelo operativo "agentic AI-first" tras registrar un aumento del 600% en la eficiencia de sus agentes internos. La compañía busca automatizar la gestión de s

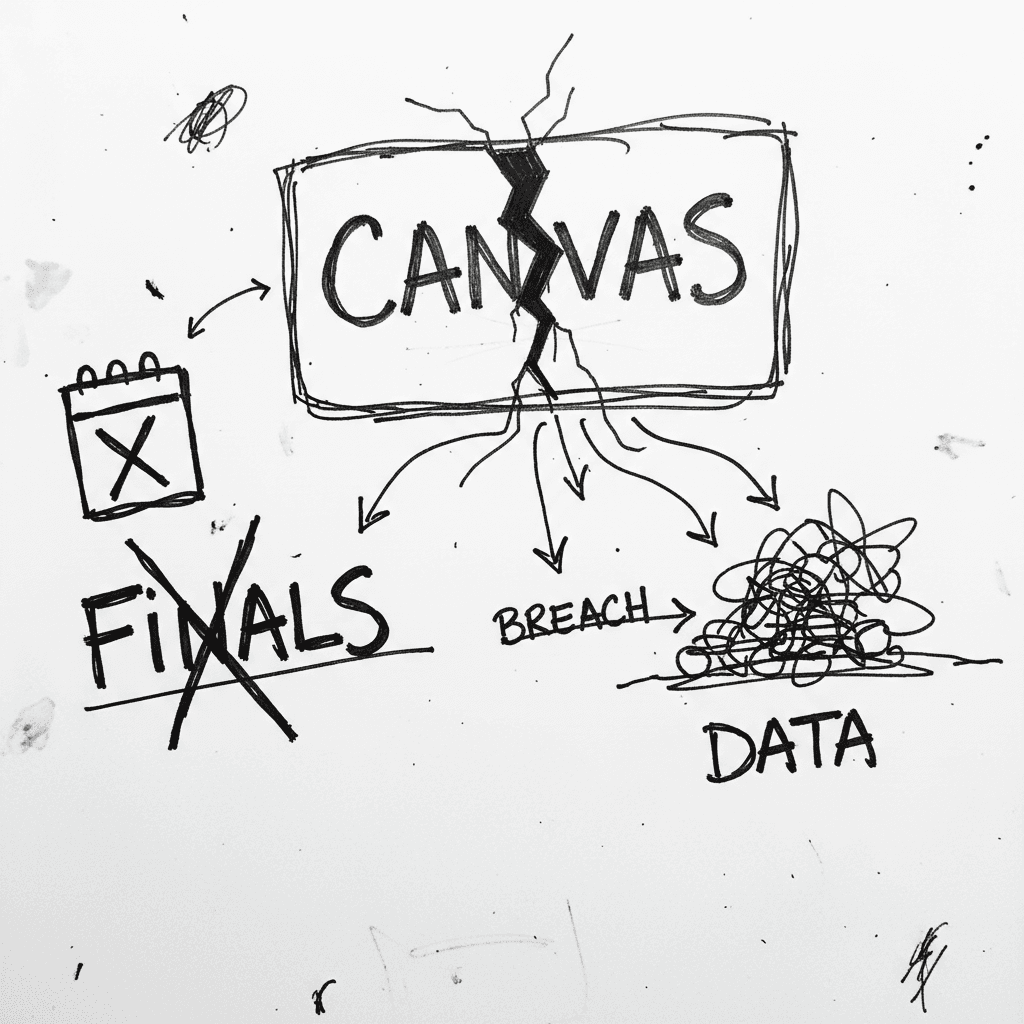

Canvas sufre brecha masiva de 3.65 TB y caída global de servicios

Canvas es el sistema de gestión de aprendizaje (LMS) de Instructure que centraliza la educación de 30 millones de usuarios bajo un modelo SaaS multi-tenant. En Hacker News, el debate se centra en la f

Mantente al día con las tendencias de adopción de IA

Recibe nuestros últimos informes y análisis en tu correo. Sin spam, solo datos.