nCPU — En nuestro radar

nCPU — En nuestro radar

Estado: 🟡 En observación

Por qué hablamos de esto: Ha logrado emular DOOM (1993) y bootloaders de sistemas operativos moviendo toda la lógica de ejecución a la GPU (fuente: Ecosistema Startup, March 2026).

Lo que sabemos:

- Implementa un ciclo fetch-decode-execute de ARM64 utilizando exclusivamente tensores de PyTorch y modelos neuronales para las operaciones de la ALU (fuente: GitHub - robertcprice/nCPU).

- La multiplicación es 12 veces más rápida que la suma porque los LUT neuronales eliminan las dependencias de acarreo secuencial; mi profesor de hardware lloraría (fuente: GitHub Benchmarks).

- Utiliza una implementación neuronal del algoritmo Kogge-Stone para alcanzar una precisión del 100% en operaciones aritméticas (fuente: GitHub Performance Report).

- El rendimiento actual es de apenas ~5,000 IPS, millones de veces más lento que cualquier chip comercial de 2026 (fuente: GitHub README).

- Presenta un alto consumo de VRAM al mantener el estado completo del CPU y la memoria como tensores (fuente: Ecosistema Startup).

Las zonas grises:

- No existen casos de uso documentados en entornos de producción ni adopción por parte de la industria (Dossier UsedBy).

- Faltan comparativas de rendimiento frente a la ejecución de código en LLM modernos o entornos JIT estándar (Dossier UsedBy).

Este artículo se actualizará cuando tengamos más datos. Mientras tanto, precaución.

Código limpio siempre,

Ruben.

Diego Navarro - Early Adopter Tech Analyst at UsedBy.ai

Artículos relacionados

CVE-2026-31431 y la propuesta de moratorio de instalación de Xe Iaso

La vulnerabilidad Copy Fail ha invalidado el modelo de confianza en la cadena de suministro de software de Linux en mayo de 2026. Xe Iaso propone un moratorio inmediato en la instalación de cualquier

Cloudflare y la reestructuración por eficiencia en agentes de IA

Cloudflare ha ejecutado un pivot hacia un modelo operativo "agentic AI-first" tras registrar un aumento del 600% en la eficiencia de sus agentes internos. La compañía busca automatizar la gestión de s

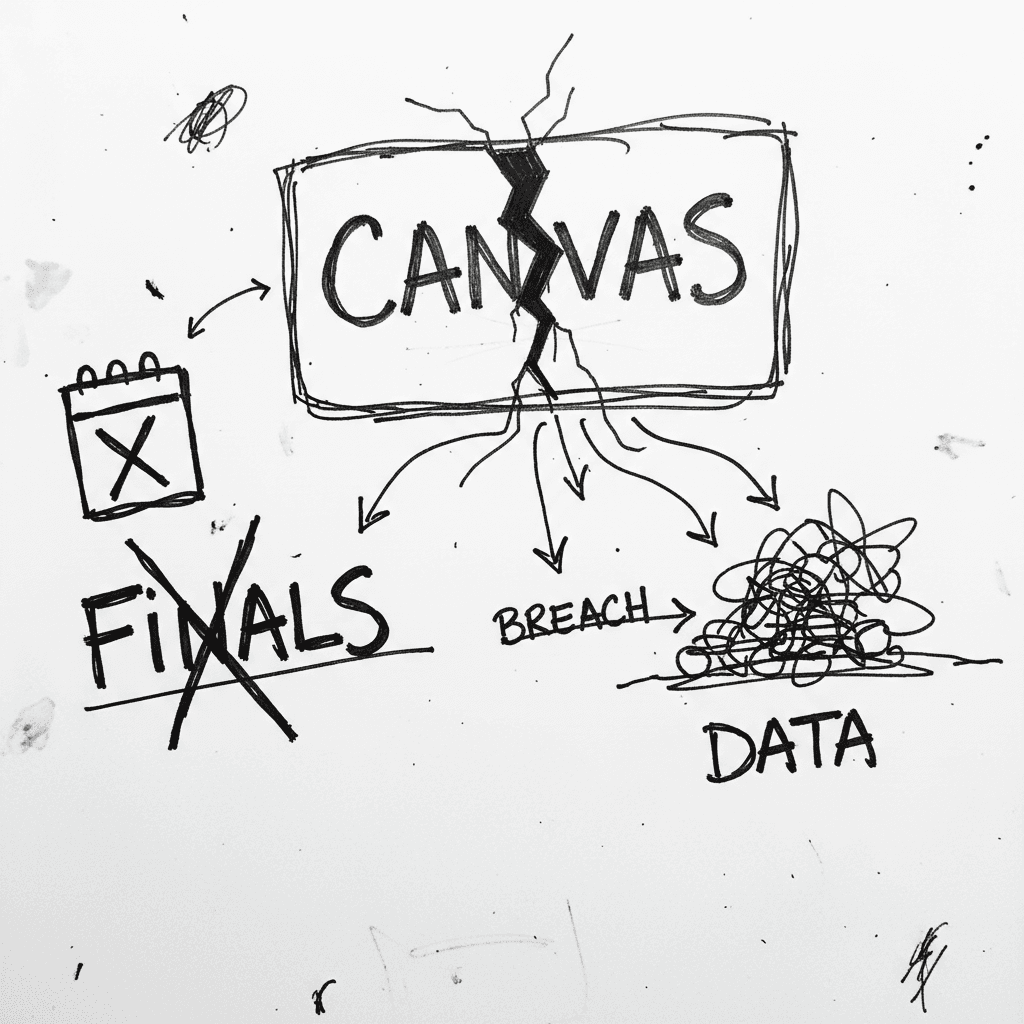

Canvas sufre brecha masiva de 3.65 TB y caída global de servicios

Canvas es el sistema de gestión de aprendizaje (LMS) de Instructure que centraliza la educación de 30 millones de usuarios bajo un modelo SaaS multi-tenant. En Hacker News, el debate se centra en la f

Mantente al día con las tendencias de adopción de IA

Recibe nuestros últimos informes y análisis en tu correo. Sin spam, solo datos.