Gemma 4 : Open-weight, raisonnement natif et instabilité au lancement

Google DeepMind vient de libérer Gemma 4, une famille de quatre modèles allant de 2B à 31B paramètres. Basée sur la technologie Gemini 3, cette itération introduit un mode "native thinking" et bascule

Le Pitch

Google DeepMind vient de libérer Gemma 4, une famille de quatre modèles allant de 2B à 31B paramètres. Basée sur la technologie Gemini 3, cette itération introduit un mode "native thinking" et bascule enfin sous licence Apache 2.0 pour un usage commercial sans entraves.

Sous le capot

L'architecture repose sur les Per-Layer Embeddings (PLE) pour les variantes "Effective" et sur le Mixture-of-Experts (MoE) pour la version 26B-A4B (source: blog.google, April 2026). Le support du context window monte à 256K pour les gros modèles via une attention hybride, mais l'overhead est massif. Comptez environ 40GB de VRAM pour exploiter le KV cache à pleine capacité (source: r/LocalLLM).

Le mode de raisonnement natif utilise des tokens dédiés : <|channel>thought pour la trace de réflexion et <turn|> pour l'EOS (source: latent.space, April 2026). Pour éviter une dégradation immédiate des performances, le réglage des samplers est chirurgical : Temp 1.0, Top_P 0.95 et Top_K 64 (source: HN comment, April 2026).

En pratique, le déploiement local est catastrophique pour une release de cette envergure. Les versions quantisées sur Unsloth et MLX souffrent de "stealthy hallucinations" et de fuites de formatage (source: r/LocalLLaMA). Le modèle 26B-A4B échoue lamentablement sur des conversions de timestamps Unix que Qwen 3.5 gère sans sourciller (source: HN thread).

On ne sait pas encore si les sorties corrompues du modèle 31B sur les backends locaux proviennent d'un bug de l'architecture ou d'un retard de support dans llama.cpp (source: the-decoder.com). L'évaluation complète par l'Artificial Analysis Intelligence Index est toujours en attente, nous privant d'une comparaison normalisée avec GPT-5 ou Claude 4.5 Opus.

L'avis de Ruben

Gemma 4 est un excellent sujet d'étude pour vos side-projects, mais restez loin de la mise en production pour l'instant. Le "native thinking" est prometteur sur le papier, mais si le modèle n'est pas capable de calculer un timestamp correctement malgré sa trace de réflexion, c'est que le fine-tuning de raisonnement manque encore de maturité. Attendez que la communauté stabilise les quants et que Google corrige les boucles infinies de l'inférence locale avant d'y migrer vos pipelines.

Codez propre,

Ruben.

Ruben Isaac - Lead AI Tech Watcher at UsedBy.ai

Articles connexes

Slumber 5.3 : l'alternative TUI en Rust pour le debugging API

Slumber est un client HTTP basé sur le terminal qui privilégie la configuration au clic-bouton. Développé en Rust, il propose une approche "un-enshittified" face à des usines à gaz comme Postman en st

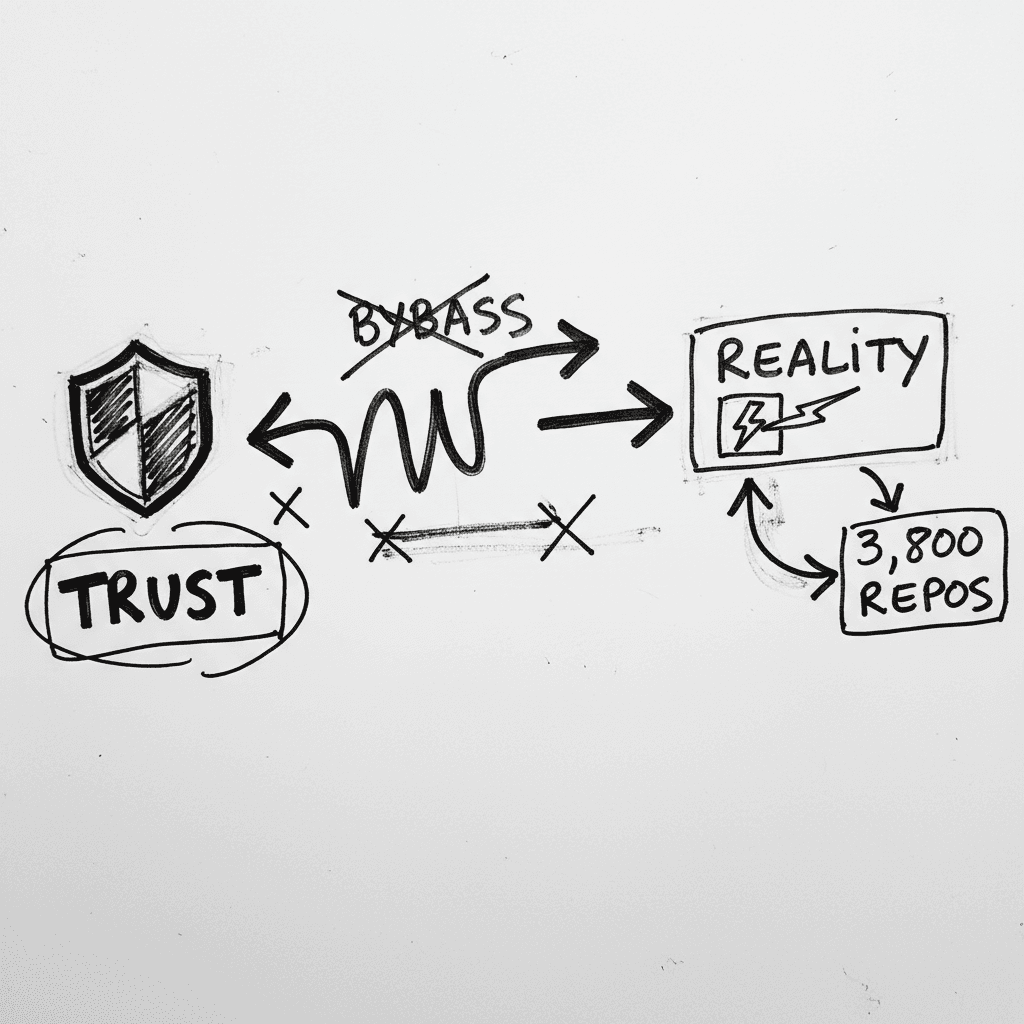

Violation de 3 800 dépôts GitHub via l'extension Nx Console

L'attaque subie par GitHub le 20 mai 2026 marque l'échec critique du modèle de sécurité de VS Code. Une mise à jour empoisonnée de l'extension Nx Console a permis à TeamPCP d'exfiltrer des milliers de

GPT-5 et la conjecture d'Erdős : validation formelle d'une découverte autonome

OpenAI vient de publier une preuve autonome réfutant la conjecture d'Erdős sur les distances unitaires planes, un problème ouvert depuis 80 ans. Contrairement aux hallucinations de recherche documenta

Restez à la pointe des tendances d'adoption de l'IA

Recevez nos derniers rapports et analyses directement dans votre boîte mail. Pas de spam, que des données.