TinyLoRA : 13 paramètres pour débloquer le raisonnement LLM

TinyLoRA est une preuve de concept académique majeure, mais ne l'intégrez pas dans vos pipelines de production. Le score sur GSM8K est devenu une métrique de vanité en 2026, surtout sur des modèles dé

Le Pitch

TinyLoRA permet d'atteindre 91,8 % de précision sur le benchmark GSM8K en n'entraînant que 13 paramètres, soit environ 26 octets (source : arXiv:2602.04118).

Cette approche développée par des chercheurs de FAIR, CMU et Cornell montre qu'il est possible d'activer des capacités logiques avancées sans passer par un fine-tuning massif (source : MarkTechPost).

Le projet s'appuie sur l'idée que le raisonnement est déjà présent dans les poids des modèles pré-entraînés et ne demande qu'un guidage minimal.

Sous le capot

La méthode ne repose pas sur le Supervised Fine-Tuning (SFT) classique, jugé inefficace à cette échelle.

C'est le Reinforcement Learning (RL) qui permet ici d'orienter les capacités de raisonnement dormantes de modèles comme Qwen-2.5 (source : PlainEnglish.io).

Techniquement, TinyLoRA utilise une décomposition SVD avec un rang r=2 figé, projetant un vecteur entraînable à travers un tenseur aléatoire fixe (source : NeuroTechnus).

Cette réduction extrême de la dimensionnalité rend l'optimisation particulièrement instable.

L'entraînement à r=1 ou 2 crée un paysage de perte abrupt qui nécessite des hyperparamètres de RL très spécifiques pour ne pas diverger (source : NeuroTechnus).

Sur des benchmarks plus complexes comme AIME ou MATH500, la limite des 13 paramètres est d'ailleurs atteinte et il faut monter à 196 paramètres pour maintenir la cohérence (source : Dossier UsedBy).

Le risque de contamination des données reste l'angle mort principal de cette étude.

Les modèles de la famille Qwen ont été massivement exposés au GSM8K durant leur phase de pré-entraînement, ce qui pourrait masquer une simple mémorisation plutôt qu'un réel raisonnement (source : HN/arXiv:2404.12138).

De plus, le calcul initial de la SVD tronquée sur des LLM de grande taille impose un coût de compute non négligeable avant même le début de l'entraînement (source : HN).

Certaines zones d'ombre persistent sur la viabilité à long terme de ces micro-mises à jour.

Le code source de l'implémentation spécifique n'est pas encore public, limitant les tests de reproductibilité par la communauté (source : HuggingFace).

On ignore également si ces modifications ultra-ciblées provoquent un oubli catastrophique sur les tâches de langage naturel non mathématiques (source : Dossier UsedBy).

L'avis de Ruben

TinyLoRA est une preuve de concept académique majeure, mais ne l'intégrez pas dans vos pipelines de production. Le score sur GSM8K est devenu une métrique de vanité en 2026, surtout sur des modèles déjà saturés par ce dataset. C'est un excellent outil pour vos side-projects de recherche en efficacité d'inférence, mais pour du concret, un Claude 4.5 Opus ou un GPT-5 natif restera plus fiable que ces 13 paramètres qui risquent de s'effondrer dès que vous sortez de la logique de manuel scolaire.

Codez propre,

Ruben.

Ruben Isaac - Lead AI Tech Watcher at UsedBy.ai

Articles connexes

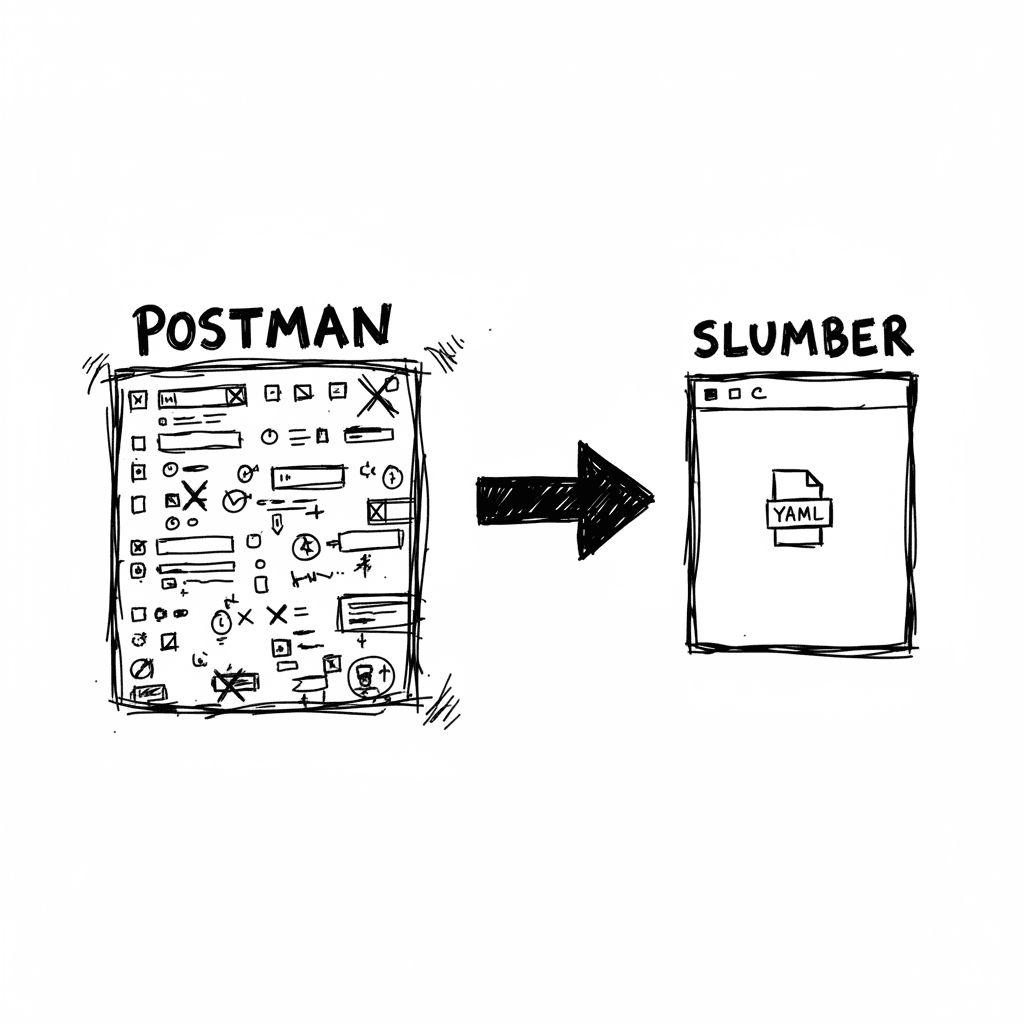

Slumber 5.3 : l'alternative TUI en Rust pour le debugging API

Slumber est un client HTTP basé sur le terminal qui privilégie la configuration au clic-bouton. Développé en Rust, il propose une approche "un-enshittified" face à des usines à gaz comme Postman en st

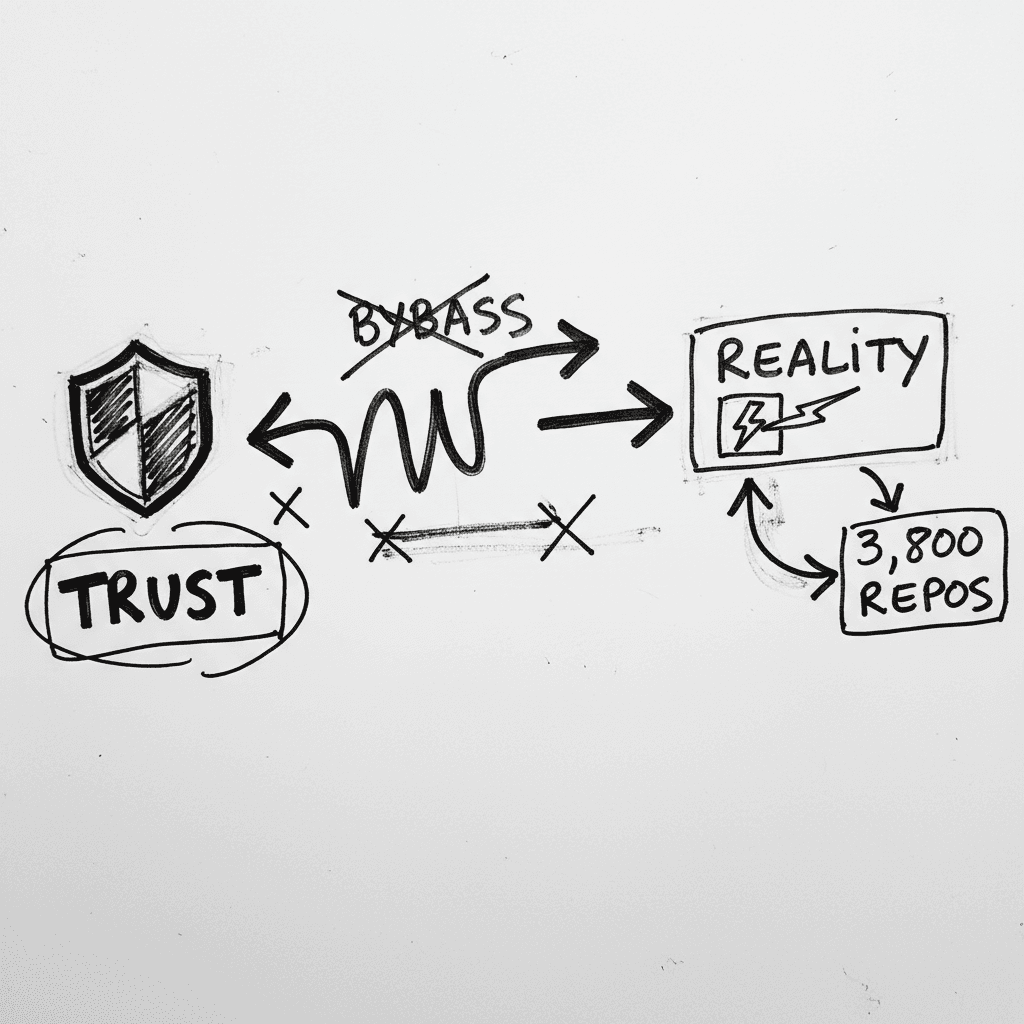

Violation de 3 800 dépôts GitHub via l'extension Nx Console

L'attaque subie par GitHub le 20 mai 2026 marque l'échec critique du modèle de sécurité de VS Code. Une mise à jour empoisonnée de l'extension Nx Console a permis à TeamPCP d'exfiltrer des milliers de

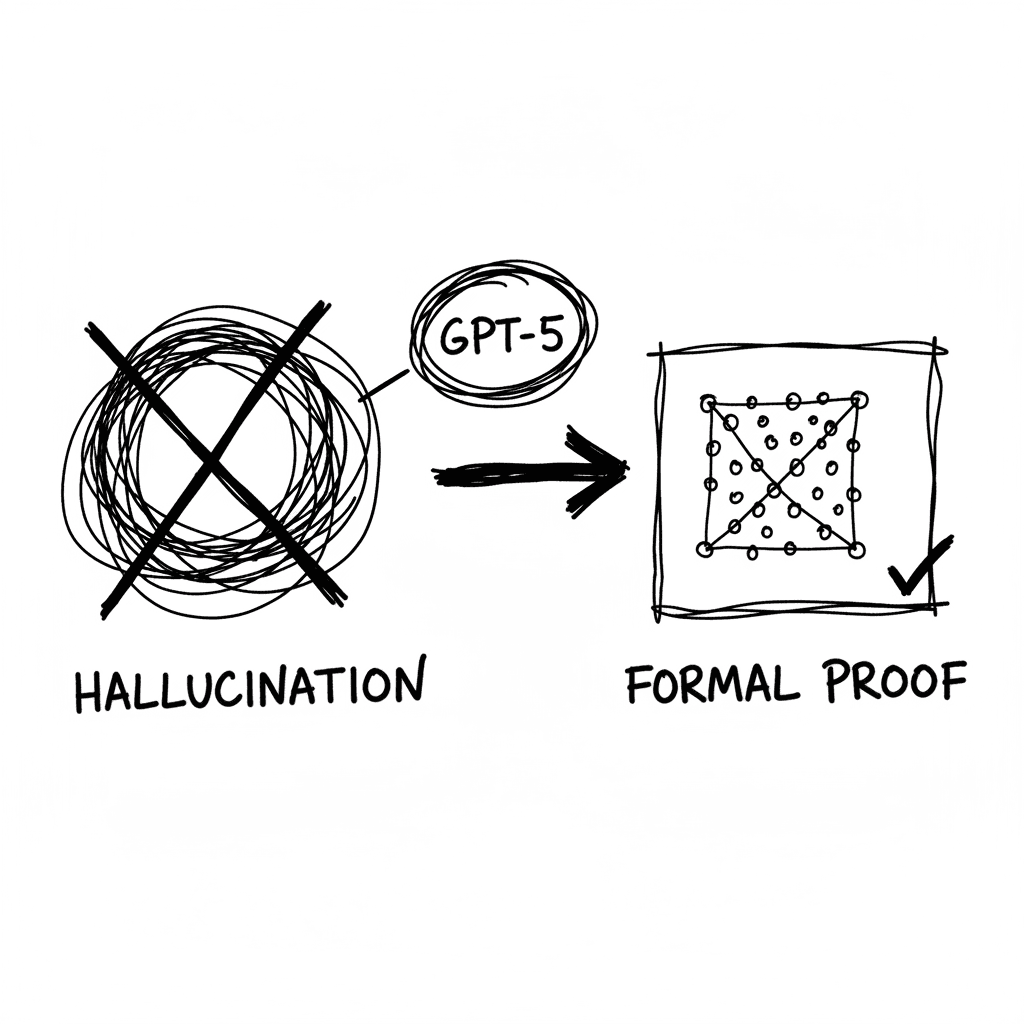

GPT-5 et la conjecture d'Erdős : validation formelle d'une découverte autonome

OpenAI vient de publier une preuve autonome réfutant la conjecture d'Erdős sur les distances unitaires planes, un problème ouvert depuis 80 ans. Contrairement aux hallucinations de recherche documenta

Restez à la pointe des tendances d'adoption de l'IA

Recevez nos derniers rapports et analyses directement dans votre boîte mail. Pas de spam, que des données.