TurboQuant : Compression 3-bit du KV Cache par Google Research

Google Research vient de publier TurboQuant, une méthode de compression du KV cache visant une réduction de mémoire par 6 sans perte de précision apparente. En atteignant une quantification à 3 bits p

Le Pitch

Google Research vient de publier TurboQuant, une méthode de compression du KV cache visant une réduction de mémoire par 6 sans perte de précision apparente. En atteignant une quantification à 3 bits par valeur, cet algorithme promet des gains de vitesse jusqu'à 8x sur les architectures H100 (research.google). Hacker News s'agite surtout autour de sa capacité à fonctionner en "data-oblivious", sans nécessiter de fine-tuning ou de réentraînement (arXiv:2504.19874).

Sous le capot

Le framework repose sur deux piliers algorithmiques : PolarQuant (issu de AISTATS 2026) et le Quantized Johnson-Lindenstrauss (QJL). Cette approche permet de compresser les clés et les valeurs à 3 bits tout en maintenant des scores quasi parfaits sur les benchmarks LongBench et Needle-In-A-Haystack, notamment pour Gemma et Mistral (Help Net Security). Contrairement aux méthodes habituelles, TurboQuant exploite le lemme de Johnson-Lindenstrauss pour projeter les données dans des espaces de moindre dimension sans sacrifier la structure des informations.

Cependant, l'implémentation actuelle soulève des doutes techniques sérieux au sein de la communauté. Plusieurs ingénieurs sur Hacker News signalent une absence de citation concernant l'article "DRIVE" de NeurIPS 2021, dont la méthode de rotation géométrique semble pourtant constituer le socle mathématique de TurboQuant (HN Comment). De plus, si les performances sur H100 et B200 sont documentées, les gains sur le hardware grand public restent à prouver (research.google).

On regrettera également la qualité médiocre du billet de blog officiel de Google, jugé trop simpliste et potentiellement généré par IA, ce qui masque la complexité réelle de l'algorithme (HN Comment). Actuellement, aucun dépôt GitHub de production n'a été publié, limitant les tests à quelques snippets de recherche. Un portage communautaire pour Apple Silicon (MLX) est toutefois en cours de discussion sur r/LocalLLaMA (Reddit).

Il manque enfin des données critiques sur le comportement de TurboQuant face aux modèles SOTA de 2026. Si les tests sur Gemma sont concluants, nous n'avons aucun benchmark public sur les architectures plus massives comme GPT-5 ou Claude 4.5 Opus. L'info n'est pas publique et Google semble se concentrer sur ses modèles internes pour le moment.

L'avis de Ruben

TurboQuant est une prouesse académique, mais pas encore un outil de production. L'absence de code source prêt pour le déploiement et la controverse sur les citations rappellent que Google Research communique souvent plus vite que ses ingénieurs ne livrent. On ne sait pas encore si la compression à 3 bits tiendra ses promesses sur des LLM de plus de 2 trillions de paramètres. Pour l'instant, c'est un projet à surveiller pour vos side-projects en local via MLX, mais ne touchez pas à votre infrastructure d'inférence en prod avant une release officielle sur GitHub.

Codez propre,

Ruben.

Ruben Isaac - Lead AI Tech Watcher at UsedBy.ai

Articles connexes

Slumber 5.3 : l'alternative TUI en Rust pour le debugging API

Slumber est un client HTTP basé sur le terminal qui privilégie la configuration au clic-bouton. Développé en Rust, il propose une approche "un-enshittified" face à des usines à gaz comme Postman en st

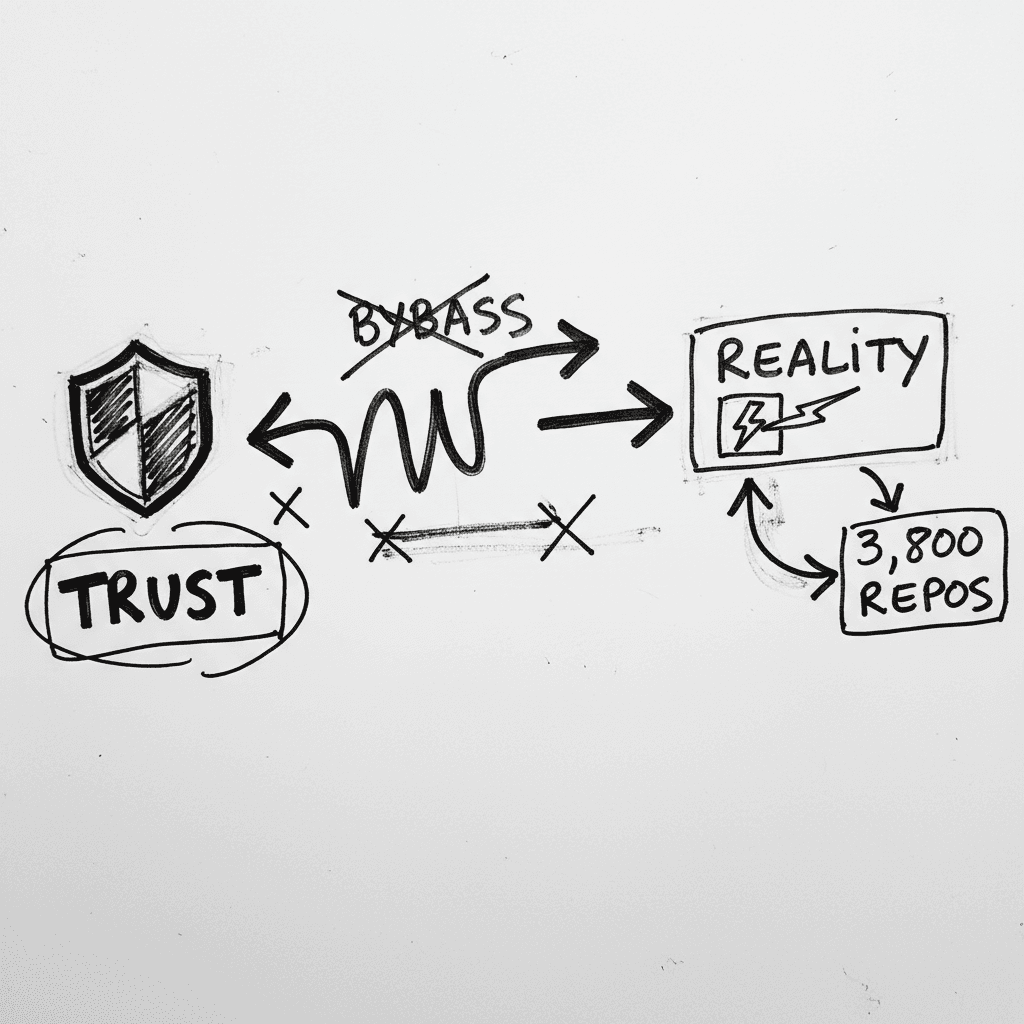

Violation de 3 800 dépôts GitHub via l'extension Nx Console

L'attaque subie par GitHub le 20 mai 2026 marque l'échec critique du modèle de sécurité de VS Code. Une mise à jour empoisonnée de l'extension Nx Console a permis à TeamPCP d'exfiltrer des milliers de

GPT-5 et la conjecture d'Erdős : validation formelle d'une découverte autonome

OpenAI vient de publier une preuve autonome réfutant la conjecture d'Erdős sur les distances unitaires planes, un problème ouvert depuis 80 ans. Contrairement aux hallucinations de recherche documenta

Restez à la pointe des tendances d'adoption de l'IA

Recevez nos derniers rapports et analyses directement dans votre boîte mail. Pas de spam, que des données.