ARC-AGI-3 : L’échec systémique de GPT-5 et Claude 4.5 Opus face au benchmark de Chollet

Lancé le 25 mars 2026 par François Chollet et Mike Knoop, l’ARC-AGI-3 se présente comme la nouvelle boussole de l'AGI (ARC Prize Foundation). Ce benchmark interactif de 1 000 niveaux force les agents

Le Pitch

Lancé le 25 mars 2026 par François Chollet et Mike Knoop, l’ARC-AGI-3 se présente comme la nouvelle boussole de l'AGI (ARC Prize Foundation). Ce benchmark interactif de 1 000 niveaux force les agents à découvrir des règles logiques dans des environnements inconnus sans aucune instruction préalable (Fast Company).

Sous le capot

La réalité technique est brutale : les modèles de pointe, incluant GPT-5 et Claude 4.5 Opus, échouent actuellement à dépasser la barre des 1 % d’efficience (The Neuron Daily). Cet échec massif s'explique par la métrique RHAE (Relative Human Action Efficiency), qui compare le nombre d'actions de l'IA à une baseline humaine (Official Docs).

Le système de notation intègre une "squared efficiency penalty" (Twitter @scaling01). Cette pondération mathématique massacre le score des modèles qui utilisent le trial-and-error ou l'inférence itérative pour résoudre un problème. En clair, le benchmark favorise l'instinct et l'exploration directe, là où les LLM actuels consomment des tokens pour "tâtonner" leur environnement.

Le design des tâches introduit également un "gamer bias" important. Les environnements sont visuellement et mécaniquement proches de jeux vidéo 2D, ce qui donne un avantage statistique aux humains familiers des mécaniques de gameplay (HN Comment). Par ailleurs, la crainte de la data contamination persiste : certains laboratoires pourraient être tentés d'optimiser leurs modèles sur les patterns publics des versions précédentes pour gonfler artificiellement leurs résultats (LessWrong).

On ne sait pas encore quelles seront les limites de compute imposées pour la compétition Kaggle 2026 (arcprize.org). De même, les données démographiques précises concernant le panel humain ayant servi à établir le "second-best first-run" restent confidentielles, ce qui limite l'analyse de la pertinence de la baseline.

L'avis de Ruben

L’ARC-AGI-3 est un crash test pour architectures de recherche, pas un indicateur de valeur métier. Chollet a conçu un système de notation volontairement punitif pour démontrer les limites du paradigme actuel des transformers. C’est un excellent outil pour le fine-tuning académique, mais c’est totalement inutile pour évaluer la capacité d'un agent à gérer vos pipelines de production. Le score est tellement bas qu'on dirait un senior dev tentant de débugger du COBOL sans documentation : la persistance ne suffit pas quand la métrique est truquée contre vous.

Codez propre,

Ruben.

Ruben Isaac - Lead AI Tech Watcher at UsedBy.ai

Articles connexes

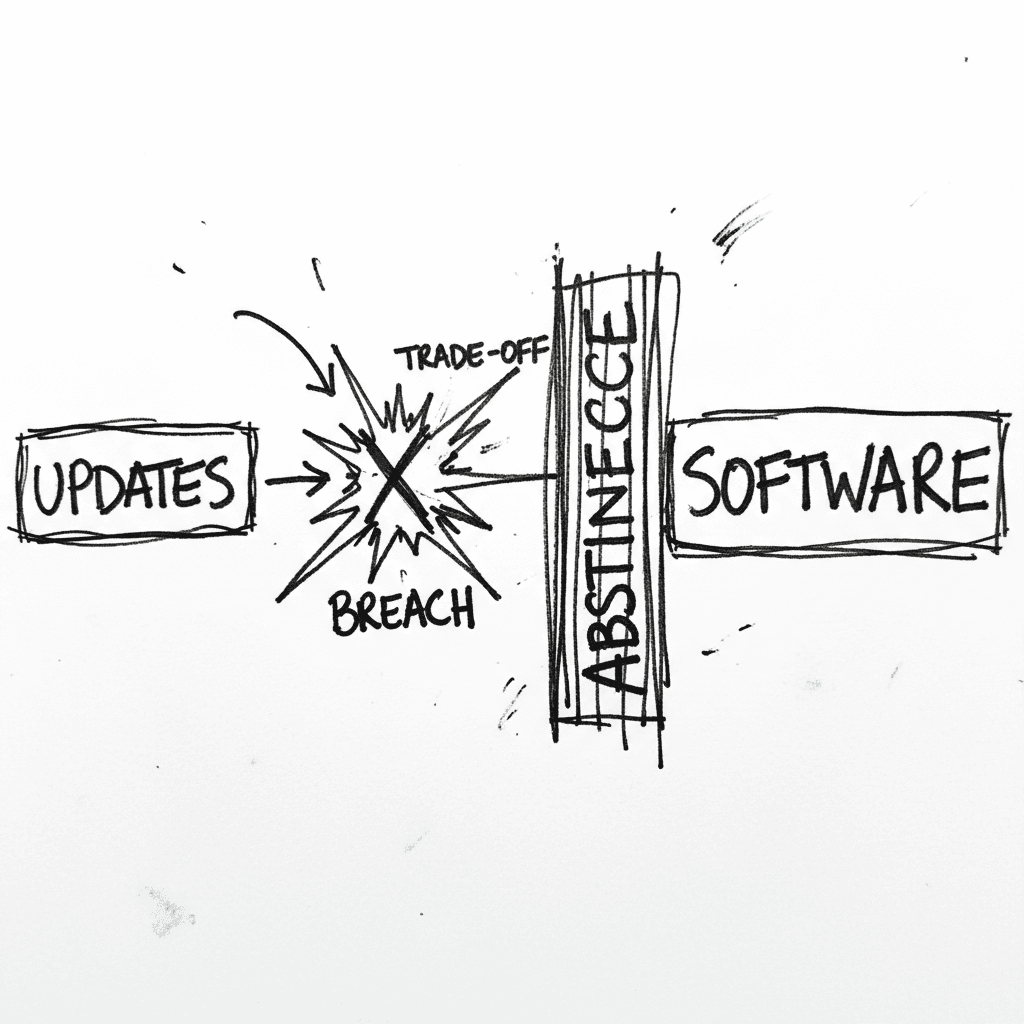

Software Abstinence : le moratoire de Xe Iaso face à l'exploit Copy Fail

Xe Iaso propose un arrêt total des installations de nouveaux logiciels et des mises à jour non critiques pendant une semaine. Ce moratoire technique vise à contrer l'exploitation massive de la vulnéra

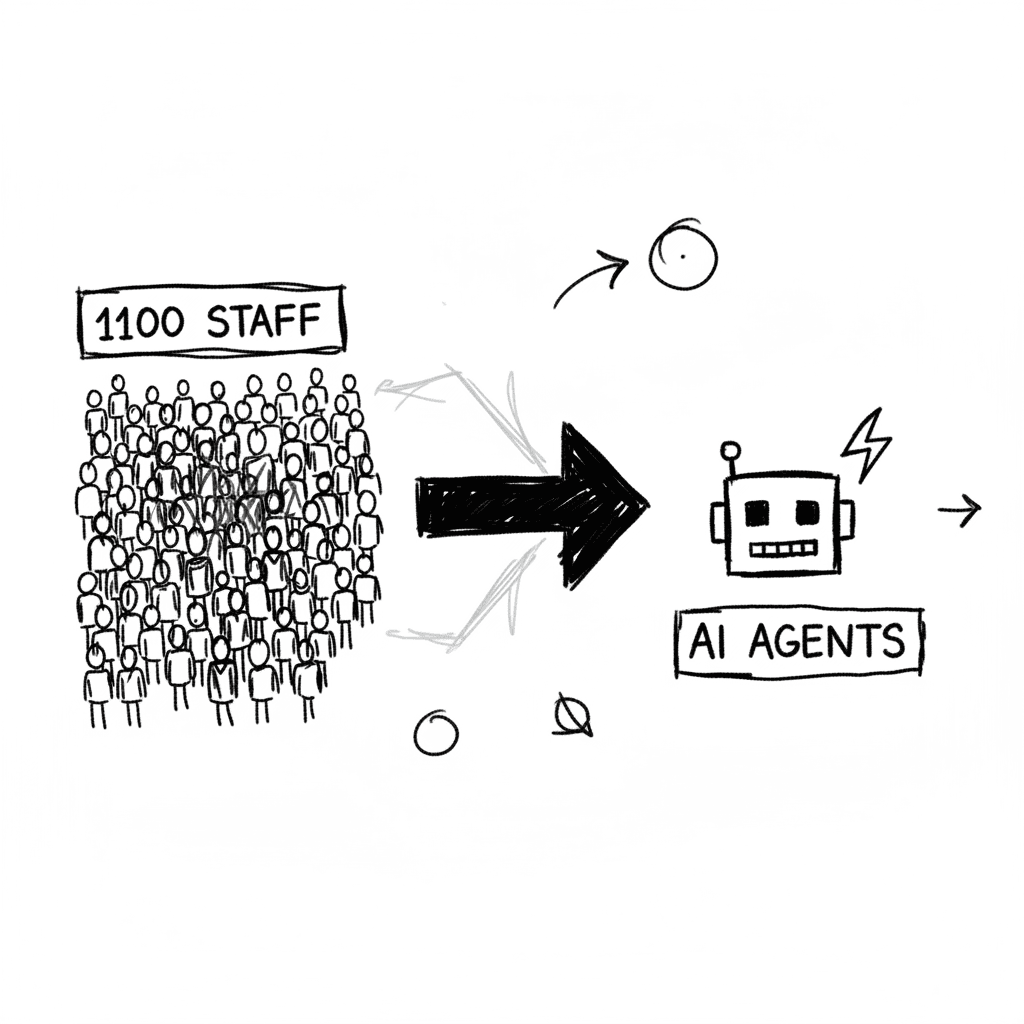

Cloudflare : restructuration massive au profit d'une architecture agentique interne

Cloudflare licencie 1 100 employés, soit 20 % de ses effectifs, pour automatiser ses processus via des agents IA. L'entreprise profite d'une croissance de 34 % en glissement annuel pour forcer une tra

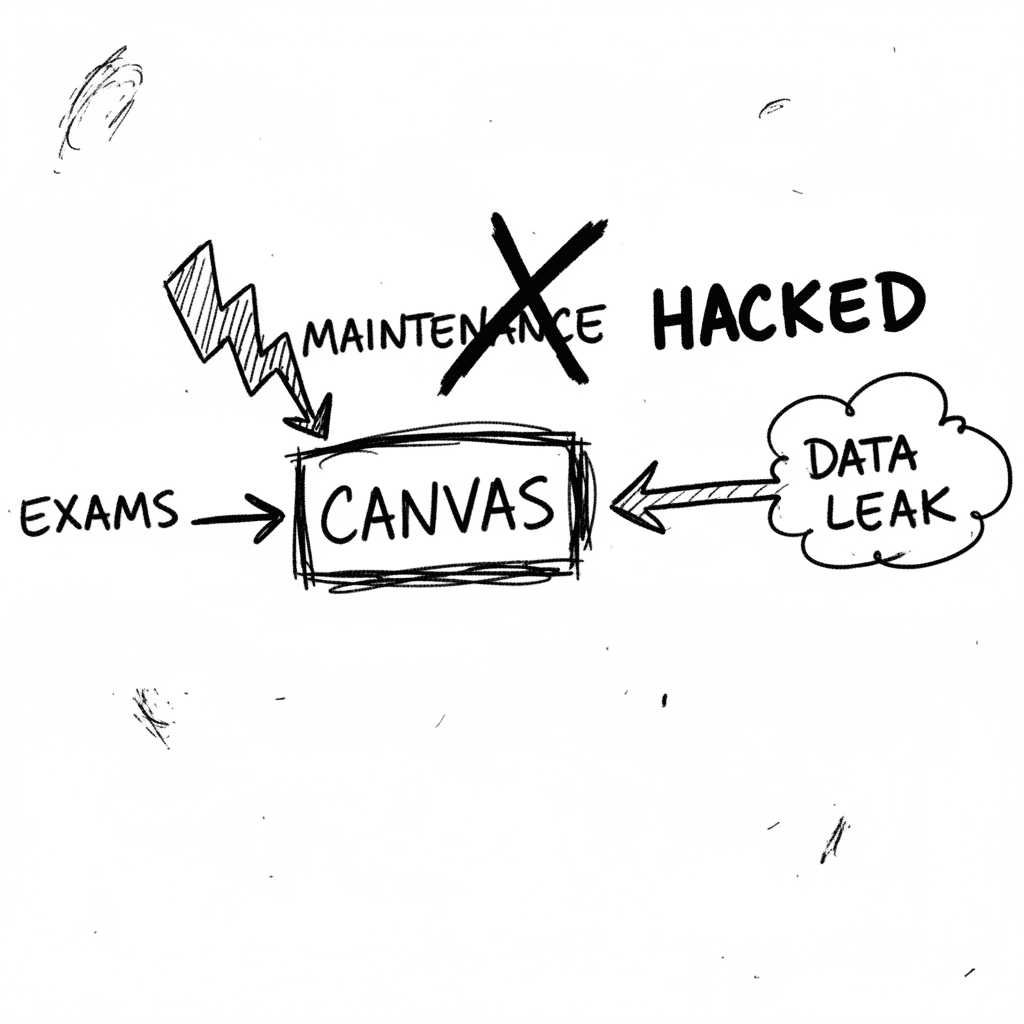

Instructure Canvas : échec critique de la sécurité en pleine période d'examens

Instructure Canvas, le LMS utilisé par plus de 30 millions d'étudiants, subit actuellement une compromission totale de son infrastructure par le groupe ShinyHunters. Alors que les universités entament

Restez à la pointe des tendances d'adoption de l'IA

Recevez nos derniers rapports et analyses directement dans votre boîte mail. Pas de spam, que des données.