NVIDIA Blackwell Ultra B300 : L'abandon du FP64 natif pour l'inférence massive

NVIDIA change radicalement de stratégie avec l'architecture Blackwell Ultra (B300) en sacrifiant le calcul haute précision au profit de l'inférence pour les modèles de l'ère du raisonnement. Pour la p

Le Pitch

NVIDIA change radicalement de stratégie avec l'architecture Blackwell Ultra (B300) en sacrifiant le calcul haute précision au profit de l'inférence pour les modèles de l'ère du raisonnement. Pour la première fois depuis 2010, une carte grand public comme la RTX 5090 surpasse le flagship enterprise en calcul double précision (FP64). Ce pivot technique vise explicitement le déploiement à l'échelle de modèles à mille milliards de paramètres.

Sous le capot

Le fait technique est brutal : le Blackwell Ultra B300 ne délivre que 1,39 TFLOPS en FP64 (source: Tom's Hardware, Aug 2025), contre 1,64 TFLOPS pour une RTX 5090 (source: nicolasdickenmann.com, Feb 2026). NVIDIA a physiquement réduit les unités de calcul 64 bits pour libérer de l'espace silicium pour les cœurs basse précision (FP4/FP8). C'est une rupture historique avec les générations H100/B200 qui affichaient entre 37 et 40 TFLOPS sur ce segment (source: Tom's Hardware, Aug 2025).

Le B300 embarque 288 Go de mémoire HBM3e et devient le premier GPU à supporter officiellement le PCIe 6.0 (Hot Chips 2025 proceedings). Pour compenser l'absence de hardware dédié, le FP64 est désormais émulé via des wrappers logiciels utilisant les Tensor Cores. Cette approche pose des risques réels de dégradation de précision (overflow/underflow) par rapport au standard IEEE-754 (source: HN Comment 2).

La consommation électrique atteint des sommets avec un TDP de 1 400W par unité. Ce chiffre impose une infrastructure de refroidissement liquide type GB300 NVL72, rendant l'intégration en air-cooling impossible. Les charges de travail scientifiques (HPC) commencent déjà à migrer vers les solutions AMD MI300/MI350 qui conservent un support FP64 natif supérieur (source: Reddit r/CUDA).

On ne dispose toujours pas de vérification indépendante concernant le gain d'efficacité de 50x en inférence promis par le marketing. Les tarifs exacts du B300 restent également flous, NVIDIA privilégiant la vente de racks complets plutôt que de cartes à l'unité (Dossier UsedBy).

L'avis de Ruben

Le B300 n'est plus un GPU généraliste, c'est un ASIC d'inférence déguisé. Si votre stack tourne sur des modèles à mille milliards de paramètres, la densité de calcul NVFP4 est un argument de poids pour réduire la latency. Mais pour tout ce qui touche à la simulation physique ou au calcul scientifique rigoureux, NVIDIA vient de vous fermer la porte. À 1 400W par carte, espérons que votre datacenter est situé à côté d'un réacteur nucléaire ou d'une station de ski à chauffer. Pour la prod IA, on fonce ; pour le HPC, on part chez AMD.

Codez propre,

Ruben.

Ruben Isaac - Lead AI Tech Watcher at UsedBy.ai

Articles connexes

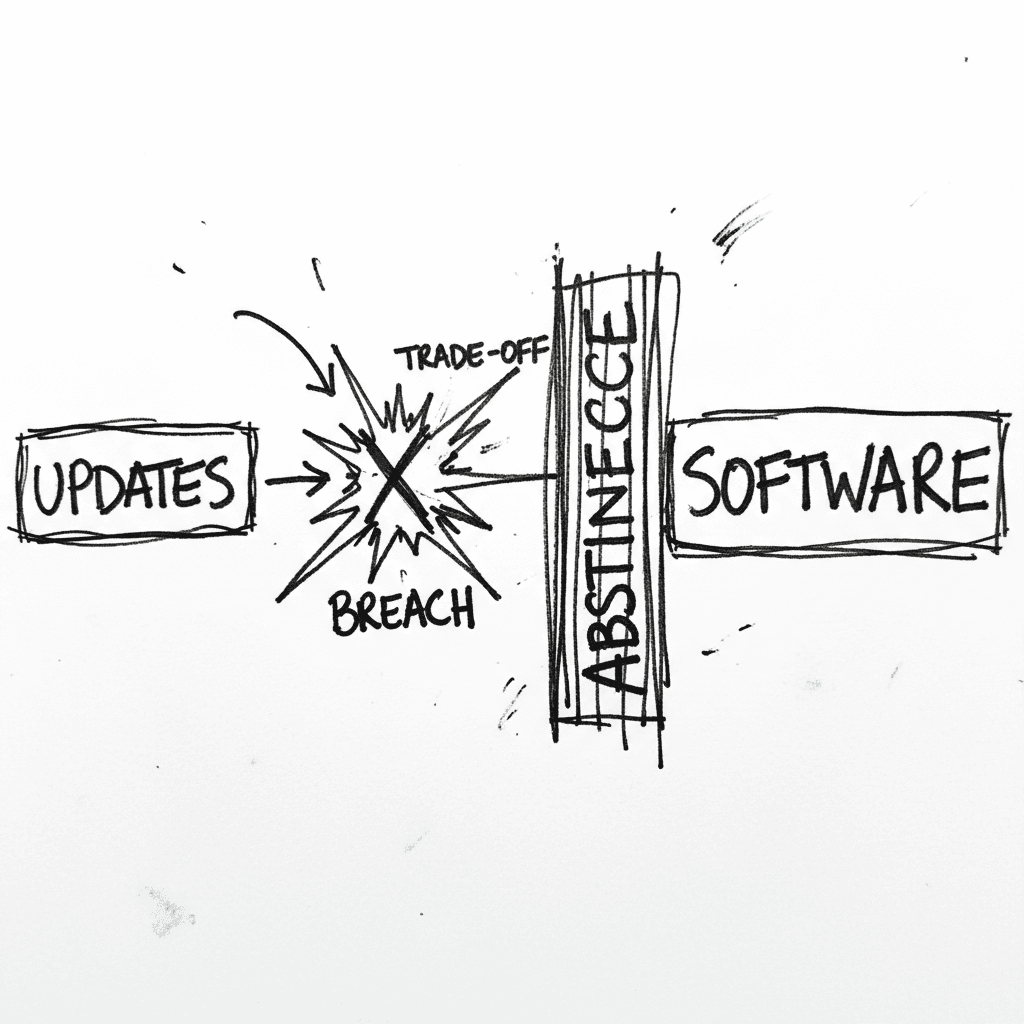

Software Abstinence : le moratoire de Xe Iaso face à l'exploit Copy Fail

Xe Iaso propose un arrêt total des installations de nouveaux logiciels et des mises à jour non critiques pendant une semaine. Ce moratoire technique vise à contrer l'exploitation massive de la vulnéra

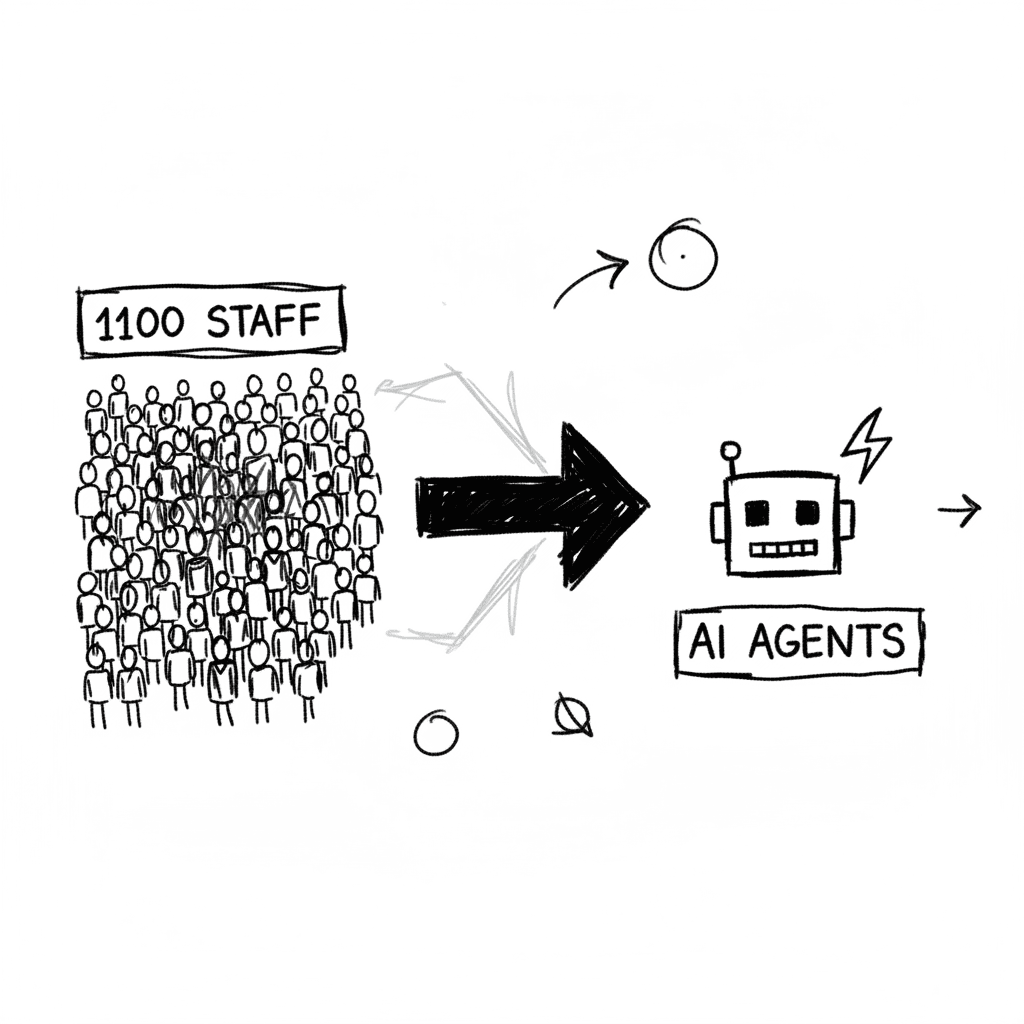

Cloudflare : restructuration massive au profit d'une architecture agentique interne

Cloudflare licencie 1 100 employés, soit 20 % de ses effectifs, pour automatiser ses processus via des agents IA. L'entreprise profite d'une croissance de 34 % en glissement annuel pour forcer une tra

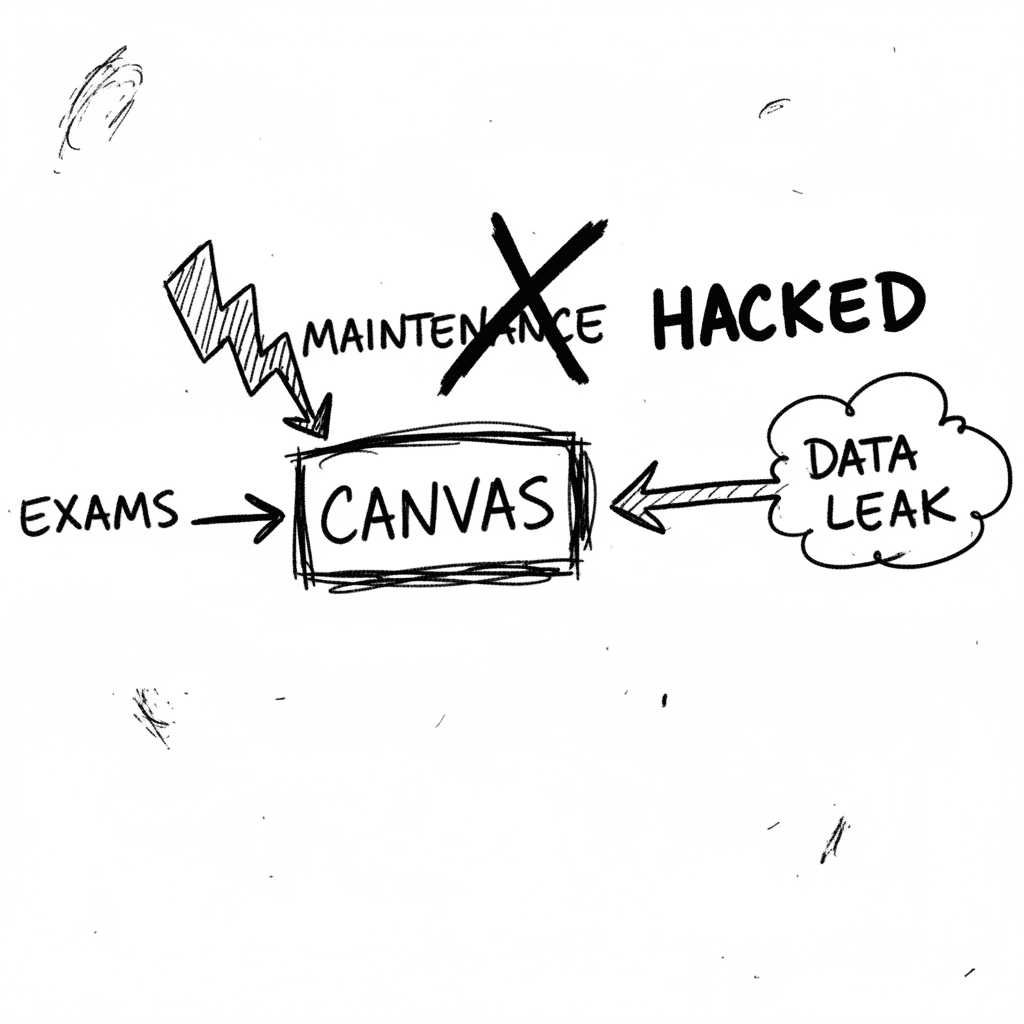

Instructure Canvas : échec critique de la sécurité en pleine période d'examens

Instructure Canvas, le LMS utilisé par plus de 30 millions d'étudiants, subit actuellement une compromission totale de son infrastructure par le groupe ShinyHunters. Alors que les universités entament

Restez à la pointe des tendances d'adoption de l'IA

Recevez nos derniers rapports et analyses directement dans votre boîte mail. Pas de spam, que des données.