Data centers orbitaux : la réalité thermodynamique derrière le marketing du refroidissement spatial

Starcloud et Lonestar déportent le compute en orbite basse et cis-lunaire pour contourner les limites de consommation d'eau et d'énergie des réseaux terrestres. L'idée est d'utiliser l'énergie solaire

Le Pitch

Starcloud et Lonestar déportent le compute en orbite basse et cis-lunaire pour contourner les limites de consommation d'eau et d'énergie des réseaux terrestres. L'idée est d'utiliser l'énergie solaire illimitée et le vide spatial pour l'entraînement de modèles lourds (source: Lumen Orbit).

Sous le capot

L'entraînement de modèles d'IA en orbite est techniquement validé. Starcloud, soutenu par Nvidia, a finalisé l'entraînement d'un modèle sur des GPU commerciaux en décembre 2025 (source: EnkiAI). Google suit avec le projet Suncatcher, testant des TPU satellites et des liaisons optiques inter-satellites depuis novembre 2025 (source: EnkiAI).

Le concept de "free cooling" mis en avant par le marketing est une aberration physique. L'espace est un vide thermique : sans conduction ni convection, la chaleur ne s'évacue que par radiation. Pour une installation de 1 MW, il faut environ 1 200 m² de radiateurs, soit une structure de 35x35 mètres (source: EE Times).

Si les boucles de refroidissement liquide actif ou le déploiement des radiateurs échouent, le hardware subit un "slow-cooking" immédiat par sa propre chaleur résiduelle. La maintenance reste le point noir, car les défaillances physiques des SSD ou des roulements nécessitent une mise au rebut totale du module (source: Dossier UsedBy).

La latence sol-orbite oscille entre 20 et 50 ms, ce qui disqualifie ces infrastructures pour l'inference en temps réel face aux edge nodes terrestres. L'assemblage robotisé via la mission EROSS prévu pour 2026 est la condition sine qua non pour passer à l'échelle industrielle (source: Thales Group).

On ne sait pas encore quel sera le coût réel par inference comparé aux instances AWS ou GCP actuelles. De même, le taux de défaillance des GPU COTS (commercial-off-the-shelf) soumis aux radiations ionisantes sur une période supérieure à 12 mois reste une inconnue majeure.

L'avis de Ruben

C'est un projet de R&D coûteux qui ne concerne que les acteurs ayant des besoins de souveraineté extrême ou des budgets d'entraînement colossaux. Tant que le coût de lancement ne descend pas sous les 300 $/kg, le cloud orbital reste une curiosité d'ingénieur. Ne migrez rien, l'inertie thermique de l'espace est votre pire ennemie en 2026.

Codez propre,

Ruben.

Ruben Isaac - Lead AI Tech Watcher at UsedBy.ai

Articles connexes

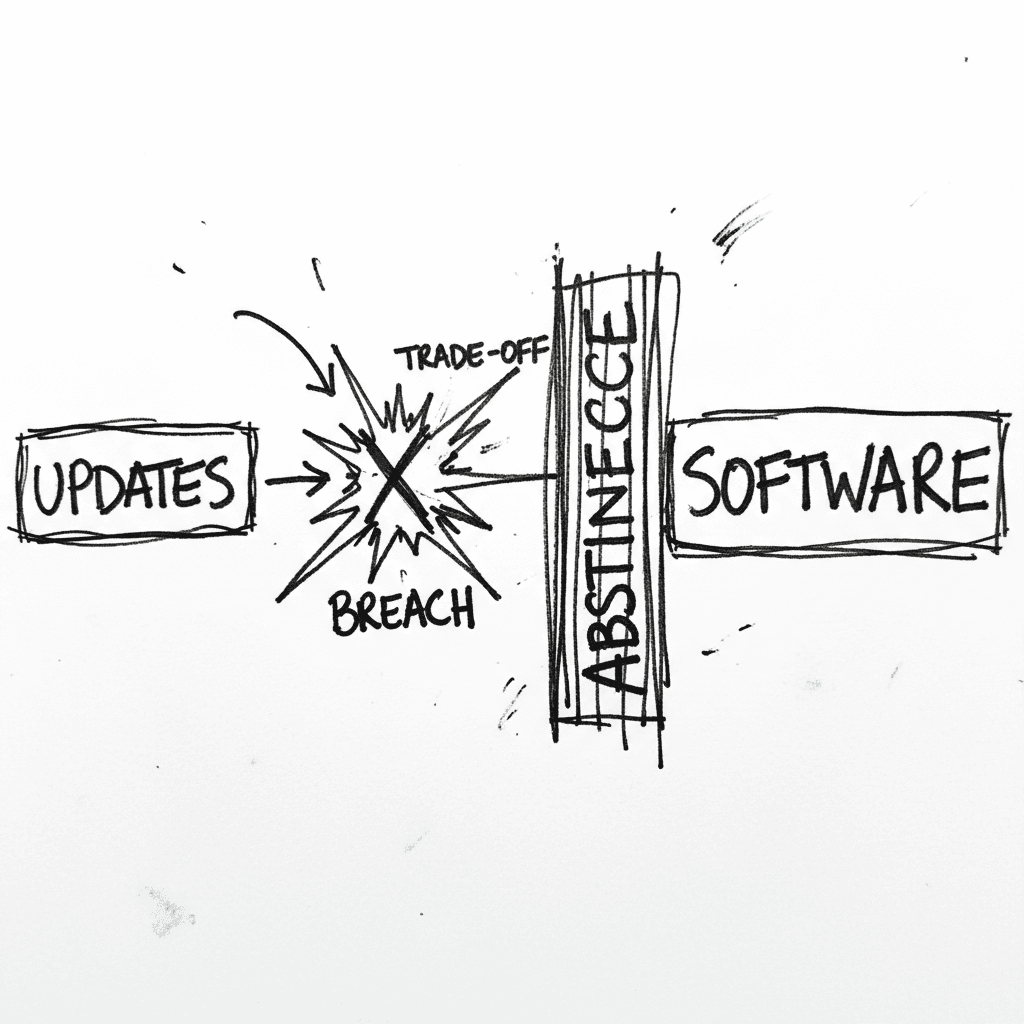

Software Abstinence : le moratoire de Xe Iaso face à l'exploit Copy Fail

Xe Iaso propose un arrêt total des installations de nouveaux logiciels et des mises à jour non critiques pendant une semaine. Ce moratoire technique vise à contrer l'exploitation massive de la vulnéra

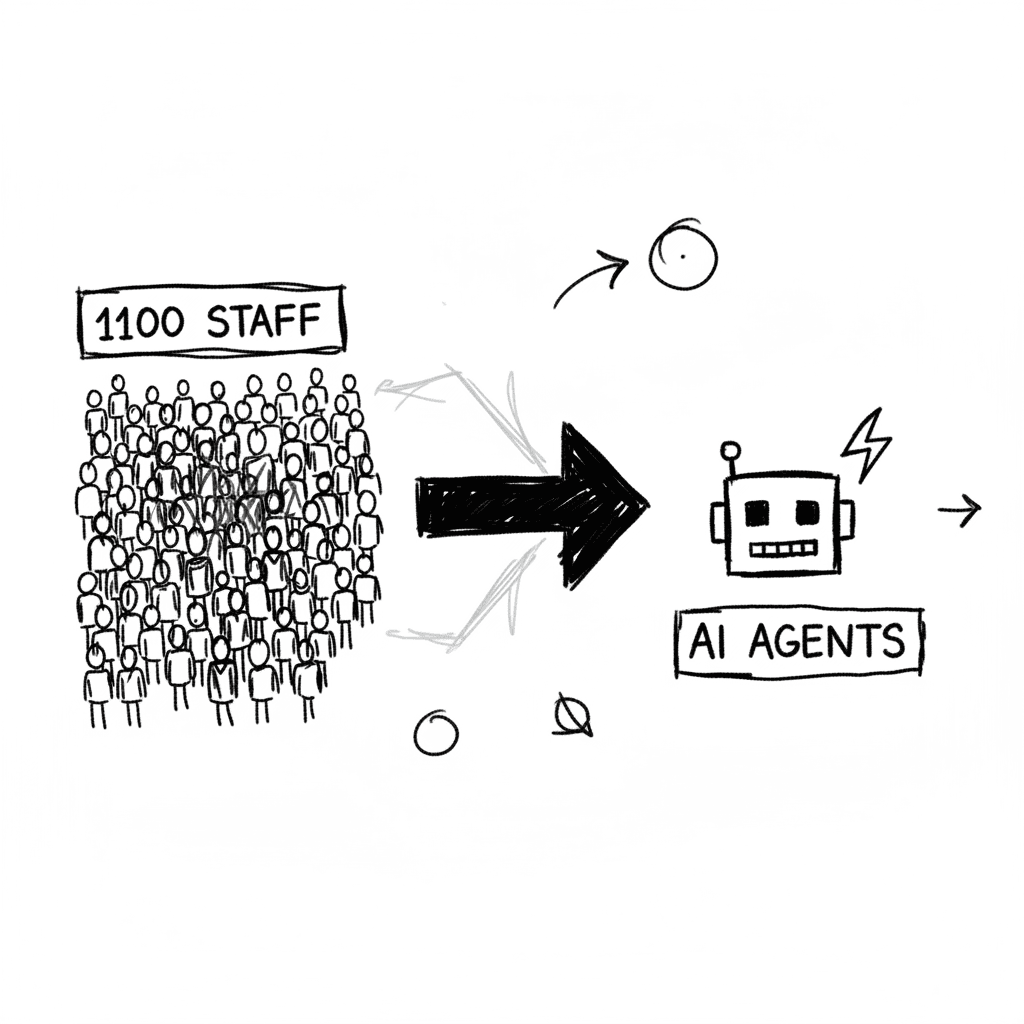

Cloudflare : restructuration massive au profit d'une architecture agentique interne

Cloudflare licencie 1 100 employés, soit 20 % de ses effectifs, pour automatiser ses processus via des agents IA. L'entreprise profite d'une croissance de 34 % en glissement annuel pour forcer une tra

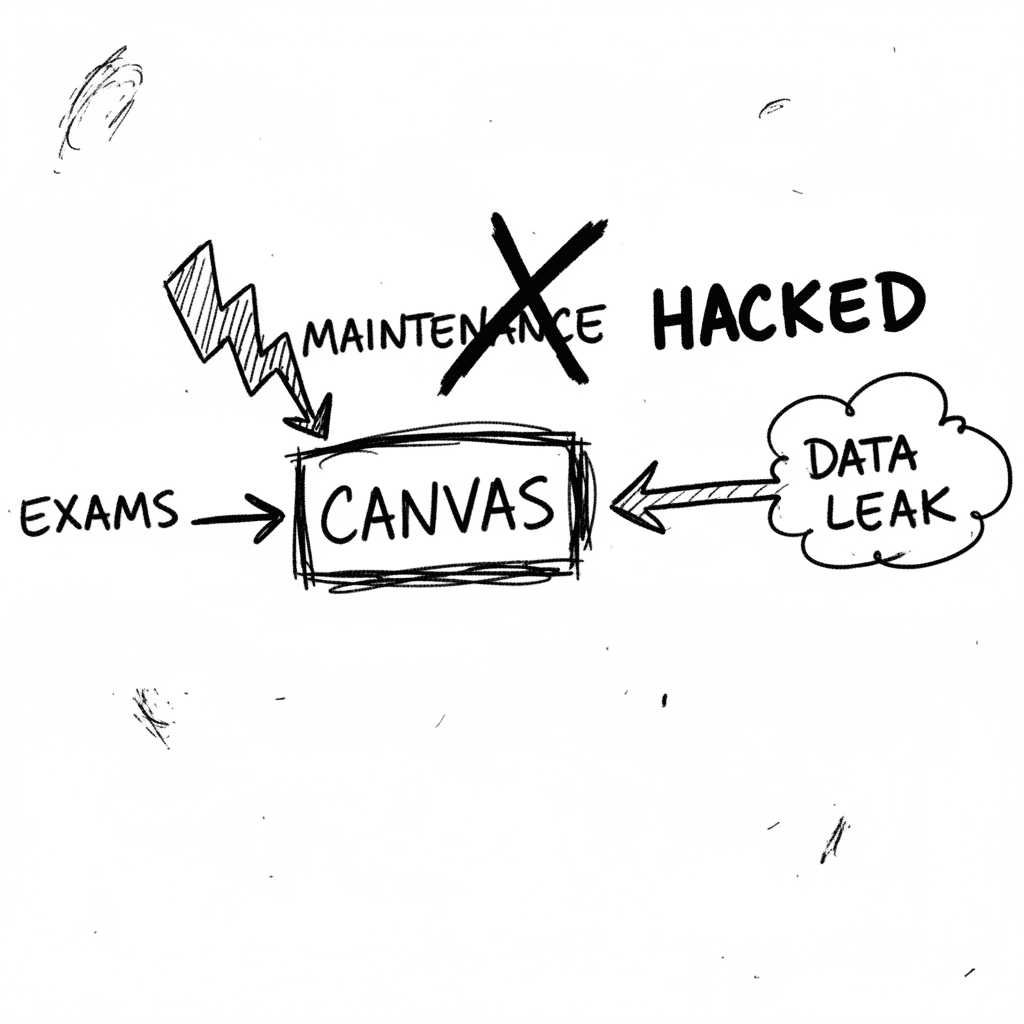

Instructure Canvas : échec critique de la sécurité en pleine période d'examens

Instructure Canvas, le LMS utilisé par plus de 30 millions d'étudiants, subit actuellement une compromission totale de son infrastructure par le groupe ShinyHunters. Alors que les universités entament

Restez à la pointe des tendances d'adoption de l'IA

Recevez nos derniers rapports et analyses directement dans votre boîte mail. Pas de spam, que des données.